Похожие презентации:

Вычисление характеристик дизельного топлива с использованием методов машинного обучения

1.

Вычисление характеристик дизельноготоплива с использованием

методов машинного обучения

Выполнил: студент

группы 3822М1Фии1

Попов Даниил

Руководитель: д.ф.-м.н., ст.н.с.

Кувыкин В.И.

1

2.

Искусственный интеллект в нефтепереработкеВ современном мире очевидна исключительность роли

нефтяной промышленности. Крупные нефтяные

компании готовы тратить большие деньги на

оптимизацию добычи и обработки нефтепродуктов.

В чем помогает искусственный интеллект

•Сокращать затраты при увеличении добычи

•Разведочное бурение

•Анализ данных сейсмических исследований

Разработка концепции интеллектуального

месторождения поможет добывающим

компаниям сократить расходы на 5% и

увеличить объем добычи на 2%.

То, что нефтегазовая отрасль уже активно

использует решения на базе AI, подтверждает

объем рынка этих решений: в 2019 году

добывающая промышленность потратила на

них больше $2 миллиардов

2

3.

Оценка качества ДТ используя ИНСПостановка задачи: изучить модели машинного

обучения для прогнозирования низкотемпературных

свойств дизельного топлива

Выходные значения

1.

Предельная температура фильтруемости минимальная температура, при которой будет

обеспечен бесперебойный поток в топливных

системах

2.

Температура помутнения - температура, при

которой начинается процесс кристаллизации

содержащегося в топливе парафина.

3

4.

Свойства и характеристикиХарактеристики:

1)

2)

3)

4)

5)

6)

7)

8)

9)

Цетановое число - характеристика воспламеняемости

Цетановый индекс

Плотность (кг/м3)

Массовая доля полициклических ароматических углеводородов (%)

Температура вспышки (°C)

Кинетическая вязкость

Объем перегонки до 180 °C (%)

Объем перегонки до 360 °C (%)

Температура выкипания 95 % объема (°C)

Предсказываем:

1) Предельная температура фильтруемости

2) Температуры помутнения

Обучающее множество - 280 элементов

Тестовое – 100 элементов.

4

5.

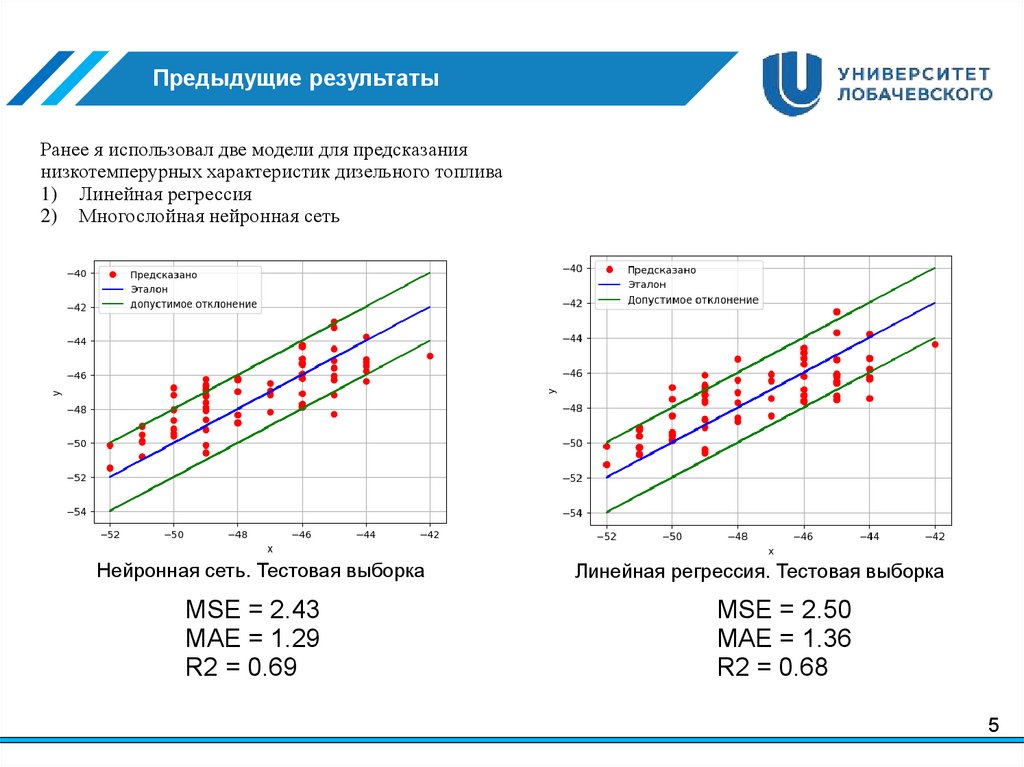

Предыдущие результатыРанее я использовал две модели для предсказания

низкотемперурных характеристик дизельного топлива

1) Линейная регрессия

2) Многослойная нейронная сеть

Нейронная сеть. Тестовая выборка

MSE = 2.43

MAE = 1.29

R2 = 0.69

Линейная регрессия. Тестовая выборка

MSE = 2.50

MAE = 1.36

R2 = 0.68

5

6.

Градиентный бустингGradient Boosting on Decision Trees, GBDT

Бустинг,

воплощает

идею

последовательного

построения

линейной комбинации алгоритмов.

Каждый

следующий

алгоритм

старается

уменьшить

ошибку

текущего ансамбля.

Он отлично работает на

выборках

с

«табличными»,

неоднородными данными. Стоит

только понимать, что построенная

композиция по сути окажется

линейной комбинацией линейных

моделей,

то

есть

опять-таки

линейной моделью (или нейросетью

с одним полносвязным слоем). Это

уменьшает возможности ансамбля

эффективно определять нелинейные

зависимости в данных.

6

7.

Предобработка данных1)

2)

3)

4)

Замена пропущенных значений

математическим ожиданием

Нормализация данных

Обнаружение выбросов путем

построения диаграммы «Ящик с

усами»

Нахождение сильно

коррелированных признаков (от 0.8)

Рис. Матрица корреляций

Рис. «Ящик с усами»

7

8.

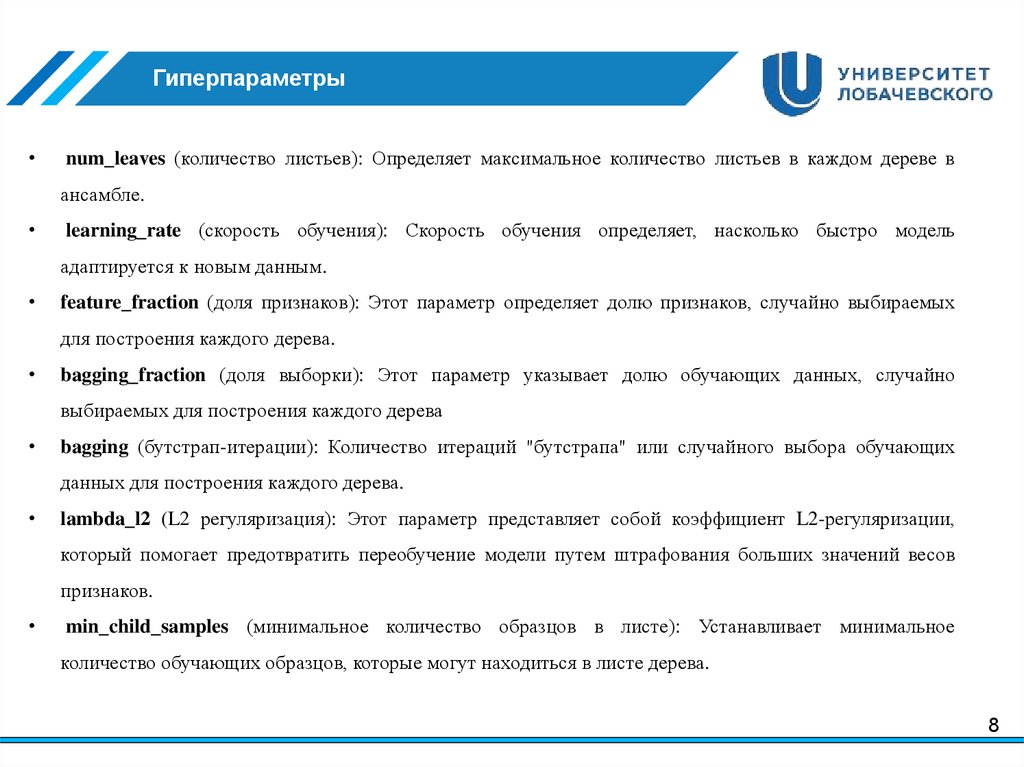

Гиперпараметрыnum_leaves (количество листьев): Определяет максимальное количество листьев в каждом дереве в

ансамбле.

learning_rate (скорость обучения): Скорость обучения определяет, насколько быстро модель

адаптируется к новым данным.

feature_fraction (доля признаков): Этот параметр определяет долю признаков, случайно выбираемых

для построения каждого дерева.

bagging_fraction (доля выборки): Этот параметр указывает долю обучающих данных, случайно

выбираемых для построения каждого дерева

bagging (бутстрап-итерации): Количество итераций "бутстрапа" или случайного выбора обучающих

данных для построения каждого дерева.

lambda_l2 (L2 регуляризация): Этот параметр представляет собой коэффициент L2-регуляризации,

который помогает предотвратить переобучение модели путем штрафования больших значений весов

признаков.

min_child_samples (минимальное количество образцов в листе): Устанавливает минимальное

количество обучающих образцов, которые могут находиться в листе дерева.

8

9.

РезультатыОптимальные параметры:

num_leaves = 30, learning_rate = 0.025, feature_fraction = 0.6, bagging_fraction =

0.82, bagging = 0.82, lambda_l2 = 0.2, min_child_samples = 0.6

MSE = 2.33

MAE = 1.37

R2 = 0.73

MSE = 2.45

MAE = 1.39

R2 = 0.71

9

10.

ЗаключениеПосле предварительной обработки данных была построена модель

градиентного бустинга для прогнозирования низкотемпературных свойств

дизельного топлива по известным качественным характеристикам.

Результат

оказался

достаточным,

чтобы

утверждать

о

возможности

применении данной модели для прогнозирования предельной температуры

фильтруемости и температуры помутнения.

Метрики данной модели также были сравнены с построенной моделями

линейной регрессии и ИНС, оказались лучше, что дает повод говорить о

разумности практического применения градиентного бустинга для решения

поставленной задачи.

10

11.

Литература1.

Кувыкин В.И., Кувыкина Е.В Использование нейронных сетей для расчета качественных характеристик

нефтепродуктов – 2020 // Современные наукоемкие технологии. 2020. № 4. С.26 – 30.

2.

Маринович С., Баланча.С., Юкич.С. Вычисление низкотемпературных характеристик дизельного топлива

с помощью искусственных нейронных сетей // Химия и технология топлив и масел 2012. №1. C.47-51.

3.

Писаревский Д.В., Будник В.А., Куцуев К.Ф., Жирнов Б.С. Современные методы математической

обработки и их роль в оптимизации технологических процессов нефтехимии и нефтепереработки //

Нефтепереработка и нефтехимия. Научно-технические достижения и передовой опыт. 2011. №8 С.16-21.

4.

И. В. Пискунов, М. В. Шаманин, Н. Ю. Башкирцева РАЗВИТИЕ ИНФОРМАЦИОННЫХ СИСТЕМ

ПЛАНИРОВАНИЯ И УПРАВЛЕНИЯ ТЕХНОЛОГИЧЕСКИМИ ПРОЦЕССАМИ В

НЕФТЕПЕРЕРАБОТКЕ // Вестник технологического университета. 2021. Т.24, №10 С. 62-65

5.

Husam Alkinani, Abo Taleb Tuama Al-Hameedi, Shari Dunn-Norman, Ralph Flori, Applications of Artificial

Neural Networks in the Petroleum Industry: A Review, March 2019

6.

ГОСТ 33755—2016 // ТОПЛИВО ДИЗЕЛЬНОЕ И МАЗУТ ТОПОЧНЫЙ. Определение предельной

температуры фильтруемости на холодном фильтре. 2016. С. 10-12

11

Химия

Химия