Похожие презентации:

Информация - сведения (данные) о каком-либо событии, объекте, являющиеся предметами операций

1. Информация и ее свойства

Информация – сведения (данные) о каком-либо событии, объекте, являющиесяпредметами операций

• восприятия,

• преобразования,

• хранения,

• использования,

• передачи.

Информация (I) – продукт взаимодействия объективных данных (Д) и

адекватных им субъективных методов (М).

I=Д+М

1. Информация существует только в момент взаимодействия объективных

данных и субъективных методов – информационный процесс; все остальное

время информация пребывает в состоянии данных.

2. Одни и те же объективные данные в момент потребления поставляют разную

информацию в зависимости от степени адекватности (соответствия) метода.

Пример 1: письмо из Пекина -данные

Методы:

• наблюдение

• самостоятельный

перевод,

24.01.2024

1

• перевод третьим лицом.

2. I = Д + М

I=Д+М3. Данные объективны, т.к. они результат регистрации объективно существующих

сигналов.

«Мы живем в материальном мире. Все, сто нас окружает, и с чем мы

сталкиваемся, относится либо к физическим телам, либо к физическим

полям. Все объекты находятся в состоянии непрерывного движения и

изменения, которое сопровождается обменом энергии и ее переходом из

одной формы в другую. Все виды энергообмена сопровождаются

появлением сигналов. При взаимодействии сигналов с физическими

телами в последних возникают определенные изменения свойств – это

явление называется регистрацией сигналов. Такие изменения можно

наблюдать, измерять или фиксировать теми или иными способами – при

этом возникают и регистрируются новые сигналы, т.е. образуются данные».

Это определение принимает первичность и объективность существования

данных, в том числе – независимость от субъекта их использующего.

4. Методы субъективны. Существуют искусственные и естественные методы. В

основе:

–

–

естественных методов лежат биологические свойства субъектов

информационного процесса;

искусственных методов лежат алгоритмы, разработанные человеком

24.01.2024

2

3. Свойства информации:

1.Объект ивност ь. Более объективной принято считать ту информацию, вкоторую методы вносят меньше субъективности. В ходе информационного

процесса объективность информации понижается.

2.Полнот а. Характеризует качество информации и определяет достаточность

данных для принятия решения.

3.Дост оверност ь - полезные данные сопровождаются уровнем

«информационного шума»; увеличение уровня шума требует более сложных

методов.

4.Адекват ност ь – степень соответствия реальному состоянию дела. Источники

неадекватной информации:

a) неполные или недостоверные данные;

b) применение неадекватных методов.

5.Дост упност ь. На степень доступности влияют

a) доступность данных;

b) доступность адекватных методов для их интерпретации.

6.Акт уальност ь – соответствие информации текущему моменту времени.

24.01.2024

3

4. Основные операции с данными:

1.Сбор данных – накопление информации для обеспечения

свойства полноты информации.

2.

Формализация – приведение к одинаковой форме. Влияет на

повышение доступности информации.

3.

Фильтрация – обеспечивает понижение уровня шума.

4.

Сортировка – упорядочение. Для обеспечения повышения

доступности информации.

5.

Архивация обеспечивает снижение экономических затрат,

повышает надежность информационного процесса.

6.

Защита данных – комплекс мер для предотвращения утраты,

воспроизведения, модификации информации.

7.

Транспортировка – прием и передача данных между

участниками информационного процесса. Источник информации

называется сервером, потребитель – клиентом

24.01.2024

4

5. Смысловые аспекты информации

Важно, чтобы информация для потребителя имела смысл. Потребительоценивает информацию в зависимости от того, где и для какой конкретной

задачи эта информация используется. Выделяют следующие аспекты

информации.

1. Синтаксический – связан со способом представления информации. В

зависимости от процесса, в котором участвует информация, она

представляется в виде специальных знаков, символов.

2. Семантический – позволяет оценить смысл передаваемой информации и

определяется семантическими связями между словами или другими

смысловыми элементами языка.

(Казнить нельзя помиловать).

3. Прагматический – определяет возможность достижения поставленной цели с

использованием полученной информации. Этот аспект влияет на поведение

потребителя. Если информация является эффективной, то поведение

потребителя меняется в желаемом направлении.

24.01.2024

5

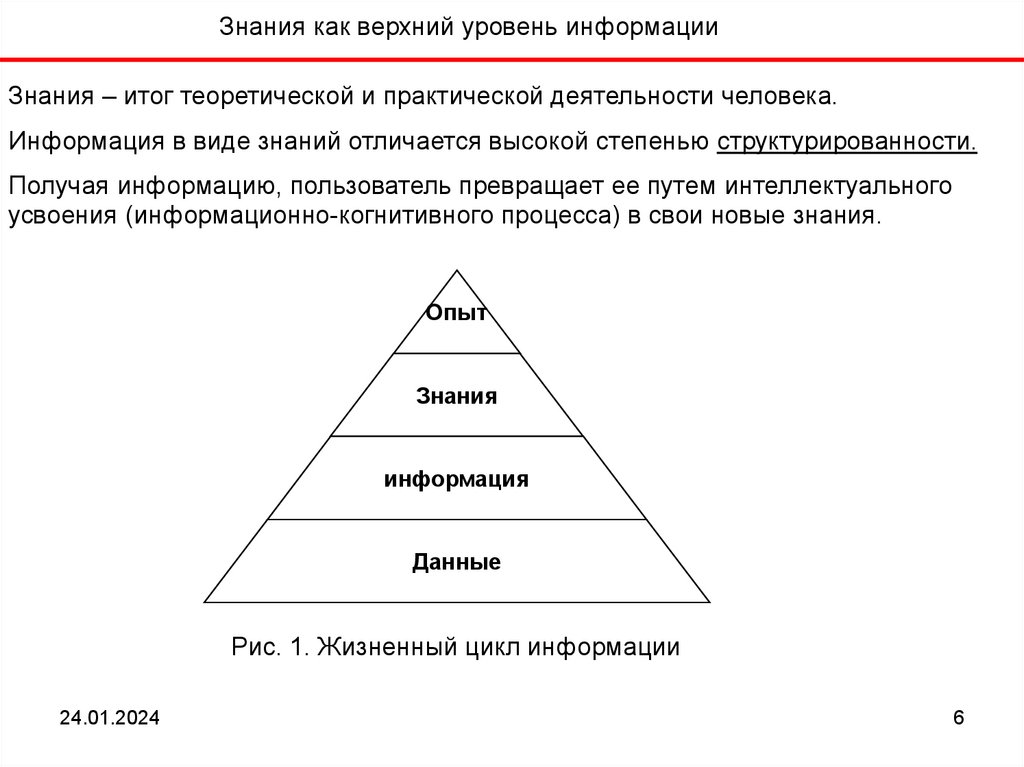

6. Знания как верхний уровень информации

Знания – итог теоретической и практической деятельности человека.Информация в виде знаний отличается высокой степенью структурированности.

Получая информацию, пользователь превращает ее путем интеллектуального

усвоения (информационно-когнитивного процесса) в свои новые знания.

Опыт

Знания

информация

Данные

Рис. 1. Жизненный цикл информации

24.01.2024

6

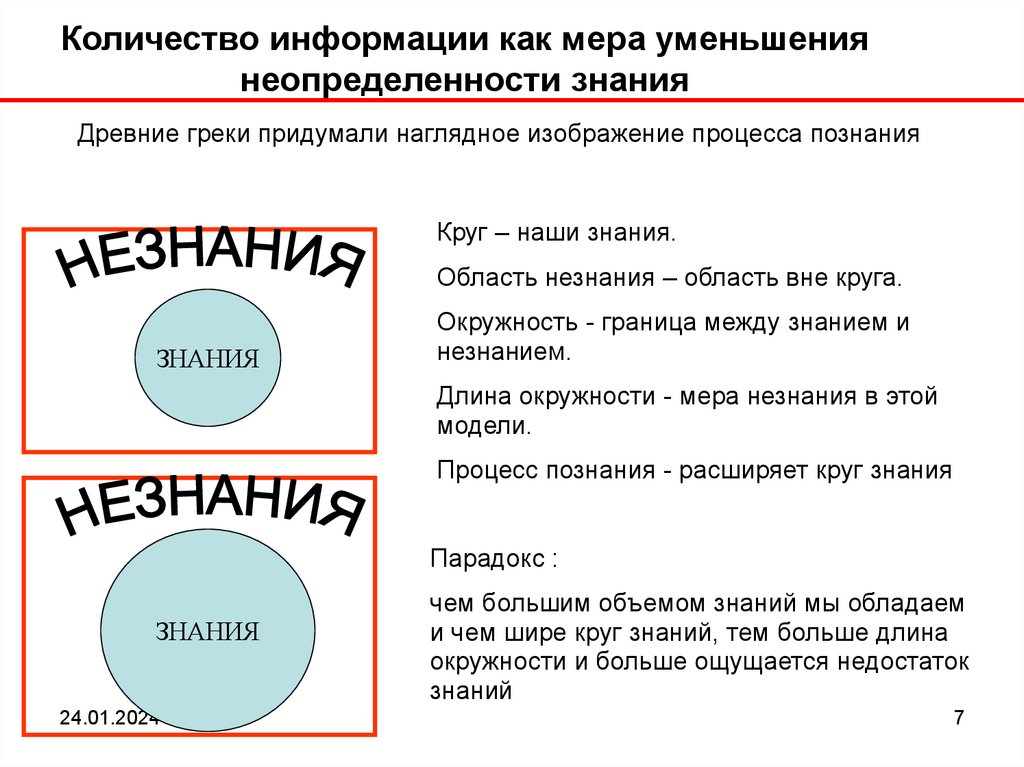

7. Количество информации как мера уменьшения неопределенности знания

Древние греки придумали наглядное изображение процесса познанияКруг – наши знания.

Область незнания – область вне круга.

ЗНАНИЯ

Окружность - граница между знанием и

незнанием.

Длина окружности - мера незнания в этой

модели.

Процесс познания - расширяет круг знания

Парадокс :

ЗНАНИЯ

24.01.2024

чем большим объемом знаний мы обладаем

и чем шире круг знаний, тем больше длина

окружности и больше ощущается недостаток

знаний

7

8.

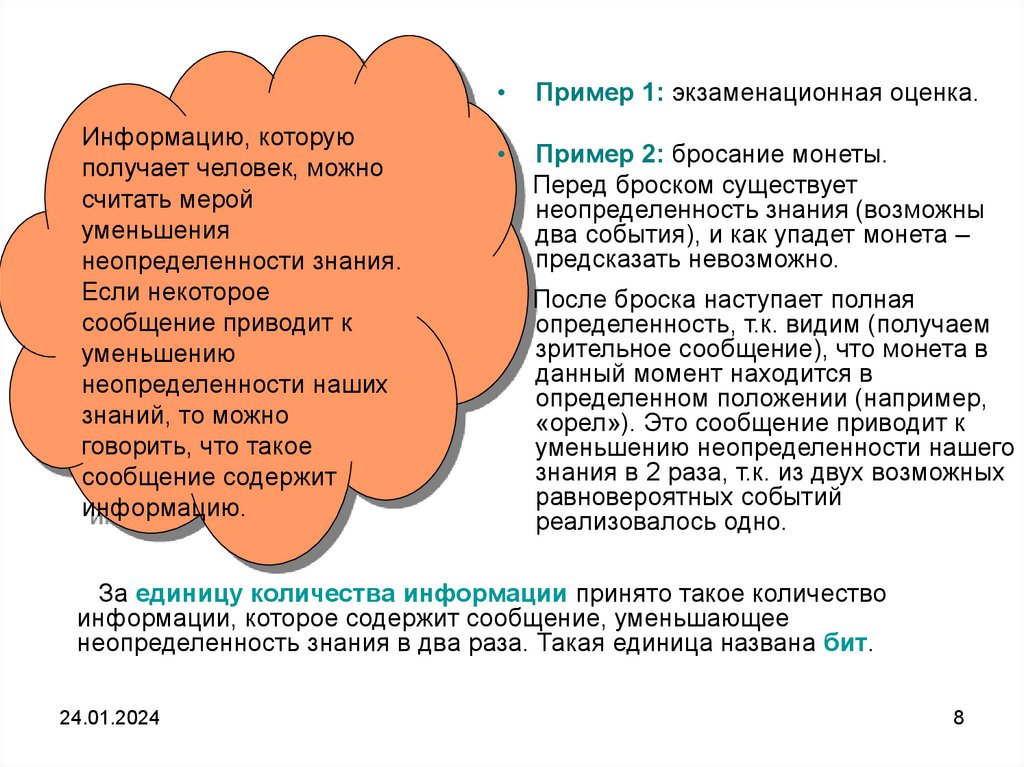

Информацию, которуюполучает человек, можно

считать мерой

уменьшения

неопределенности знания.

Если некоторое

сообщение приводит к

уменьшению

неопределенности наших

знаний, то можно

говорить, что такое

сообщение содержит

информацию.

Пример 1: экзаменационная оценка.

Пример 2: бросание монеты.

Перед броском существует

неопределенность знания (возможны

два события), и как упадет монета –

предсказать невозможно.

После броска наступает полная

определенность, т.к. видим (получаем

зрительное сообщение), что монета в

данный момент находится в

определенном положении (например,

«орел»). Это сообщение приводит к

уменьшению неопределенности нашего

знания в 2 раза, т.к. из двух возможных

равновероятных событий

реализовалось одно.

За единицу количества информации принято такое количество

информации, которое содержит сообщение, уменьшающее

неопределенность знания в два раза. Такая единица названа бит.

24.01.2024

8

9.

Чем больше начальное числовозможных равновероятных

событий, тем больше начальная

неопределенность нашего

знания и, соответственно, тем

большее количество

информации будет содержать

сообщение о результатах опыта.

24.01.2024

При бросании равносторонней

четырехгранной пирамиды

существует 4 равновероятных

события.

При бросании шестигранного

игрального кубика – 6

равновероятных событий

9

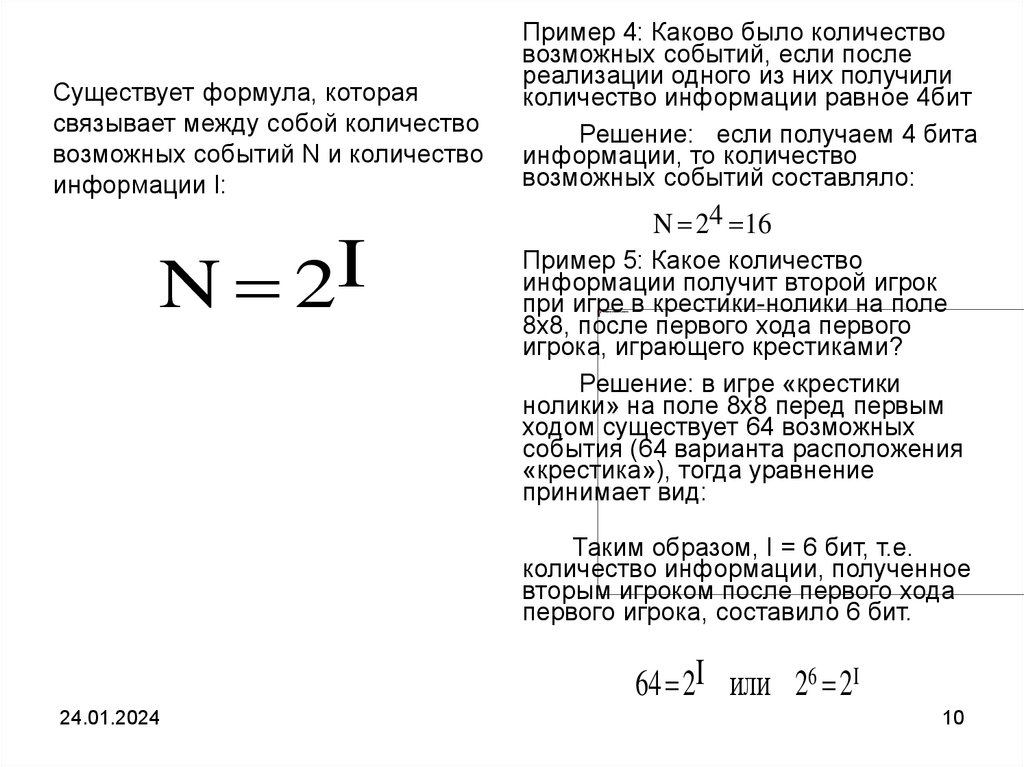

10. Существует формула, которая связывает между собой количество возможных событий N и количество информации I:

IN 2

Пример 4: Каково было количество

возможных событий, если после

реализации одного из них получили

количество информации равное 4бит

Решение: если получаем 4 бита

информации, то количество

возможных событий составляло:

N 24 16

Пример 5: Какое количество

информации получит второй игрок

при игре в крестики-нолики на поле

8х8, после первого хода первого

игрока, играющего крестиками?

Решение: в игре «крестики

нолики» на поле 8х8 перед первым

ходом существует 64 возможных

события (64 варианта расположения

«крестика»), тогда уравнение

принимает вид:

Таким образом, I = 6 бит, т.е.

количество информации, полученное

вторым игроком после первого хода

первого игрока, составило 6 бит.

64 2I или 26 2I

24.01.2024

10

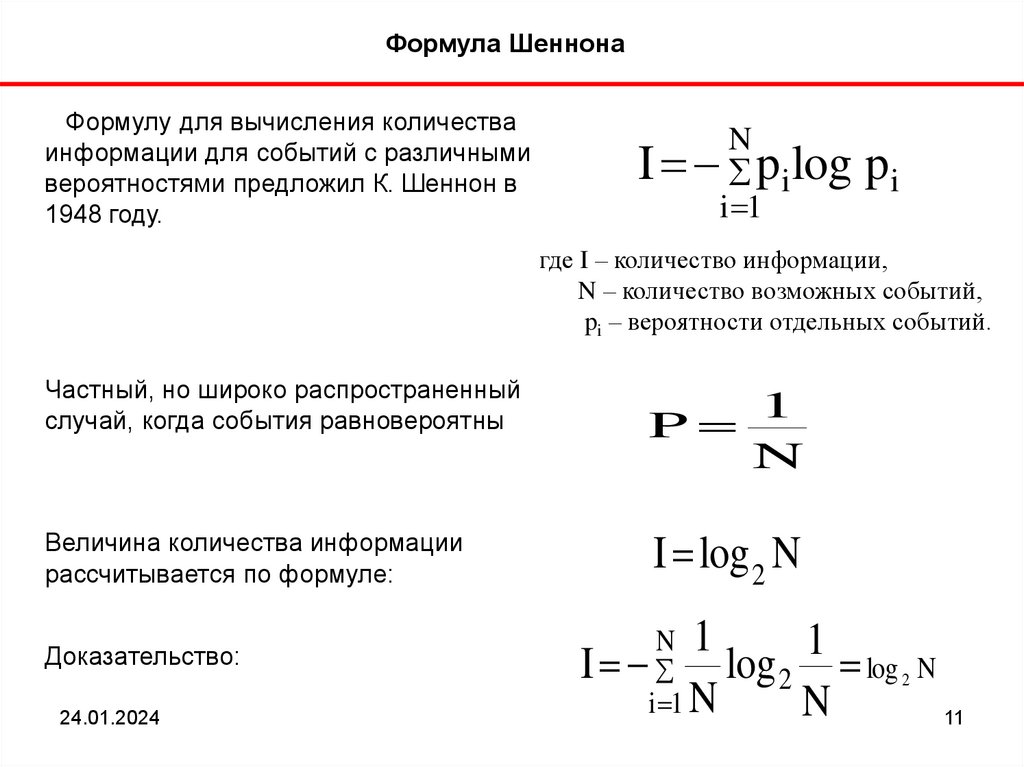

11. Формула Шеннона

Формулу для вычисления количестваинформации для событий с различными

вероятностями предложил К. Шеннон в

1948 году.

N

I pi log pi

i 1

где I – количество информации,

N – количество возможных событий,

pi – вероятности отдельных событий.

Частный, но широко распространенный

случай, когда события равновероятны

P

Величина количества информации

рассчитывается по формуле:

I log 2 N

Доказательство:

24.01.2024

1

N

N 1

1

I log 2 log 2 N

i 1 N

N

11

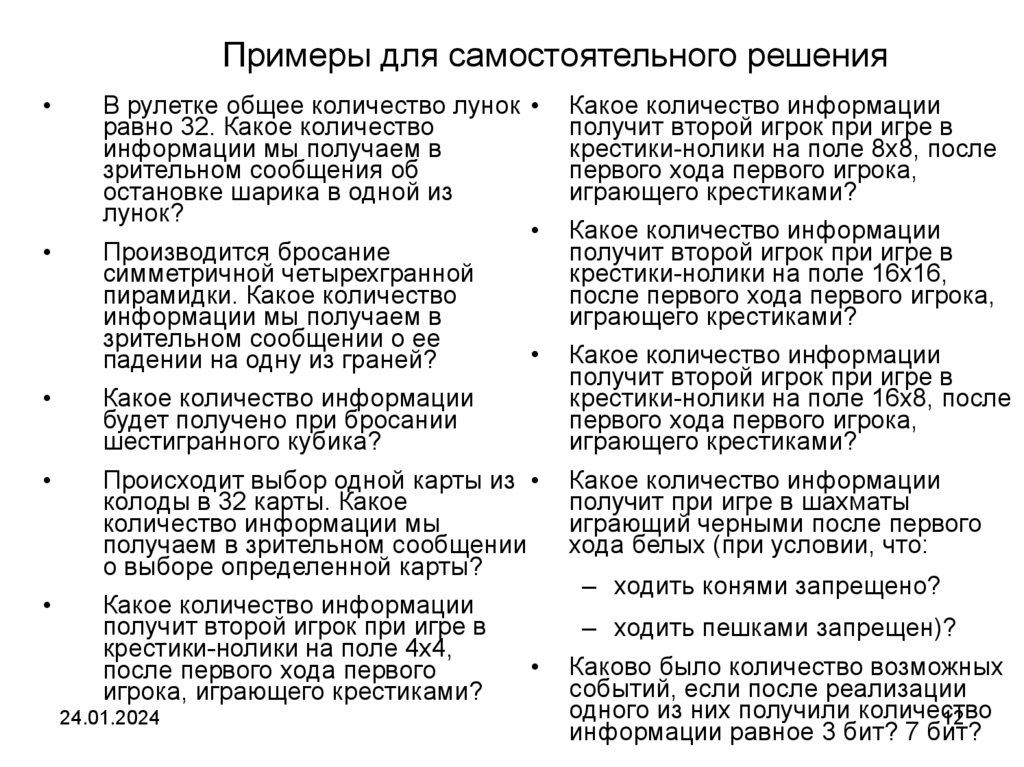

12. Примеры для самостоятельного решения

В рулетке общее количество лунок

равно 32. Какое количество

информации мы получаем в

зрительном сообщения об

остановке шарика в одной из

лунок?

Производится бросание

симметричной четырехгранной

пирамидки. Какое количество

информации мы получаем в

зрительном сообщении о ее

падении на одну из граней?

Какое количество информации

будет получено при бросании

шестигранного кубика?

Происходит выбор одной карты из

колоды в 32 карты. Какое

количество информации мы

получаем в зрительном сообщении

о выборе определенной карты?

Какое количество информации

получит второй игрок при игре в

крестики-нолики на поле 4х4,

после первого хода первого

игрока, играющего крестиками?

24.01.2024

Какое количество информации

получит второй игрок при игре в

крестики-нолики на поле 8х8, после

первого хода первого игрока,

играющего крестиками?

Какое количество информации

получит второй игрок при игре в

крестики-нолики на поле 16х16,

после первого хода первого игрока,

играющего крестиками?

Какое количество информации

получит второй игрок при игре в

крестики-нолики на поле 16х8, после

первого хода первого игрока,

играющего крестиками?

Какое количество информации

получит при игре в шахматы

играющий черными после первого

хода белых (при условии, что:

– ходить конями запрещено?

– ходить пешками запрещен)?

Каково было количество возможных

событий, если после реализации

одного из них получили количество

12

информации равное 3 бит? 7 бит?

13. Кодирование информации

24.01.202413

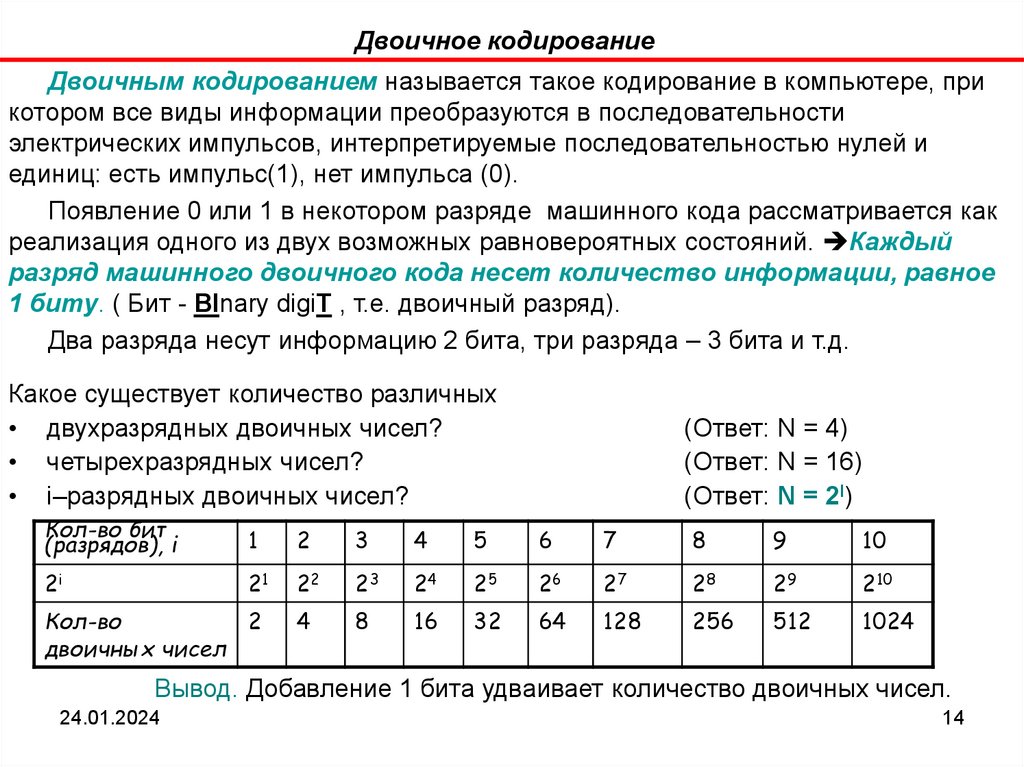

14. Двоичное кодирование

Двоичным кодированием называется такое кодирование в компьютере, прикотором все виды информации преобразуются в последовательности

электрических импульсов, интерпретируемые последовательностью нулей и

единиц: есть импульс(1), нет импульса (0).

Появление 0 или 1 в некотором разряде машинного кода рассматривается как

реализация одного из двух возможных равновероятных состояний. Каждый

разряд машинного двоичного кода несет количество информации, равное

1 биту. ( Бит - BInary digiT , т.е. двоичный разряд).

Два разряда несут информацию 2 бита, три разряда – 3 бита и т.д.

Какое существует количество различных

• двухразрядных двоичных чисел?

• четырехразрядных чисел?

• i–разрядных двоичных чисел?

(Ответ: N = 4)

(Ответ: N = 16)

(Ответ: N = 2I)

Кол-во бит

(разрядов), i

1

2

3

4

5

6

7

8

9

10

2i

21

22

23

24

25

26

27

28

29

210

Кол-во

2

двоичных чисел

4

8

16

32

64

128

256

512

1024

Вывод. Добавление 1 бита удваивает количество двоичных чисел.

24.01.2024

14

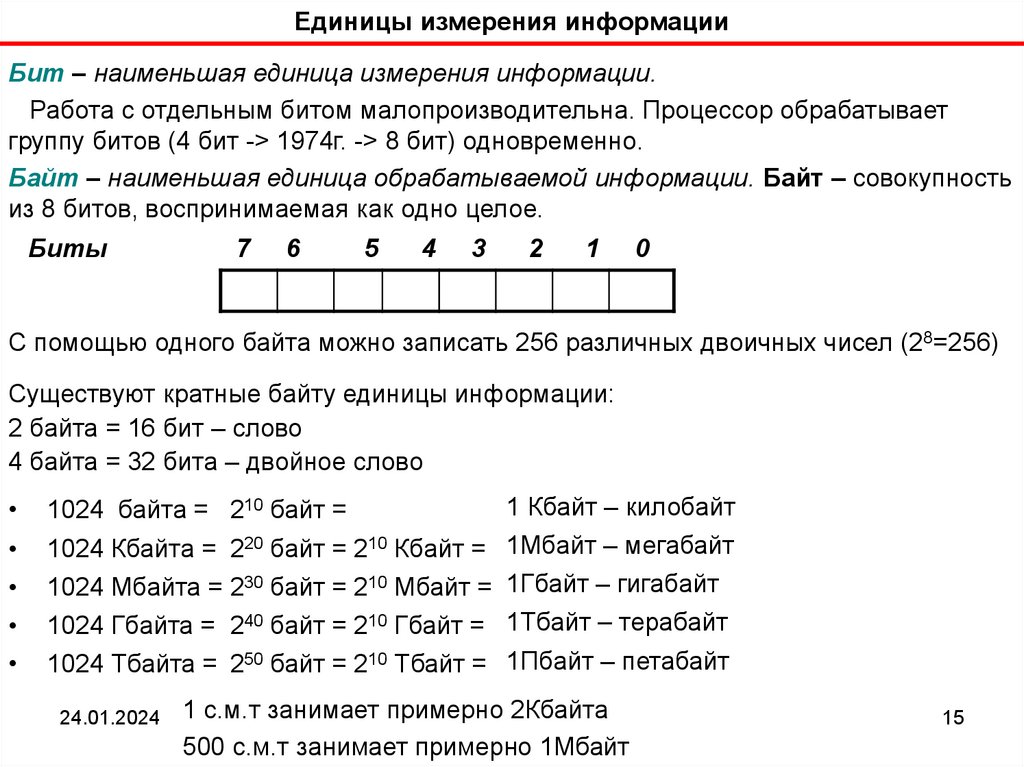

15. Единицы измерения информации

Бит – наименьшая единица измерения информации.Работа с отдельным битом малопроизводительна. Процессор обрабатывает

группу битов (4 бит -> 1974г. -> 8 бит) одновременно.

Байт – наименьшая единица обрабатываемой информации. Байт – совокупность

из 8 битов, воспринимаемая как одно целое.

Биты

7

6

5

4

3

2

1

0

С помощью одного байта можно записать 256 различных двоичных чисел (28=256)

Существуют кратные байту единицы информации:

2 байта = 16 бит – слово

4 байта = 32 бита – двойное слово

1 Кбайт – килобайт

1024 байта = 210 байт =

1024 Кбайта = 220 байт = 210 Кбайт = 1Мбайт – мегабайт

1024 Мбайта = 230 байт = 210 Мбайт = 1Гбайт – гигабайт

1024 Гбайта = 240 байт = 210 Гбайт = 1Тбайт – терабайт

1024 Тбайта = 250 байт = 210 Тбайт = 1Пбайт – петабайт

24.01.2024

1 с.м.т занимает примерно 2Кбайта

500 с.м.т занимает примерно 1Мбайт

15

16. Примеры для самостоятельного решения

1) Какое количествоинформации содержит один

разряд двоичного числа?

2) Какое количество

информации содержит один

разряд шестнадцатеричного

числа?

3) Какое количество

информации содержит один

разряд восьмеричного

числа?

4) Какое количество

информации несет

восьмиразрязрядный

двоичный код?

24.01.2024

5) Какое количество

информации несет буква

русского алфавита, если не

использовать букву «ё»?

6) Книги на русском и

китайском языках содержат

одинаковое количество

знаков. В какой книге

содержится большее

количество информации,

если не рассматривать их

содержание?

7) Перевести в более крупные

единицы 253 байт.

16

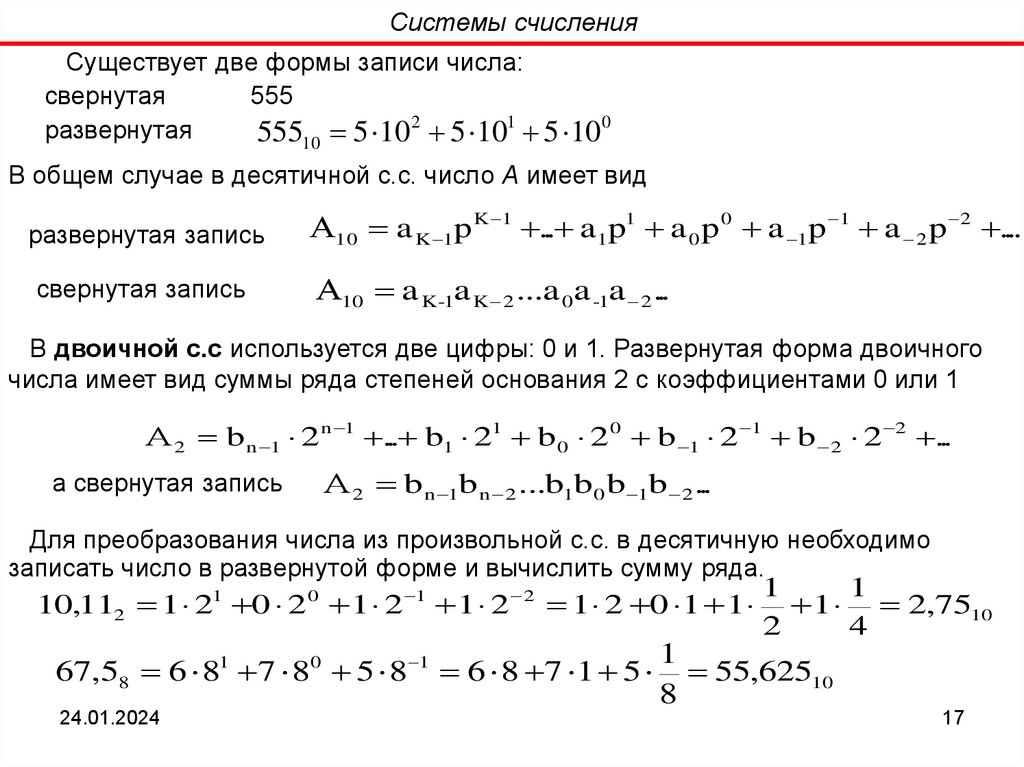

17. Системы счисления

Существует две формы записи числа:свернутая

555

развернутая

55510 5 10 2 5 101 5 100

В общем случае в десятичной с.с. число А имеет вид

развернутая запись

А10 a K 1p K 1 ... a 1p1 a 0 p 0 a 1p 1 a 2 p 2 ....

свернутая запись

А10 a K -1a K 2 ...a 0a -1a 2 ...

В двоичной с.с используется две цифры: 0 и 1. Развернутая форма двоичного

числа имеет вид суммы ряда степеней основания 2 с коэффициентами 0 или 1

А 2 b n 1 2 n 1 ... b1 21 b 0 2 0 b 1 2 1 b 2 2 2 ...

а свернутая запись

А 2 b n 1b n 2 ...b1b 0 b 1b 2 ...

Для преобразования числа из произвольной с.с. в десятичную необходимо

записать число в развернутой форме и вычислить сумму ряда.

10,112 1 21 0 2 0 1 2 1 1 2 2 1 2 0 1 1

67,58 6 81 7 80 5 8 1 6 8 7 1 5

24.01.2024

1

1

1 2,7510

2

4

1

55,62510

8

17

18. Метод взвешивания для перевода из десятичной системы счисления в двоичную

57 кг24.01.2024

18

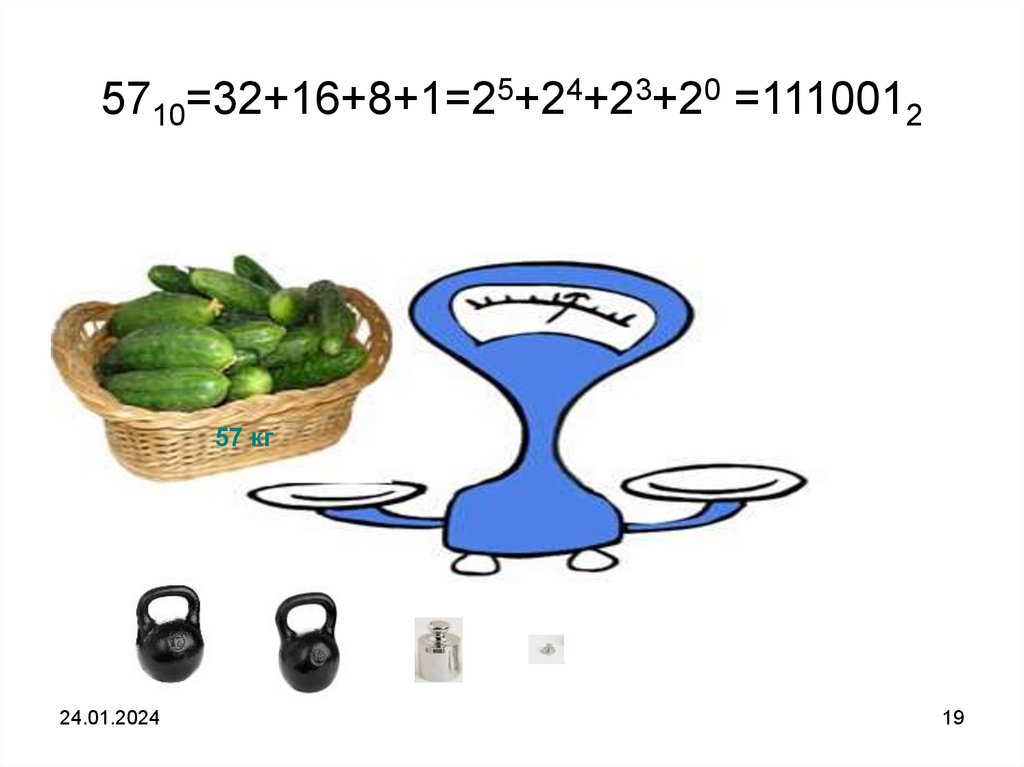

19. 5710=32+16+8+1=25+24+23+20 =1110012

57 кг24.01.2024

19

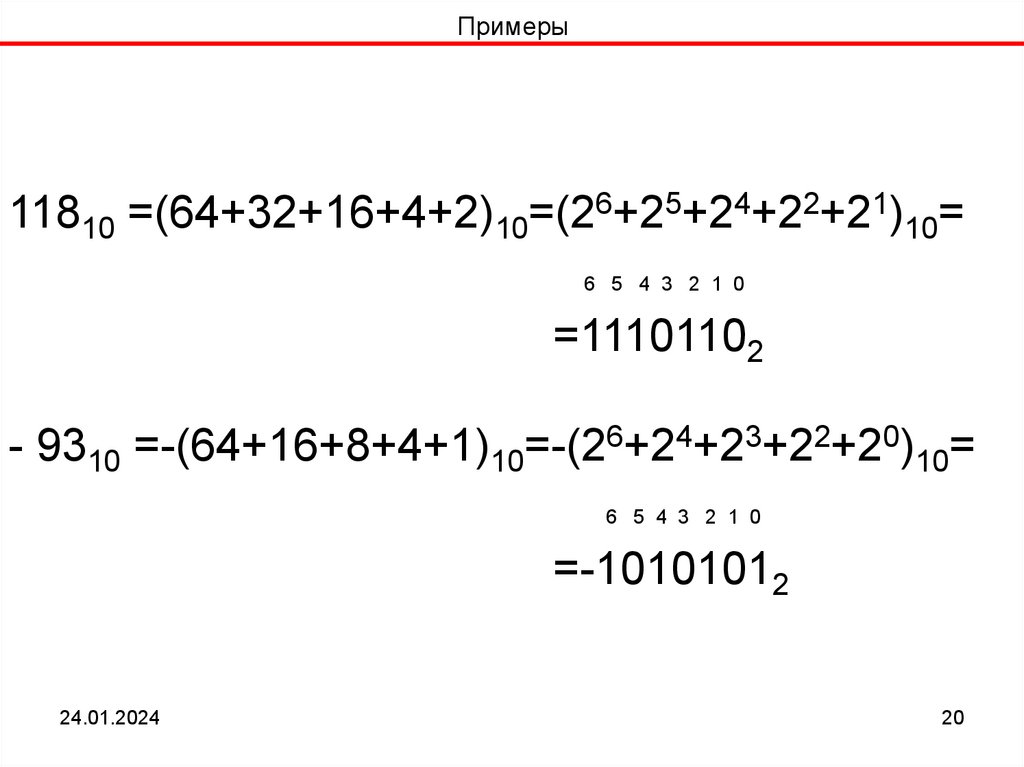

20. Примеры

11810 =(64+32+16+4+2)10=(26+25+24+22+21)10=6 5 4 3 2 1 0

=11101102

- 9310 =-(64+16+8+4+1)10=-(26+24+23+22+20)10=

6 5 4 3 2 1 0

=-10101012

24.01.2024

20

Информатика

Информатика