Похожие презентации:

Галлюцинации LLM

1.

Галлюцинации LLMСергеева

Маринина

2.

СОДЕРЖАНИЕ1. Что такое галлюцинации. Виды и причины

их возникновения.

2. Как оценить галлюцинации: стратегии,

бенчмарки и метрики

3. Методы борьбы с галлюцинациями

4. Что мы можем сделать самостоятельно

3.

1. Что такое галлюцинации.Виды и причины их возникновения.

Галлюцинации - кажущиеся правдоподобными, но

в действительности ошибочные ответы модели

• галлюцинации факта (factuality hallucinations)

• галлюцинации верности (faithfulness

hallucinations)

4.

1. Что такое галлюцинации.Виды и причины их возникновения.

галлюцинация факта (factuality hallucinations)

несоответствие между результатом генерации и

известными фактами, которые мы можем

перепроверить

5.

1. Что такое галлюцинации.Виды и причины их возникновения.

галлюцинации верности (faithfulness hallucinations)

результат не соответствует пользовательскому вводу или

контексту, который мы подали, или возникают проблемы с

внутренней самосогласованностью результата.

Эти галлюцинации делятся на три типа:

• Несоответствие инструкциям

• Несоответствие контексту

• Логическое несоответствие

6.

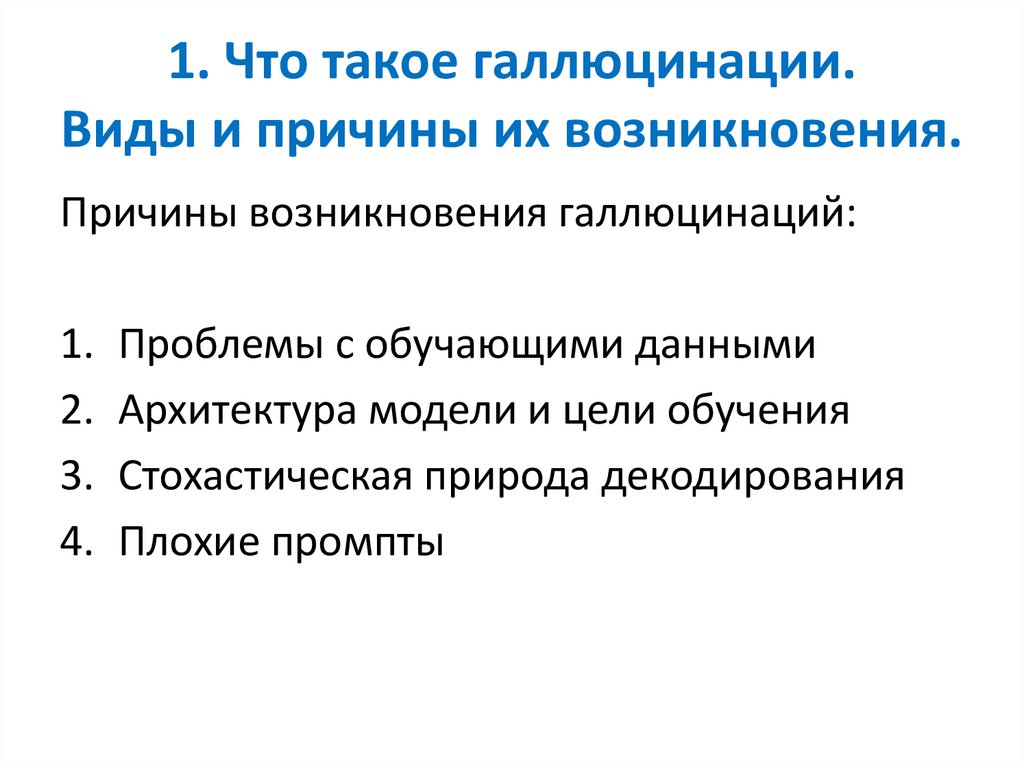

1. Что такое галлюцинации.Виды и причины их возникновения.

Причины возникновения галлюцинаций:

1. Проблемы с обучающими данными

2. Архитектура модели и цели обучения

3. Стохастическая природа декодирования

4. Плохие промпты

7.

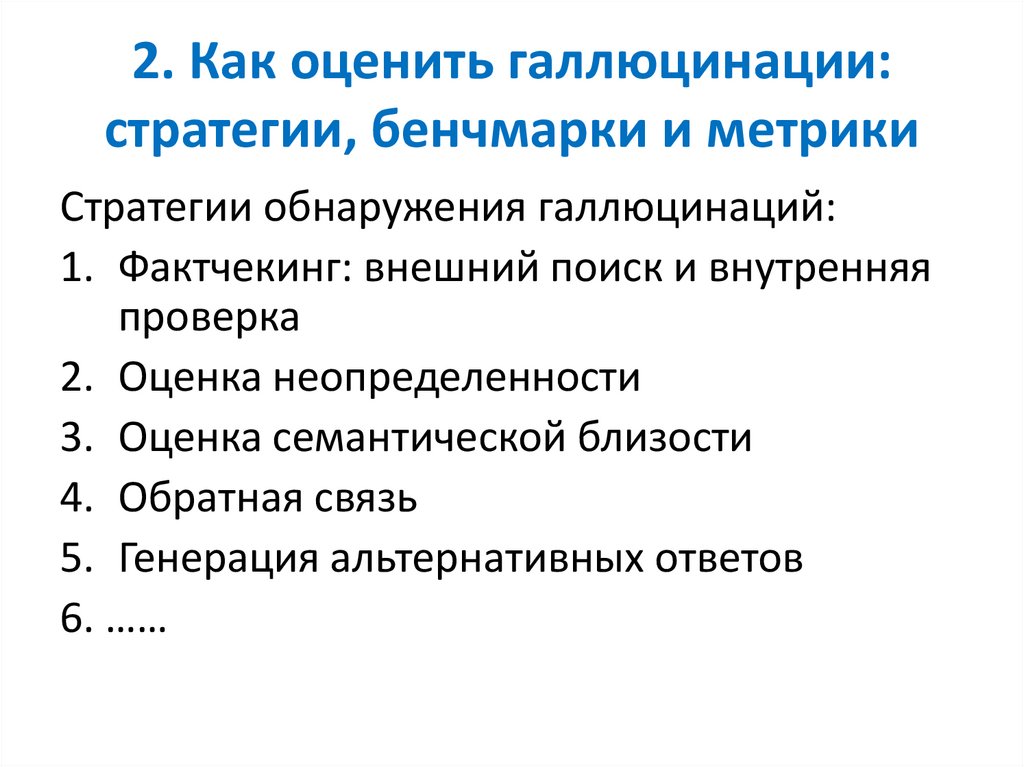

2. Как оценить галлюцинации:стратегии, бенчмарки и метрики

Стратегии обнаружения галлюцинаций:

1. Фактчекинг: внешний поиск и внутренняя

проверка

2. Оценка неопределенности

3. Оценка семантической близости

4. Обратная связь

5. Генерация альтернативных ответов

6. ……

8.

2. Как оценить галлюцинации:стратегии, бенчмарки и метрики

9.

2. Как оценить галлюцинации:стратегии, бенчмарки и метрики

• Оценка человеком

• Оценки с использованием модели-судьи

• Оценки на основе прокси-метрик

10.

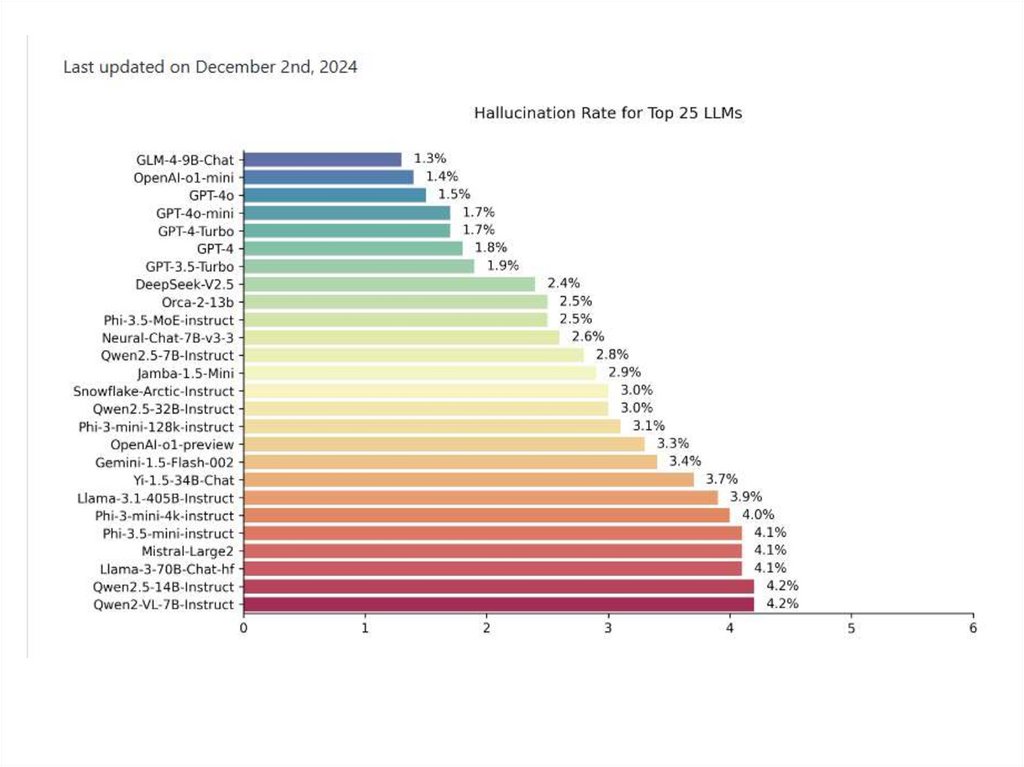

11.

3. Методы борьбы с галлюцинациями1. Работа с обучающими данными

2. SFT (Supervised Fine-Tuning) — дообучение с

учителем

3. Хороший промптинг

4. Нейросети для нейросетей

5. Human-in-the-loop

6. SelfCheckGPT

7. RAG (Retrieval-Augmented Generation) —

расширенная генерация с привлечением

данных

12.

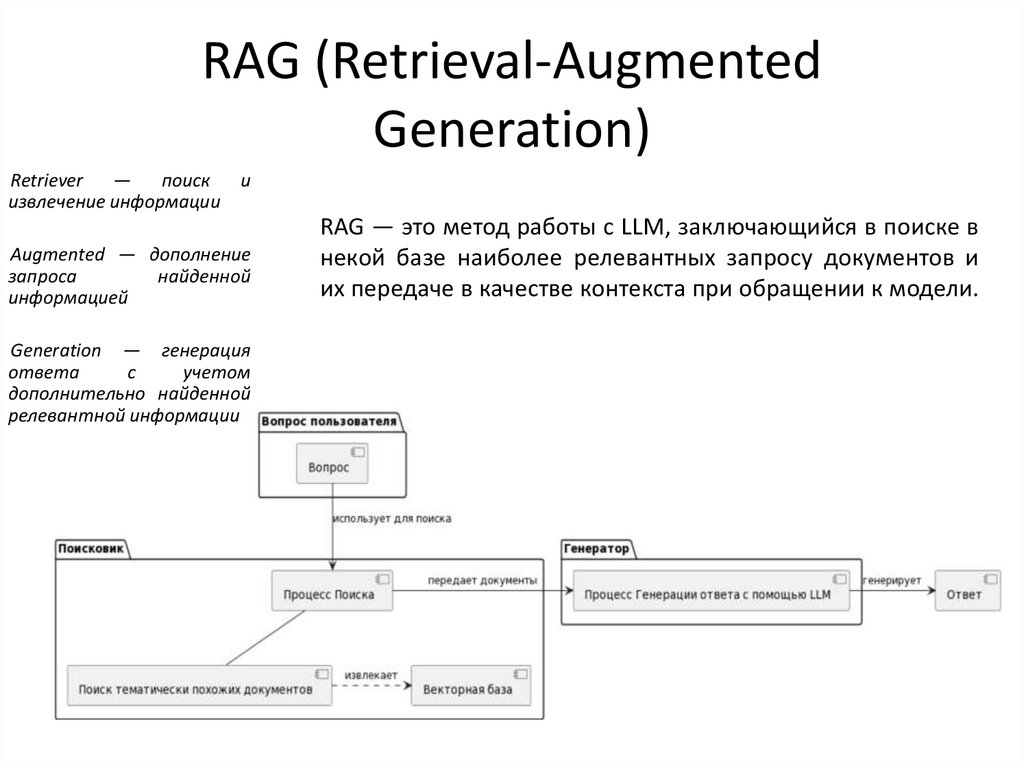

RAG (Retrieval-AugmentedGeneration)

Retriever —

поиск

и

извлечение информации

Augmented — дополнение

запроса

найденной

информацией

Generation — генерация

ответа

с

учетом

дополнительно найденной

релевантной информации

RAG — это метод работы с LLM, заключающийся в поиске в

некой базе наиболее релевантных запросу документов и

их передаче в качестве контекста при обращении к модели.

13.

Базовый пайплайн RAG14.

Шаблон для ответов нафактологические вопросы

«Пользователь задал вопрос: {вопрос}.

Вот релевантная информация, найденная в

справочнике:

{найденная

информация}.

Ответь на вопрос пользователя, основываясь

только на данной выше информации. Если

данная информация не содержит ответ на

вопрос пользователя, то ответь, что ты не

знаешь».

15.

Какие возможности открывает RAG:RAG позволяет языковой модели лучше понимать контекст и нюансы области

знаний. В результате AI даёт более информированные и релевантные ответы.

RAG позволяет сопоставлять данные, сгенерированные моделью, с

извлечёнными документами, чтобы проверить достоверность ответа.

RAG позволяет модели постоянно обращаться к актуальным данным, а

разработчикам не нужно тратить ресурсы на постоянное дообучение LLM.

RAG позволяет LLM ссылаться на вполне конкретные источники информации.

Это снижает вероятность, что LLM, не найдя подходящей информации для

ответа, просто выдумает его. Если нужно, эти источники пользователь может

проверить, а инженер — обновить, дополнить или удалить.

RAG

позволяет

попытаться

перекрыть

модели

возможности

галлюцинирования. Для этого в промпт разработчики добавляют уточнение,

что если в базе данных не нашлось информации по запросу — модель

должна ответить, что не знает ответа.

RAG также позволяет предприятиям, которые не хотят, чтобы их документы

использовались для обучения модели, — например, компаниям в строго

регулируемых отраслях, таких как здравоохранение и юриспруденция, —

использовать эти документы более безопасным и временным способом.

16.

Ограничения RAG• RAG плохой помощник в задачах, требующими

«интенсивного

мышления»,

такими

как

программирование и математика

• Знания в модели не зашиты - качество ответов

сильно зависят от того, что найдет Retriver, что

является непростой задачей. В типичном бардаке

документов компании документы и знания хранятся

в плохо структурированном виде, в разных местах,

иногда в виде изображений, графиков и записок от

руку и т.п. Часто информация в одном месте

противоречит информации в другом.

17.

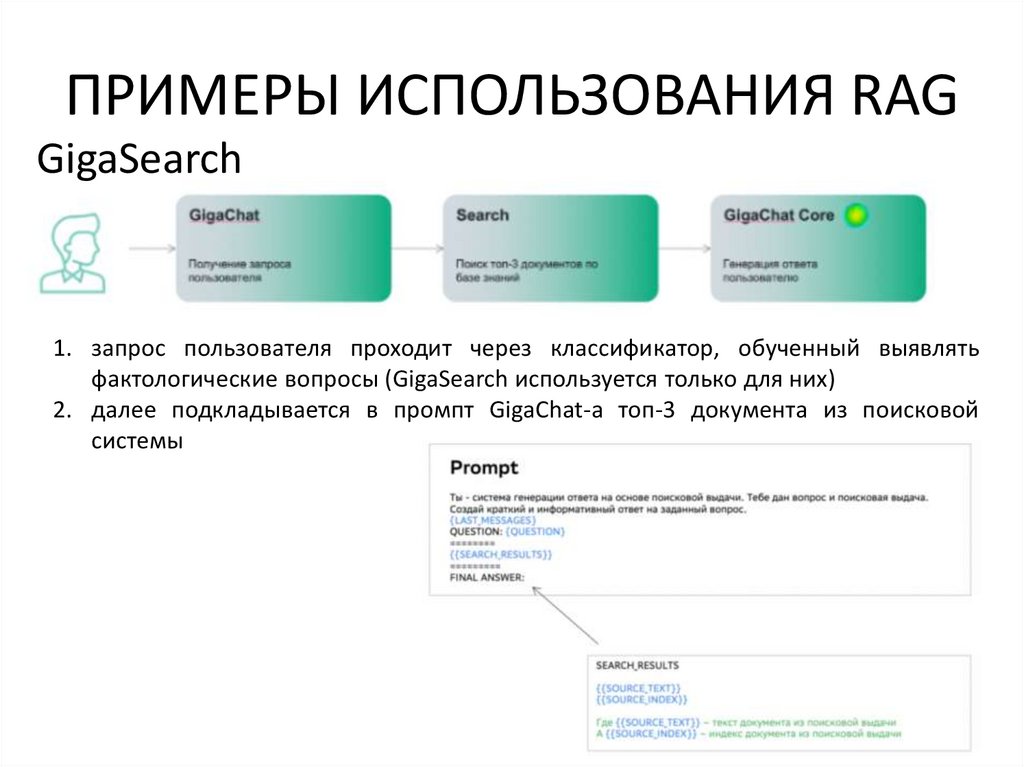

ПРИМЕРЫ ИСПОЛЬЗОВАНИЯ RAGGigaSearch

1. запрос пользователя проходит через классификатор, обученный выявлять

фактологические вопросы (GigaSearch используется только для них)

2. далее подкладывается в промпт GigaChat-а топ-3 документа из поисковой

системы

18.

ПРИМЕРЫ ИСПОЛЬЗОВАНИЯ RAGНейро от Яндекс

Общая архитектура решения выглядит так:

1.

В контексте диалога с Нейро пользователь

задаёт какой-то вопрос.

2.

Вопрос пользователя трансформируется в

поисковый запрос.

3.

Поисковая

система

находит

топ

релевантных документов на запрос

пользователя.

4.

Из этого топа выбираются пять документов,

на основе которых получится построить

текстовый ответ.

5.

Специализированная генеративная модель

из семейства YandexGPT 3 получает на вход

диалог, запрос пользователя и полезные

фрагменты текстов из пяти документов.

19.

4. Что мы можем сделатьсамостоятельно

• поисковая проверка,

• кросс-проверка,

• цепочка верификации,

• проверка вглубь

20.

Ссылки на источники1. A Survey on Hallucination in Large Language Models:

Principles, Taxonomy, Challenges, and Open Questions

2. Siren’s Song in the AI Ocean: A Survey on Hallucination in

Large Language Models

3. Mitigating LLM Hallucinations via Conformal Abstention

4. GigaSearch или Поисковая система на GigaChat

https://habr.com/ru/companies/sberbank/articles/77318

0/

5. Как обнаружить галлюцинации в LLM?

https://habr.com/ru/companies/bothub/articles/805047/

6. https://github.com/vectara/hallucination-leaderboard

7. Яндекс запустил Нейро. Рассказываем, как он работает

https://habr.com/ru/companies/yandex/articles/807801/

Информатика

Информатика