Похожие презентации:

Понятие математической модели сигнала

1.

Понятие математической модели сигналаx = F(t, z, ω,...A, B, C,...),

2.

Математические модели детерминированных сигналовЭлементарные (тестовые) сигналы

1. Постоянный сигнал:

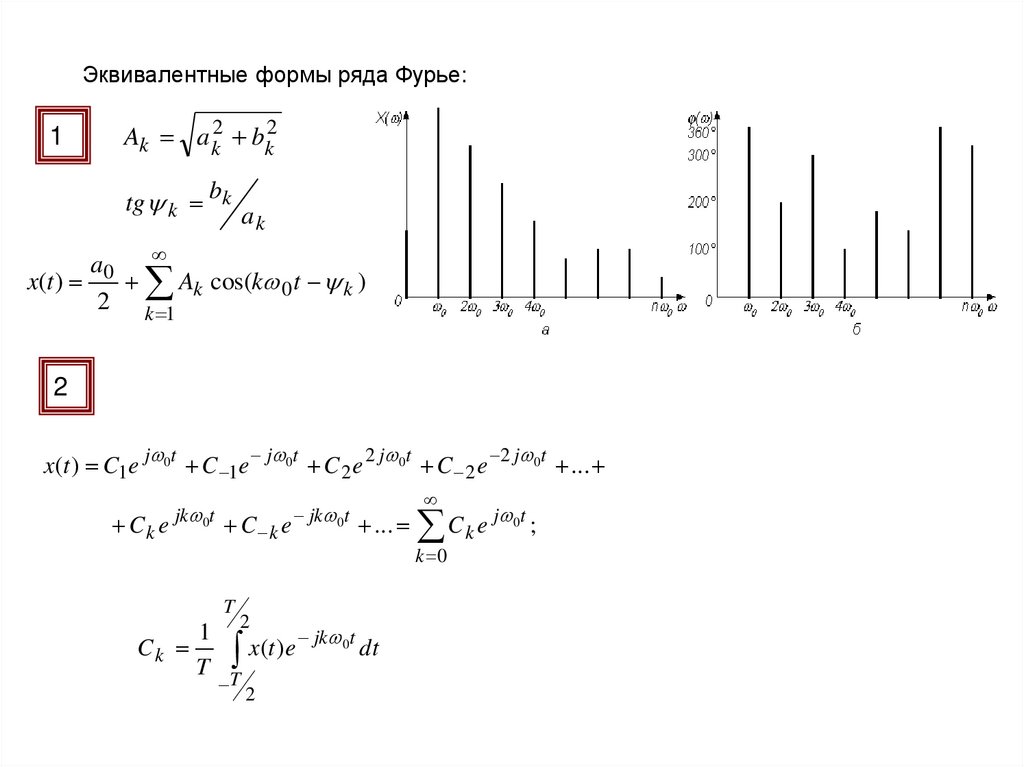

x=A; A=const

2. Идеальный единичный импульс:

t

(t t 0 )dt 1

0

(t t и )

x(t)

0

δ(t-tи)

x(t)

x(t ) (t t и )dt x(t и )

А

1/Δt

t

t

Δt

tи

x(t)

3. Гармонический сигнал:

x X м sin( t ) X м sin(

2 t

)

T

t

3.

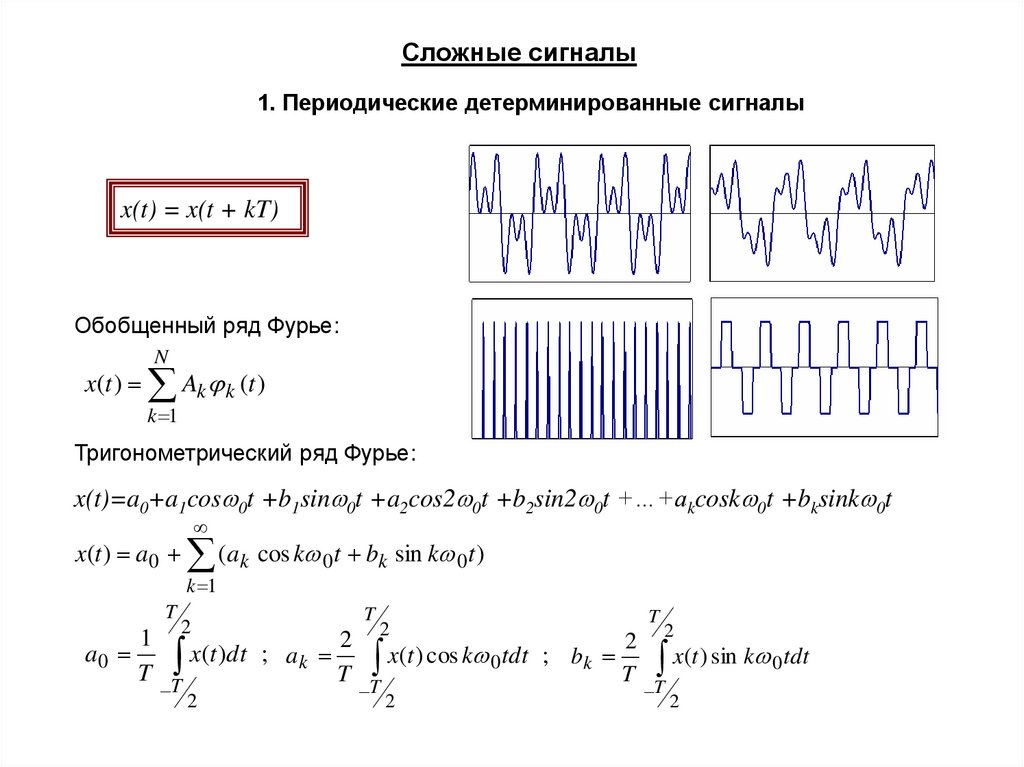

Сложные сигналы1. Периодические детерминированные сигналы

x(t) = x(t + kT)

Обобщенный ряд Фурье:

x(t )

N

Ak k (t )

k 1

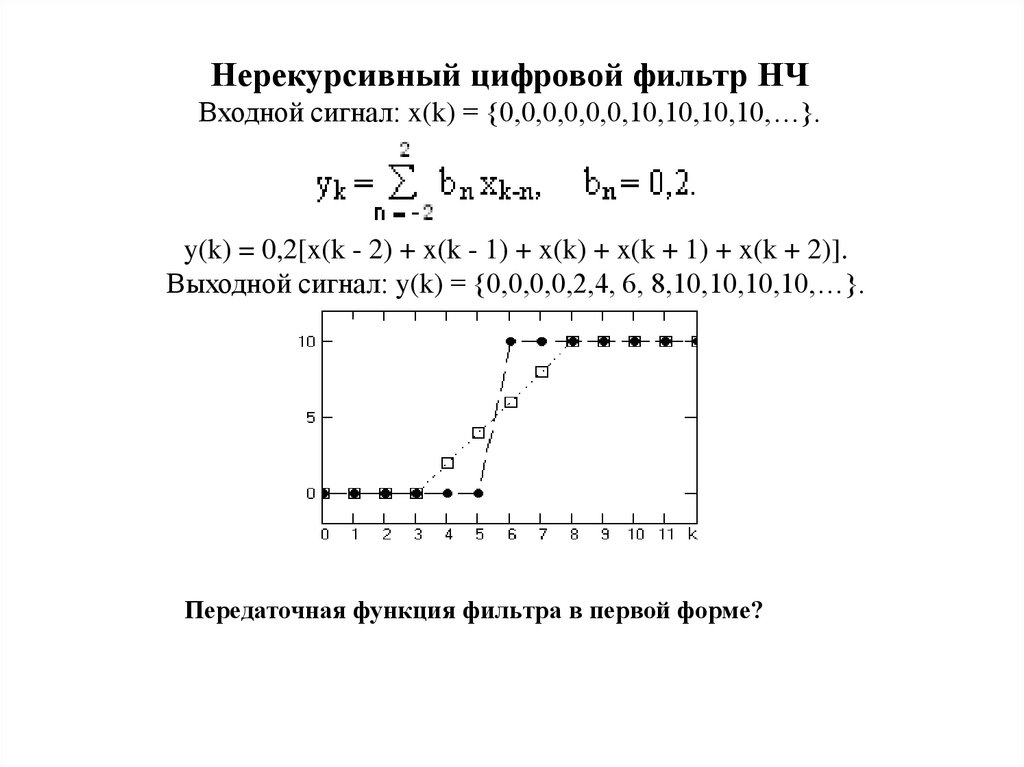

Тригонометрический ряд Фурье:

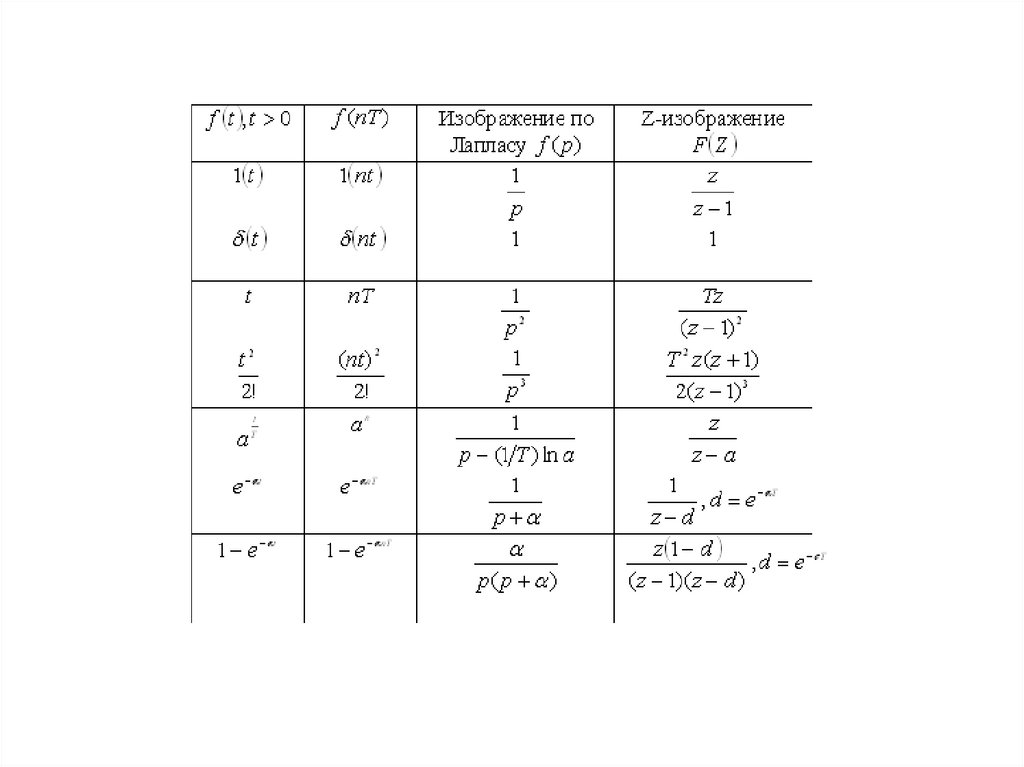

x(t)=a0+a1cos 0t +b1sin 0t +a2cos2 0t +b2sin2 0t +…+akcosk 0t +bksink 0t

(ak cos k 0t bk sin k 0t )

x(t ) a0

T

k 1

2

T

2

T

2

1

2

2

a0

x(t )dt ; a k

x(t ) cos k 0 tdt ; bk

x(t ) sin k 0 tdt

T T

T T

T T

2

2

2

4.

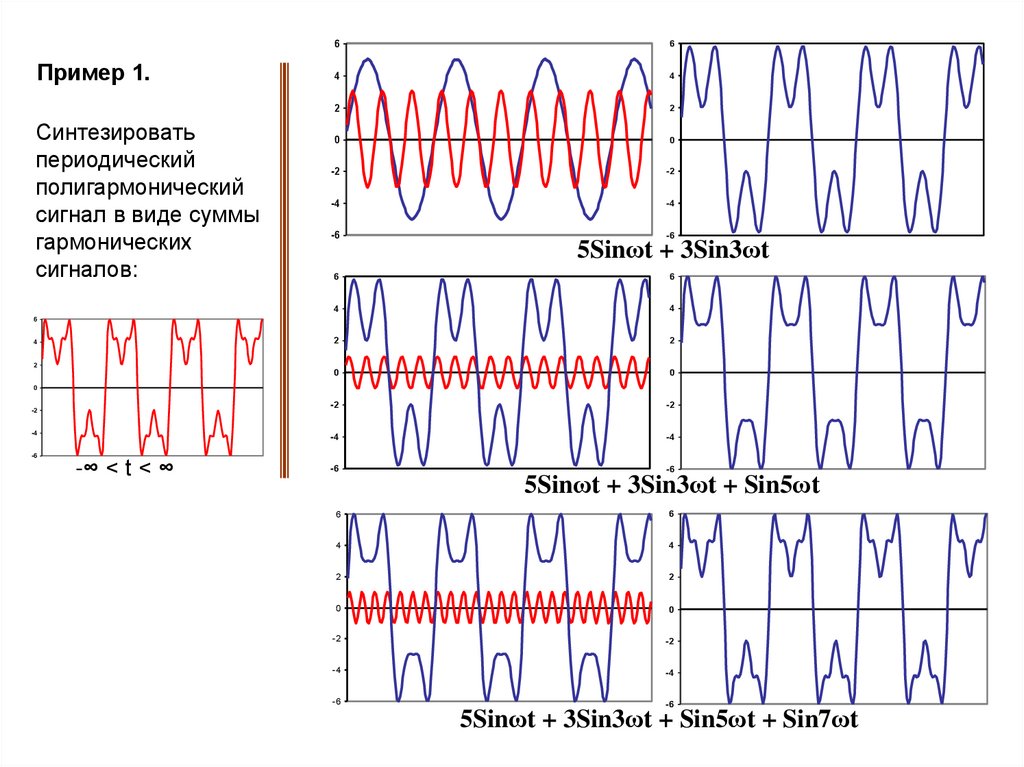

Пример 1.Синтезировать

периодический

полигармонический

сигнал в виде суммы

гармонических

сигналов:

6

6

4

4

2

2

0

0

-2

-2

-4

-4

-6

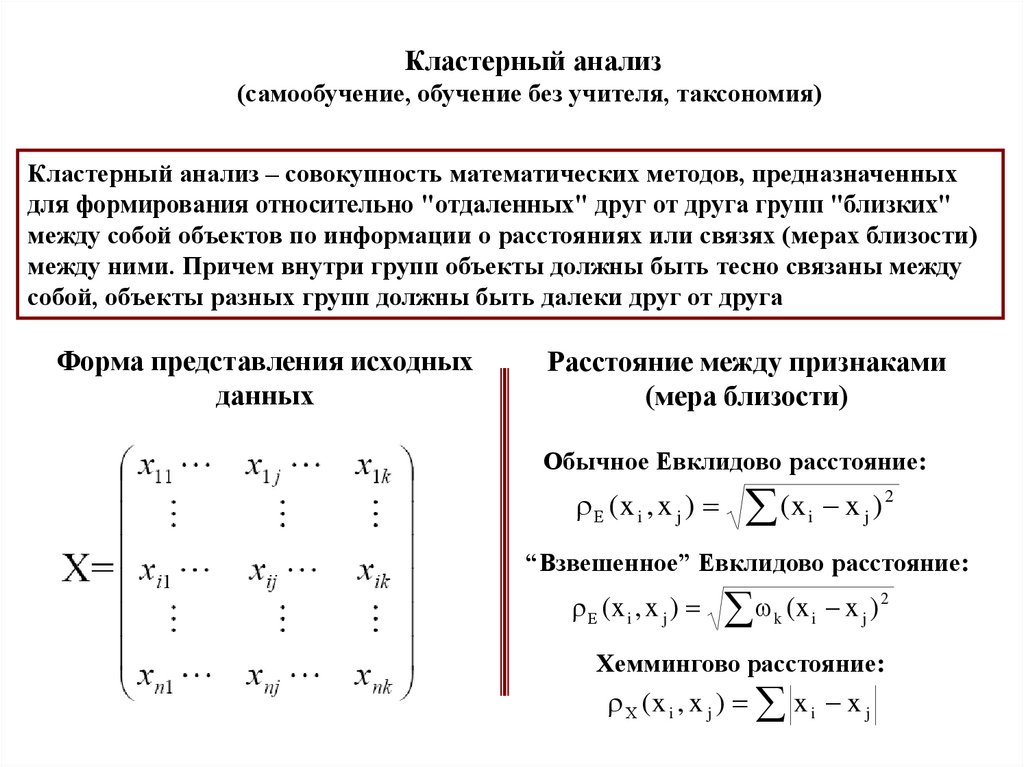

-6

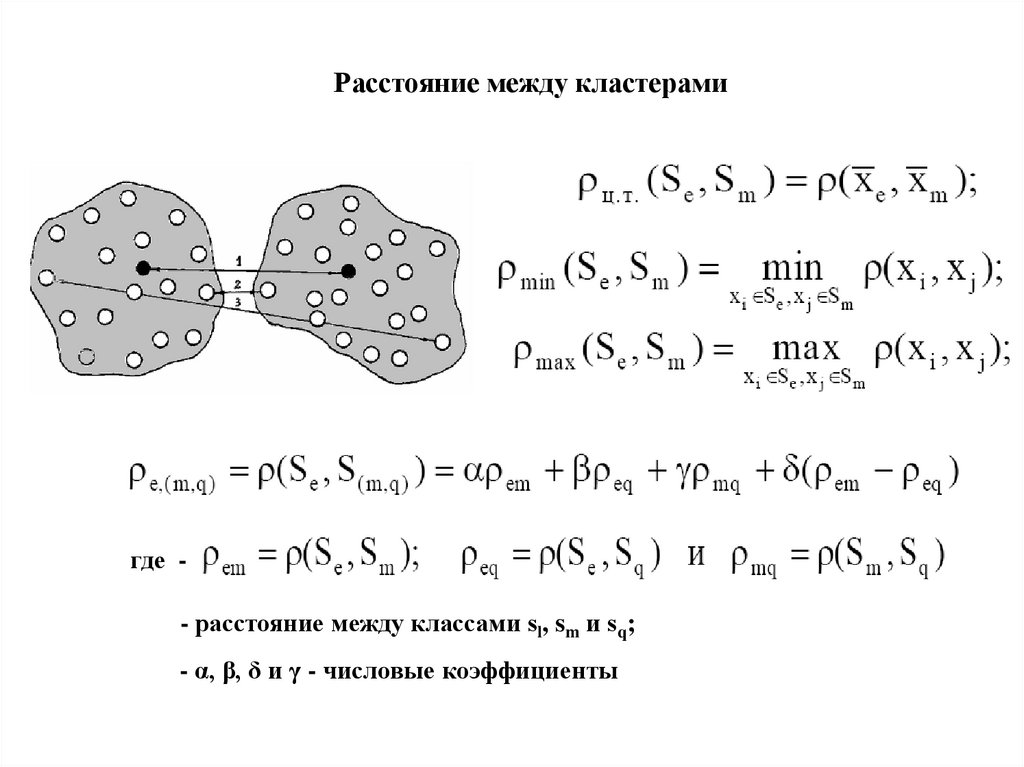

5Sinωt + 3Sin3ωt

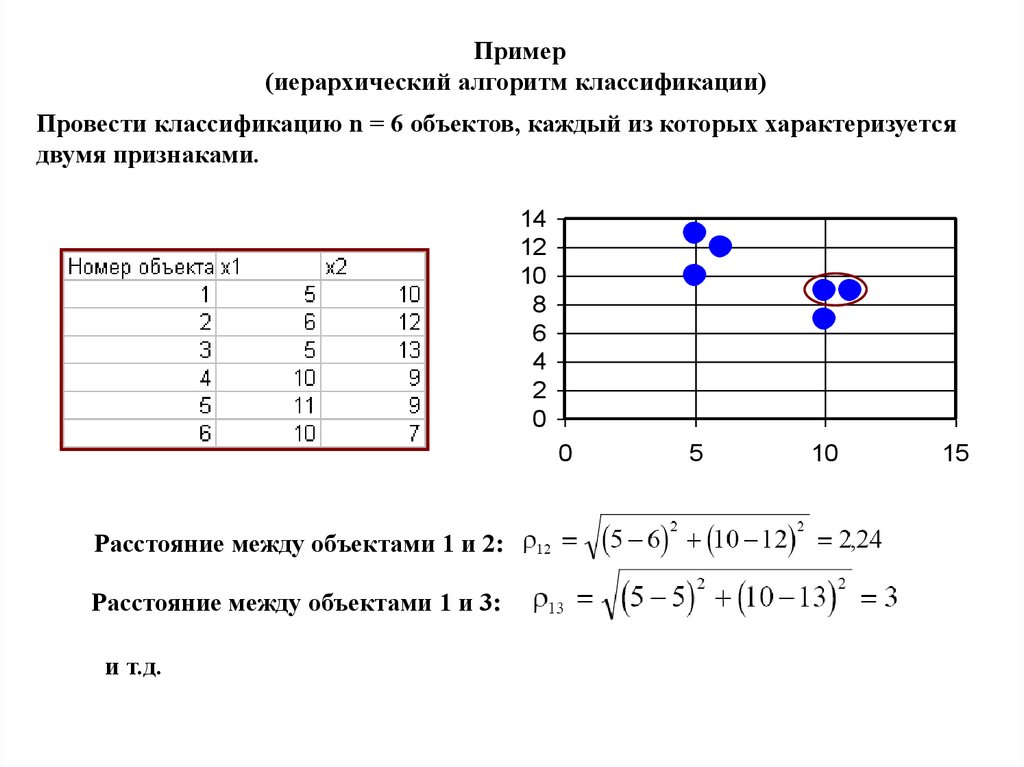

6

6

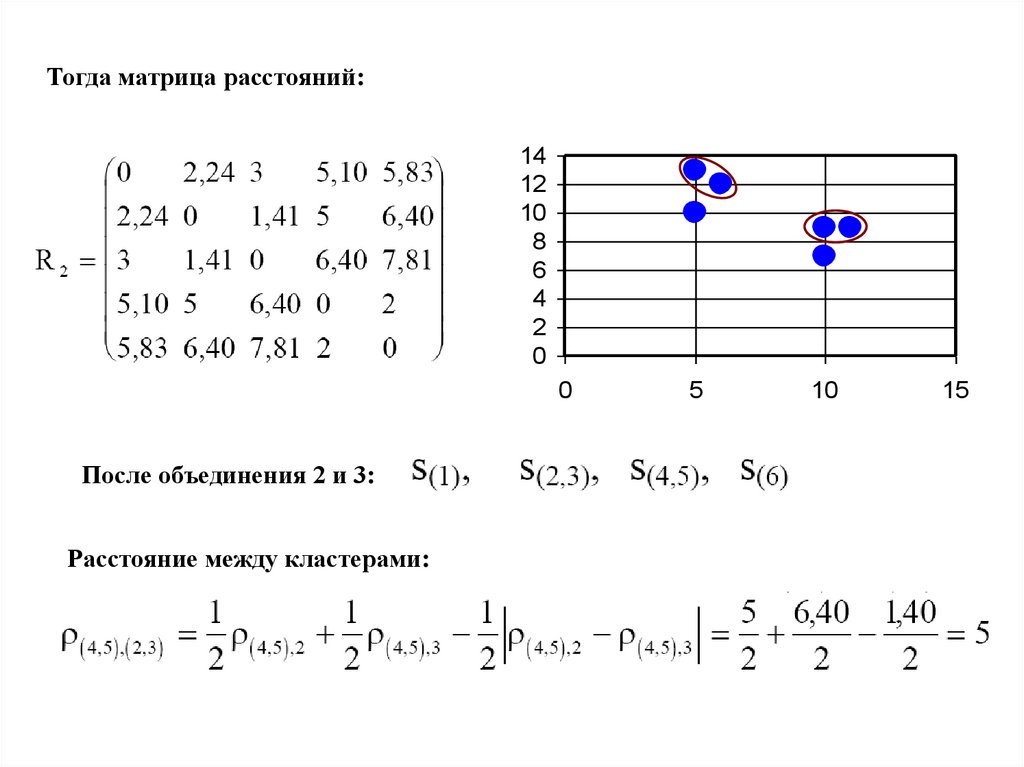

4

4

2

2

0

0

-2

-2

-4

-4

6

4

2

0

-2

-4

-6

-∞ < t < ∞

-6

-6

5Sinωt + 3Sin3ωt + Sin5ωt

6

6

4

4

2

2

0

0

-2

-2

-4

-4

-6

-6

5Sinωt + 3Sin3ωt + Sin5ωt + Sin7ωt

5.

Пример 2.Синтезировать

периодическую

последовательность

прямоугольных

импульсов в виде суммы

гармонических сигналов:

а0

0,6

1,2

1

0,8

f (t ) =

0,6

0,4

τ 2 ∞ 1

nωτ

+ ∑ sin

cos nωt

T π n =1 n

2

0,2

0

1,4

-∞ < t < ∞

n=1

1,2

1,2

n=2

1

0,5

1

0,8

0,8

0,4

0,6

0,6

0,3

0,4

0,2

0,4

0,2

0,2

0

0,1

0

-0,2

0

-0,2

-0,4

1,2

n=3

1,2

n=9

1,2

1

1

1

0,8

0,8

0,8

0,6

0,6

0,6

0,4

0,4

0,4

0,2

0,2

0,2

0

0

0

-0,2

-0,2

-0,2

n = 12

6.

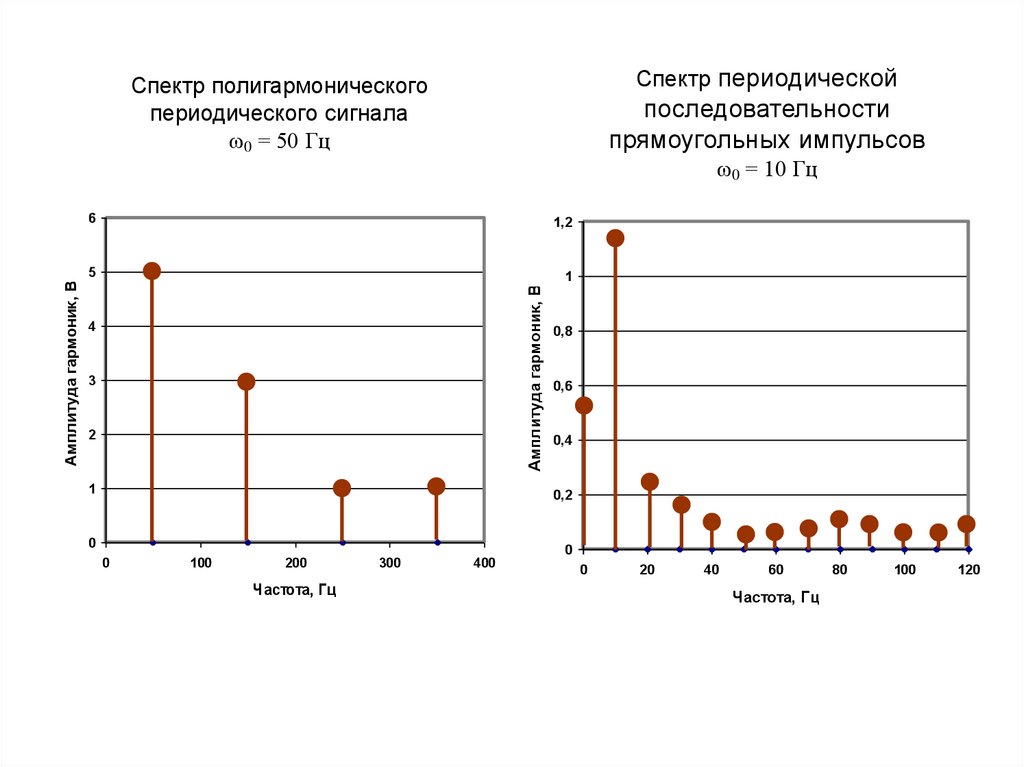

Спектр периодическойСпектр полигармонического

периодического сигнала

ω0 = 50 Гц

последовательности

прямоугольных импульсов

6

1,2

5

1

Амплитуда гармоник, В

Амплитуда гармоник, В

ω0 = 10 Гц

4

3

2

1

0,8

0,6

0,4

0,2

0

0

100

200

Частота, Гц

300

400

0

0

20

40

60

Частота, Гц

80

100

120

7.

Эквивалентные формы ряда Фурье:1

Ak a k2 bk2

b

tg k k

ak

a0

x(t )

Ak cos(k 0 t k )

2 k 1

2

x(t ) C1e j 0t C 1e j 0t C 2 e 2 j 0t C 2 e 2 j 0t ...

Ck e

jk 0t

C k e

T

2

jk 0t

...

1

Ck

x(t )e jk 0t dt

T T

2

C k e j t ;

0

k 0

8.

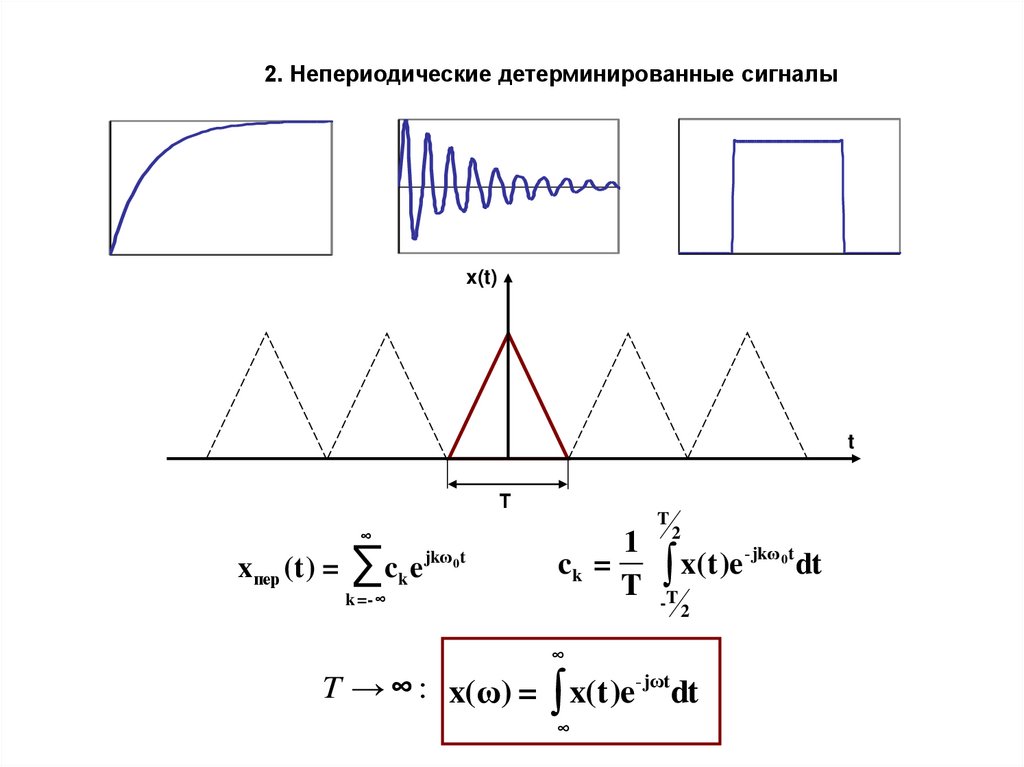

2. Непериодические детерминированные сигналыx(t)

t

Т

∞

x пер (t ) = ∑ ck e jkω0t

k =- ∞

T

1 2

- jkω 0 t

ck =

x

(

t

)

e

dt

∫

T -T

2

∞

T → ∞ : x(ω) = ∫ x(t )e- jωt dt

∞

9.

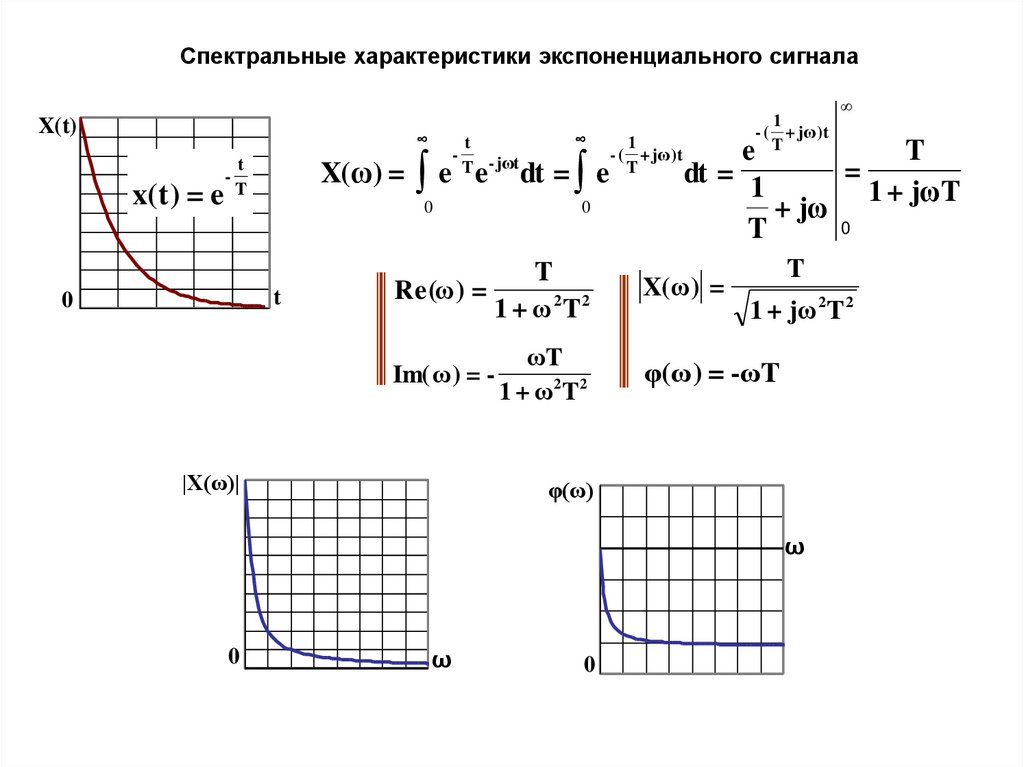

Спектральные характеристики экспоненциального сигналаX(t)

∞

x(t ) = e

-

t

T - jωt

X(ω) = ∫ e e

t

T

0

t

0

∞

dt = ∫ e

0

T

Re(ω ) =

1 + ω 2T 2

Im( ω ) = -

|X(ω)|

ωT

1 + ω 2T 2

1

- ( + jω ) t

T

1

- ( + jω ) t

T

e

T

=

dt =

1

1 + jωT

+ jω

0

T

X(ω ) =

T

1 + jω 2T 2

φ(ω) = -ωT

φ(ω)

ω

0

ω

0

∞

10.

x(t)Спектр прямоугольного импульса

tu

2

tu

ht

sin(

ω

)

и

h - jωt

h

2

- jωt

- jωt

jωt

x(ω) = ∫ he dt = e

=

(-e + e ) =

tи

j

ω

j

ω

tu

ω

t

2

- u

2

2

tu

2

h

t

tи

x(ω)

2π

tи

4π

tи

6π

tи

x(ω)

ω

x(ω)

ω

ω

11.

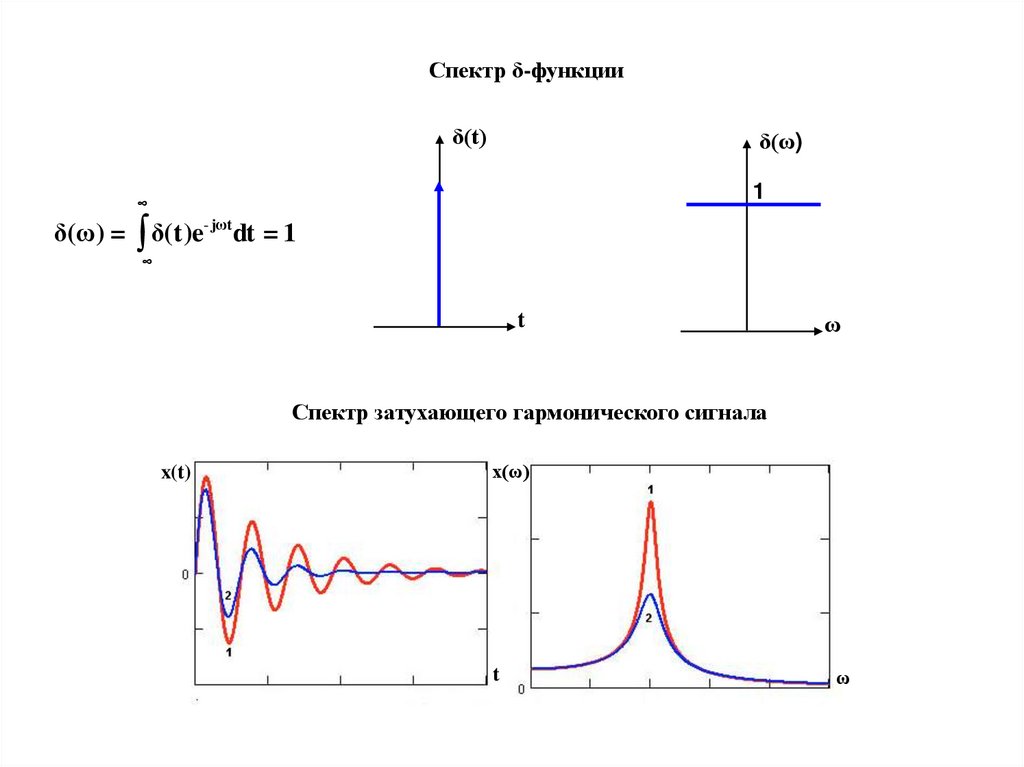

Спектр δ-функцииδ(t)

δ(ω)

1

∞

δ(ω) = ∫ δ(t )e- jωtdt = 1

∞

t

ω

Спектр затухающего гармонического сигнала

x(t)

x(ω)

t

ω

12.

3. Почти периодические детерминированные сигналыx(t ) = Sin ( 2ωt ) + Sin (5ωt ) + Sin (9ωt )

x(t ) = Sin ( 2ωt ) + Sin(5ωt ) + Sin( 81ωt )

x(ω)

x(t)

t

ω

x(ω)

x(t)

t

ω

13.

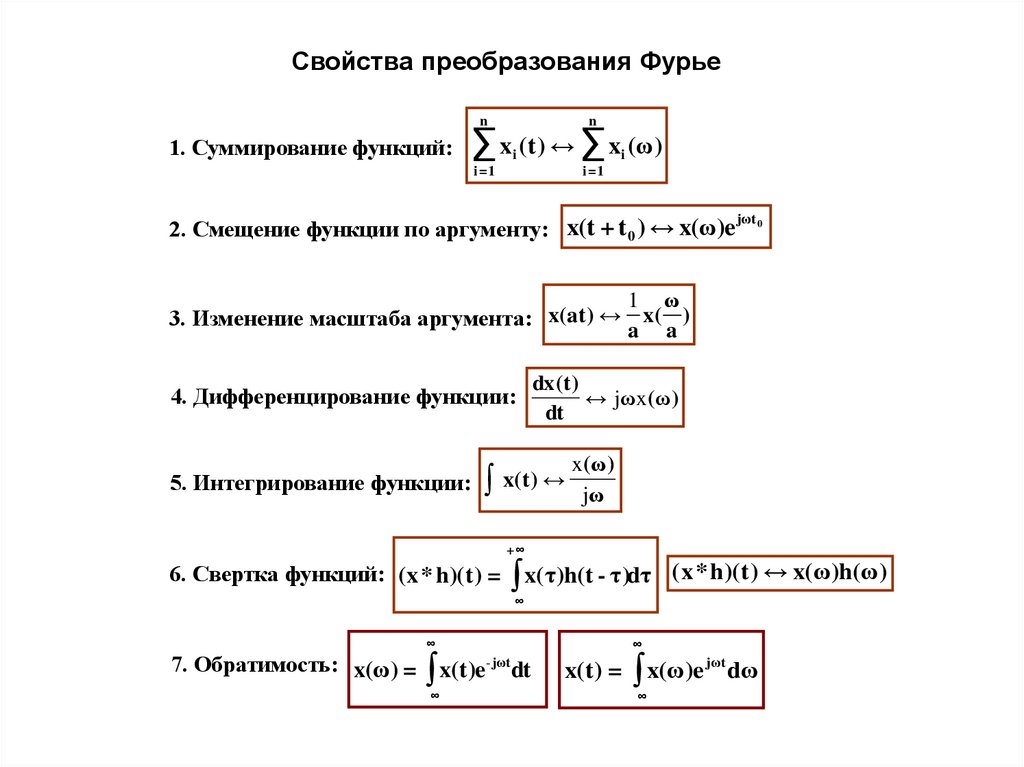

Свойства преобразования Фурьеn

1. Суммирование функций:

n

∑ x ( t ) ↔ ∑ x (ω )

i

i

i =1

i =1

jωt

2. Смещение функции по аргументу: x(t + t 0 ) ↔ x(ω)e 0

1 ω

3. Изменение масштаба аргумента: x(at ) ↔ x( )

a a

4. Дифференцирование функции:

dx (t )

↔ jωx ( ω )

dt

5. Интегрирование функции: ∫ x(t ) ↔

x (ω )

jω

+∞

6. Свертка функций: ( x * h)( t ) = ∫ x( τ )h(t - τ )dτ ( x * h )( t ) ↔ x(ω )h(ω )

∞

∞

7. Обратимость: x(ω) =

∫ x(t )e

∞

∞

- jωt

dt

x(t ) = ∫ x(ω)e jωt dω

∞

14.

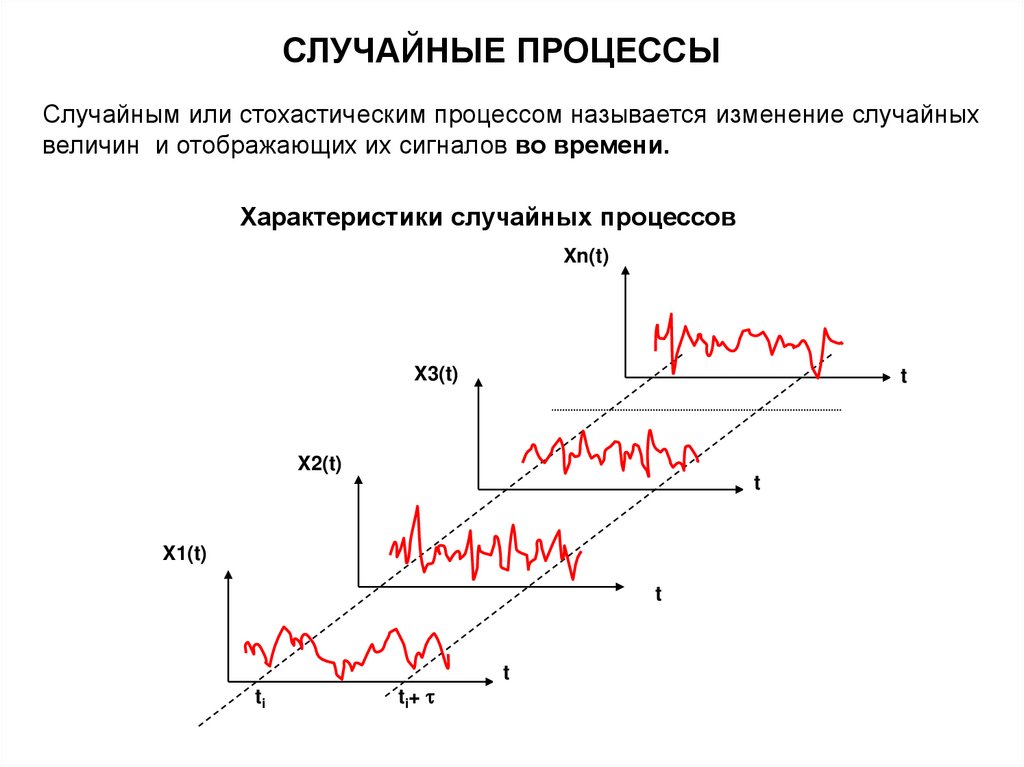

СЛУЧАЙНЫЕ ПРОЦЕССЫСлучайным или стохастическим процессом называется изменение случайных

величин и отображающих их сигналов во времени.

Характеристики случайных процессов

Xn(t)

X3(t)

t

X2(t)

t

X1(t)

t

ti

ti +

t

15.

Выборочная функция случайного процесса X(t) - единичная реализацияслучайного процесса на определенном временном интервале xk(t) из n

возможных реализаций, образующих статистический ансамбль.

Полная статистическая характеристика случайного процесса - n-мерная

плотность вероятностей P(xn;tn).

Одномерное сечение случайного процесса X(t):

- совокупность значений всех реализаций случайного процесса в

произвольный момент времени ti,

- совокупность значений k-той реализации случайного процесса за все время

существования процесса.

Математическое ожидание случайного процесса по ансамблю реализаций

в фиксированном сечении ti:

N

1

x ( t i ) lim X k ( t i )

N N

k 1

где N – число выборочных функций.

Функция дисперсии случайного процесса - оценка среднего взвешенного

значения разности:

Dx(t) = M{[Хk(t)- μx(ti)]2}.

16.

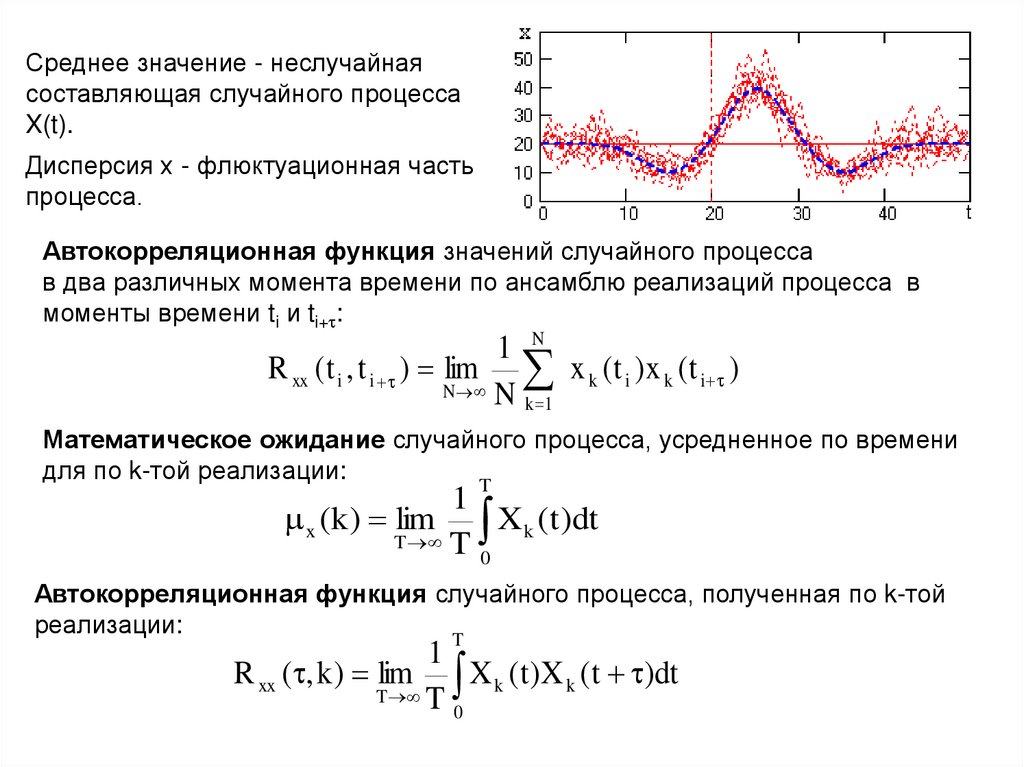

Среднее значение - неслучайнаясоставляющая случайного процесса

X(t).

Дисперсия х - флюктуационная часть

процесса.

Автокорреляционная функция значений случайного процесса

в два различных момента времени по ансамблю реализаций процесса в

моменты времени ti и ti+ :

1 N

R xx ( t i , t i ) lim x k ( t i ) x k ( t i )

N N

k 1

Математическое ожидание случайного процесса, усредненное по времени

для по k-той реализации:

T

1

X k ( t )dt

T T

0

x (k ) lim

Автокорреляционная функция случайного процесса, полученная по k-той

реализации:

T

1

X k ( t )X k ( t )dt

T T

0

R xx ( , k ) lim

17.

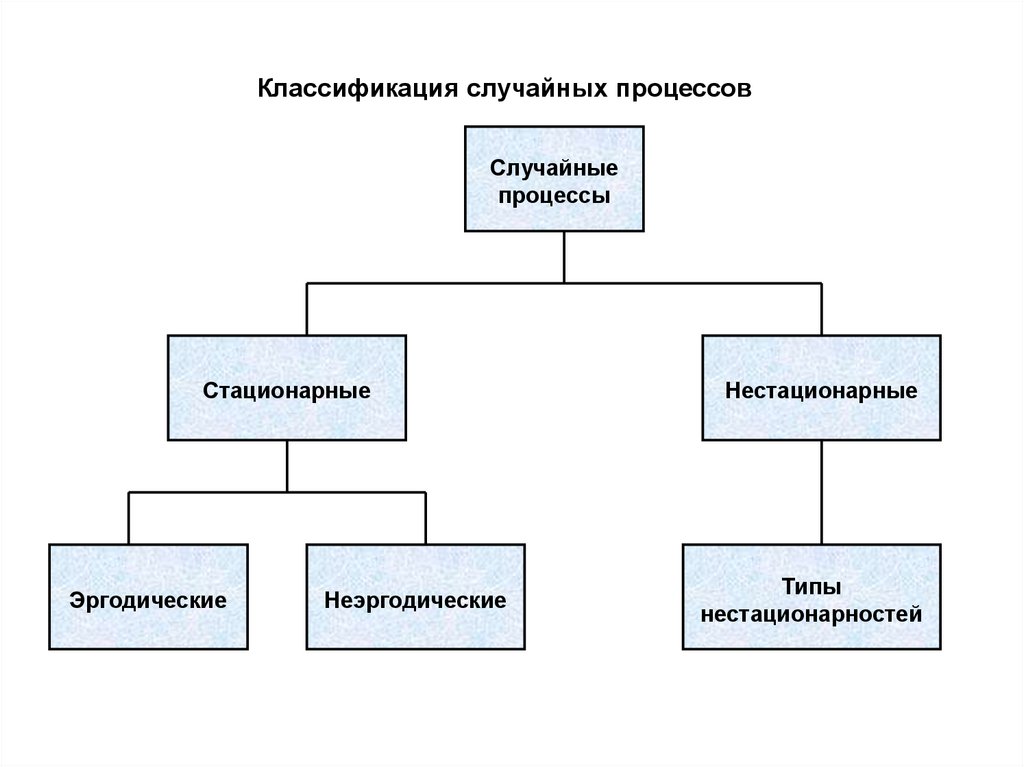

Классификация случайных процессовСлучайные

процессы

Стационарные

Эргодические

Неэргодические

Нестационарные

Типы

нестационарностей

18.

Если среднее μx(t) и автокорреляционная функция Rxx(ti,ti+τ) не зависятот момента времени ti, случайный процесс называется стационарным.

Стационарный процесс

Нестационарные процессы

19.

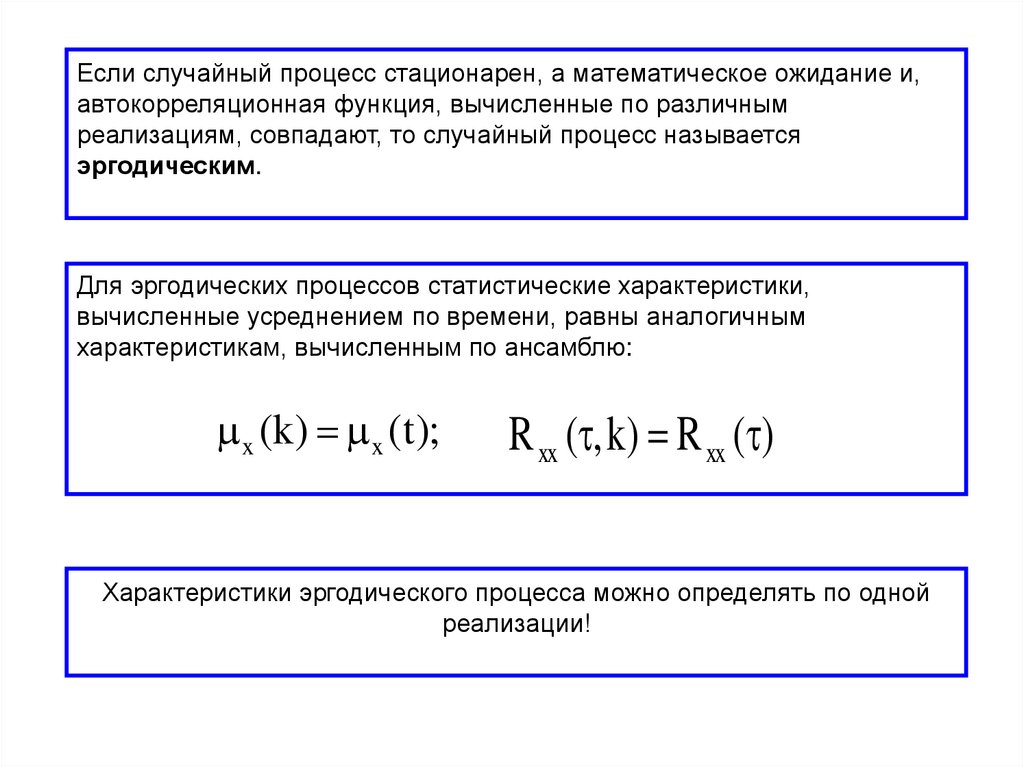

Если случайный процесс стационарен, а математическое ожидание и,автокорреляционная функция, вычисленные по различным

реализациям, совпадают, то случайный процесс называется

эргодическим.

Для эргодических процессов статистические характеристики,

вычисленные усреднением по времени, равны аналогичным

характеристикам, вычисленным по ансамблю:

x (k) x (t );

R xx ( , k) R xx ( )

Характеристики эргодического процесса можно определять по одной

реализации!

20. КВАНТОВАНИЕ И ДИСКРЕТИЗАЦИЯ СИГНАЛОВ

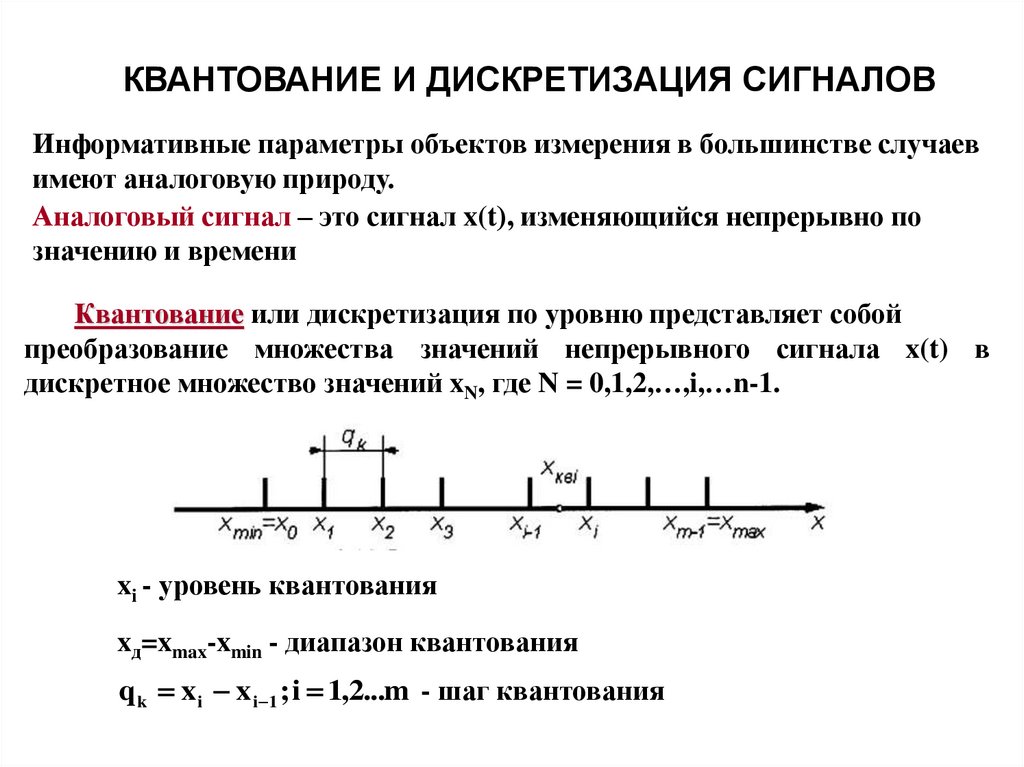

Информативные параметры объектов измерения в большинстве случаевимеют аналоговую природу.

Аналоговый сигнал – это сигнал x(t), изменяющийся непрерывно по

значению и времени

Квантование или дискретизация по уровню представляет собой

преобразование множества значений непрерывного сигнала x(t) в

дискретное множество значений xN, где N = 0,1,2,…,i,…n-1.

xi - уровень квантования

xд=xmax-xmin - диапазон квантования

q k x i x i 1 ; i 1,2...m - шаг квантования

21.

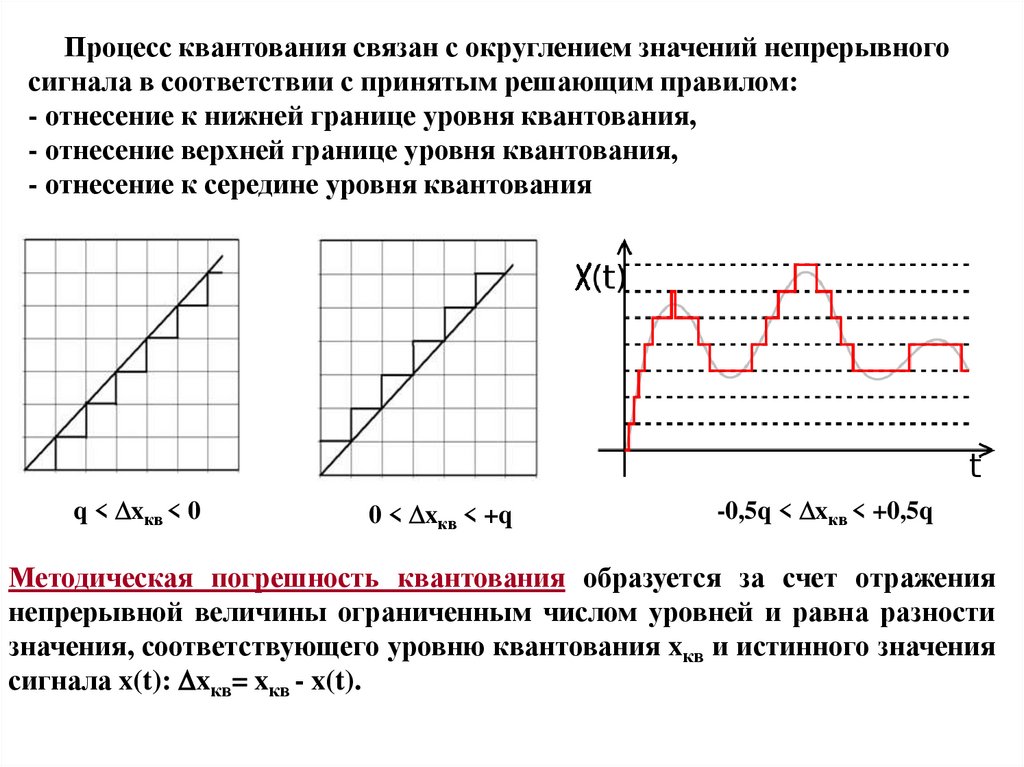

Процесс квантования связан с округлением значений непрерывногосигнала в соответствии с принятым решающим правилом:

- отнесение к нижней границе уровня квантования,

- отнесение верхней границе уровня квантования,

- отнесение к середине уровня квантования

q < xкв < 0

0 < xкв < +q

-0,5q < xкв < +0,5q

Методическая погрешность квантования образуется за счет отражения

непрерывной величины ограниченным числом уровней и равна разности

значения, соответствующего уровню квантования xкв и истинного значения

сигнала x(t): xкв= xкв - x(t).

22.

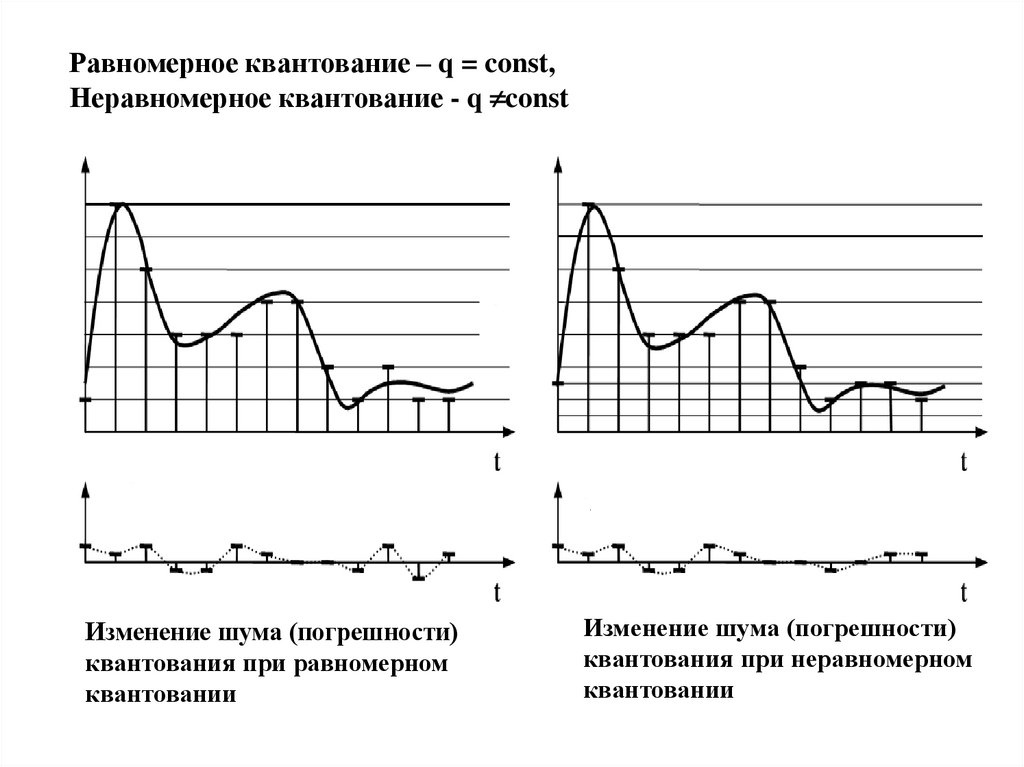

Равномерное квантование – q = const,Неравномерное квантование - q const

Изменение шума (погрешности)

квантования при равномерном

квантовании

Изменение шума (погрешности)

квантования при неравномерном

квантовании

23.

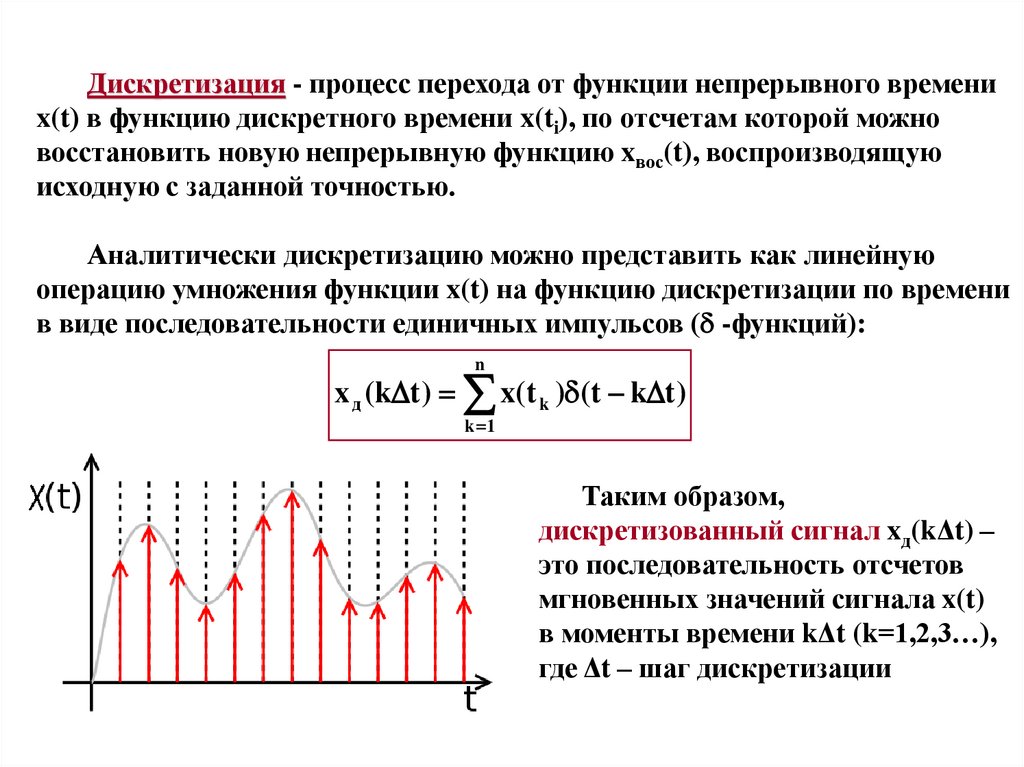

Дискретизация - процесс перехода от функции непрерывного времениx(t) в функцию дискретного времени x(ti), по отсчетам которой можно

восстановить новую непрерывную функцию xвос(t), воспроизводящую

исходную с заданной точностью.

Аналитически дискретизацию можно представить как линейную

операцию умножения функции x(t) на функцию дискретизации по времени

в виде последовательности единичных импульсов ( -функций):

n

x д (k t ) x(t k ) (t k t )

k 1

Таким образом,

дискретизованный сигнал xд(kΔt) –

это последовательность отсчетов

мгновенных значений сигнала x(t)

в моменты времени kΔt (k=1,2,3…),

где Δt – шаг дискретизации

24.

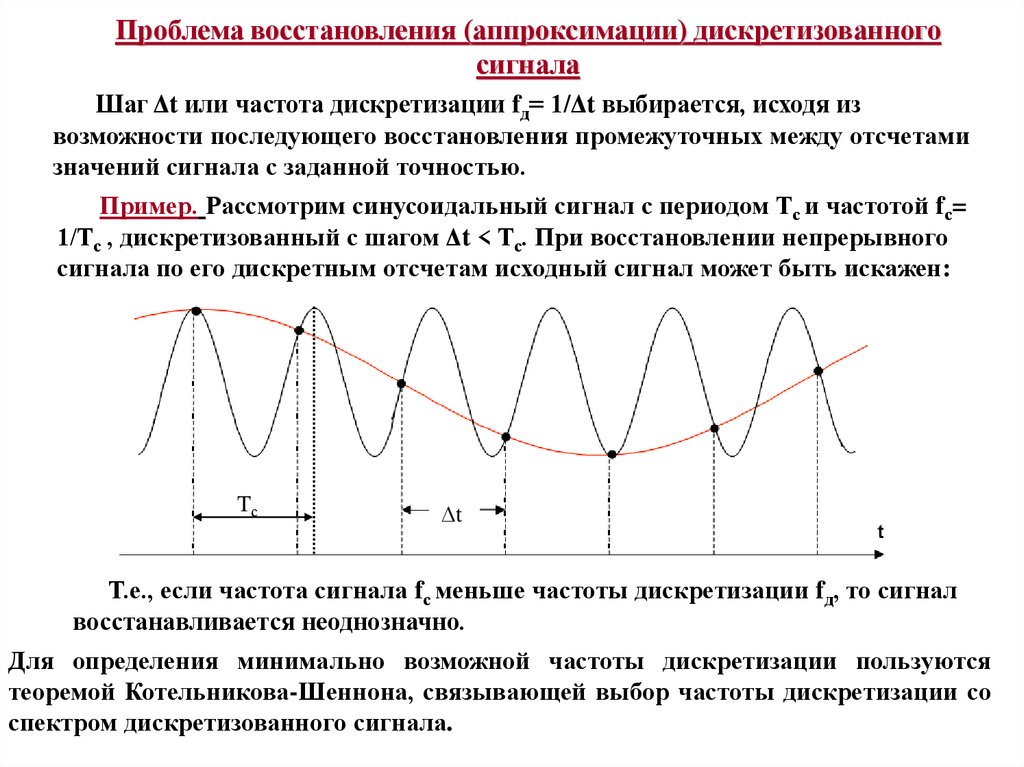

Проблема восстановления (аппроксимации) дискретизованногосигнала

Шаг Δt или частота дискретизации fд= 1/Δt выбирается, исходя из

возможности последующего восстановления промежуточных между отсчетами

значений сигнала с заданной точностью.

Пример. Рассмотрим синусоидальный сигнал с периодом Тс и частотой fс=

1/Тс , дискретизованный с шагом Δt < Тс. При восстановлении непрерывного

сигнала по его дискретным отсчетам исходный сигнал может быть искажен:

Tс

Δt

Т.е., если частота сигнала fс меньше частоты дискретизации fд, то сигнал

восстанавливается неоднозначно.

Для определения минимально возможной частоты дискретизации пользуются

теоремой Котельникова-Шеннона, связывающей выбор частоты дискретизации со

спектром дискретизованного сигнала.

25.

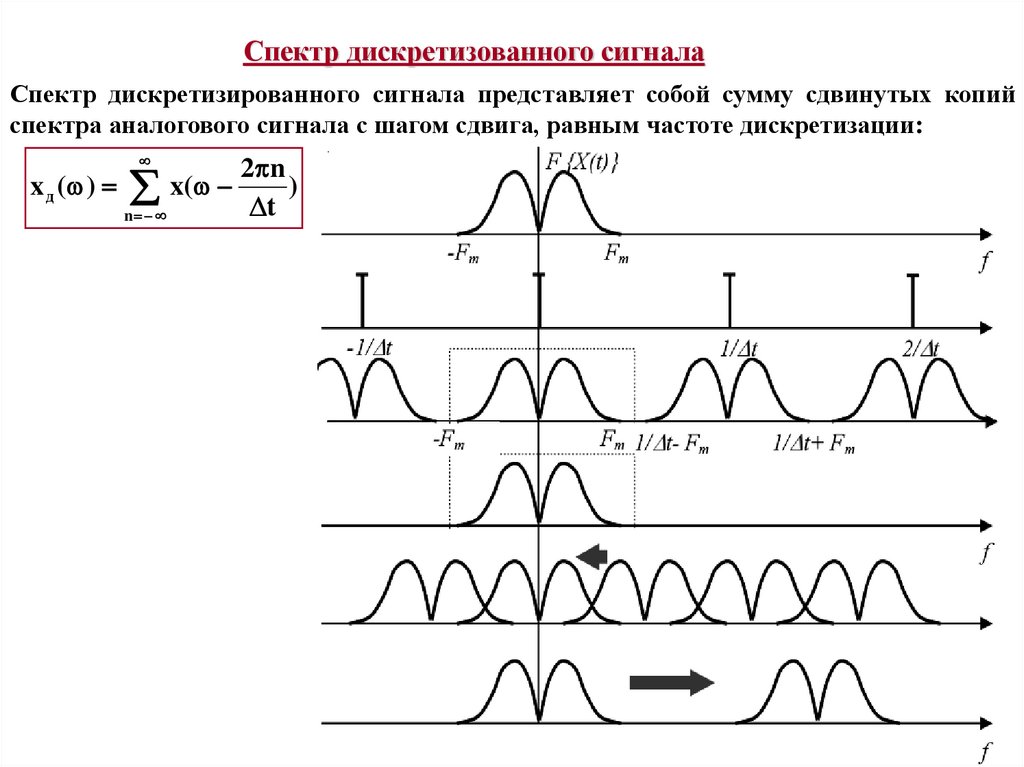

Спектр дискретизованного сигналаСпектр дискретизированного сигнала представляет собой сумму сдвинутых копий

спектра аналогового сигнала с шагом сдвига, равным частоте дискретизации:

x д ( ) x(

n

2 n

)

t

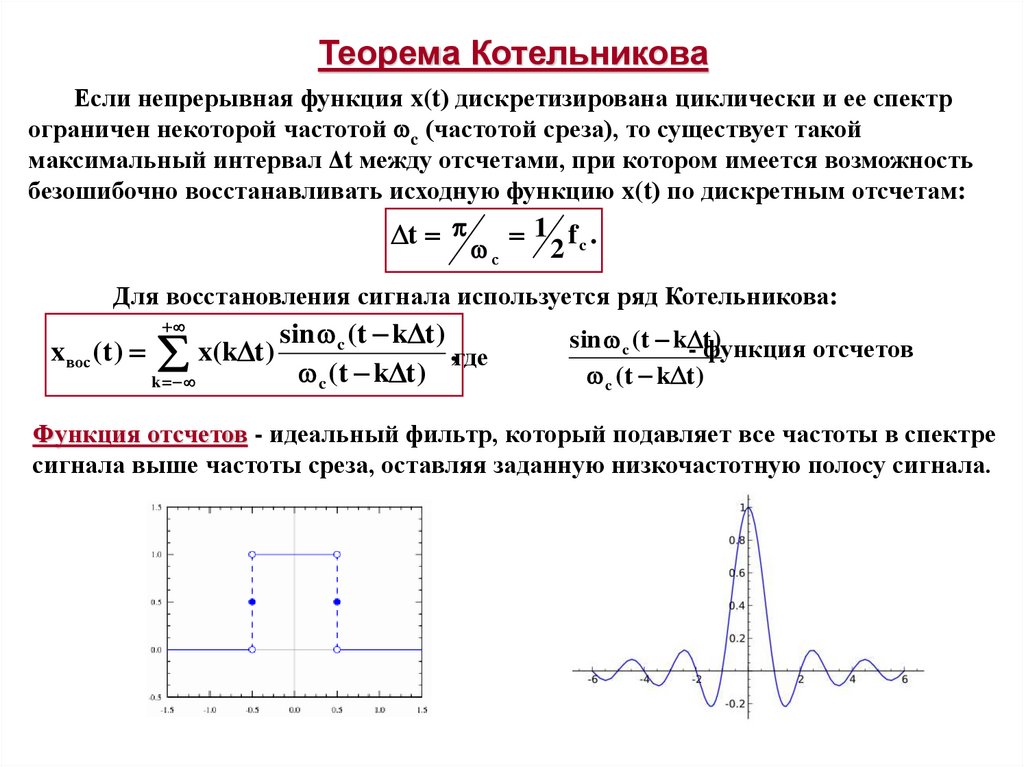

26. Теорема Котельникова

Если непрерывная функция x(t) дискретизирована циклически и ее спектрограничен некоторой частотой c (частотой среза), то существует такой

максимальный интервал Δt между отсчетами, при котором имеется возможность

безошибочно восстанавливать исходную функцию x(t) по дискретным отсчетам:

t

1 fc .

с

2

Для восстановления сигнала используется ряд Котельникова:

xвос (t ) x(k t )

k

sin c (t k t )

,где

c (t k t )

sin c (t k

)

- tфункция

отсчетов

c (t k t )

Функция отсчетов - идеальный фильтр, который подавляет все частоты в спектре

сигнала выше частоты среза, оставляя заданную низкочастотную полосу сигнала.

27. Практические способы восстановления непрерывного сигнала

Аппроксимация рядом КотельниковаНа практике реализовать полное восстановление сигнала без погрешностей с

помощью ряда Котельникова невозможно.

Причины:

1. Экспериментальные сигналы всегда ограничены во времени, а

следовательно, имеют бесконечные спектры; поэтому восстановление сигнала

всегда происходит с определенной погрешностью из-за потери высокочастотной

составляющей сигнала.

2. Идеальный sinc-фильтр физически нереализуем в силу бесконечного

порядка передаточной функции и бесконечности ядра по времени в обе стороны

(это накладывает ограничения на его реализацию как во временно́й области,

так и в частотной).

28. Фильтрация измерительных сигналов

Фильтрация - выделение из сигнала его части, спектр которойлежит в определенной области частот.

Задачи фильтрации:

1) выделение полезного сигнала на фоне помех,

2) частотный анализ.

Виды фильтрации

По виду преобразований: аналоговая и цифровая.

По расположению полос пропускания:

фильтрация нижних частот,

фильтрация верхних частот,

полосовая фильтрация.

По виду математического описания: линейная и нелинейная.

29. Характеристики фильтров

Амплитудно-частотная характеристика (АЧХ), или модулькомплексной частотной функции: |W(j )|.

Логарифмическая крутизна фильтра:

d ln[ W( jω)]

χ=

d lg ω

Переходная характеристика, реакция на единичное входное

воздействие.

Импульсная характеристика h(t), реакция на δ-функцию.

Фазочастотная характеристика φ(ω).

Фазовая задержка

d[φ(ω)]

dω

30.

Типы и условияфизической реализации фильтров

|W(jω)|

1 – идеальный,

2 – идеализированный,

3 - реальный

Физически реализуемый фильтр, условия каузальности:

→

2)h(t) 0 при t ∞

→

1)h( t) =0 при t =0

Математический (физически не реализуемый) фильтр:

h( t) ≠0 при t ≤0

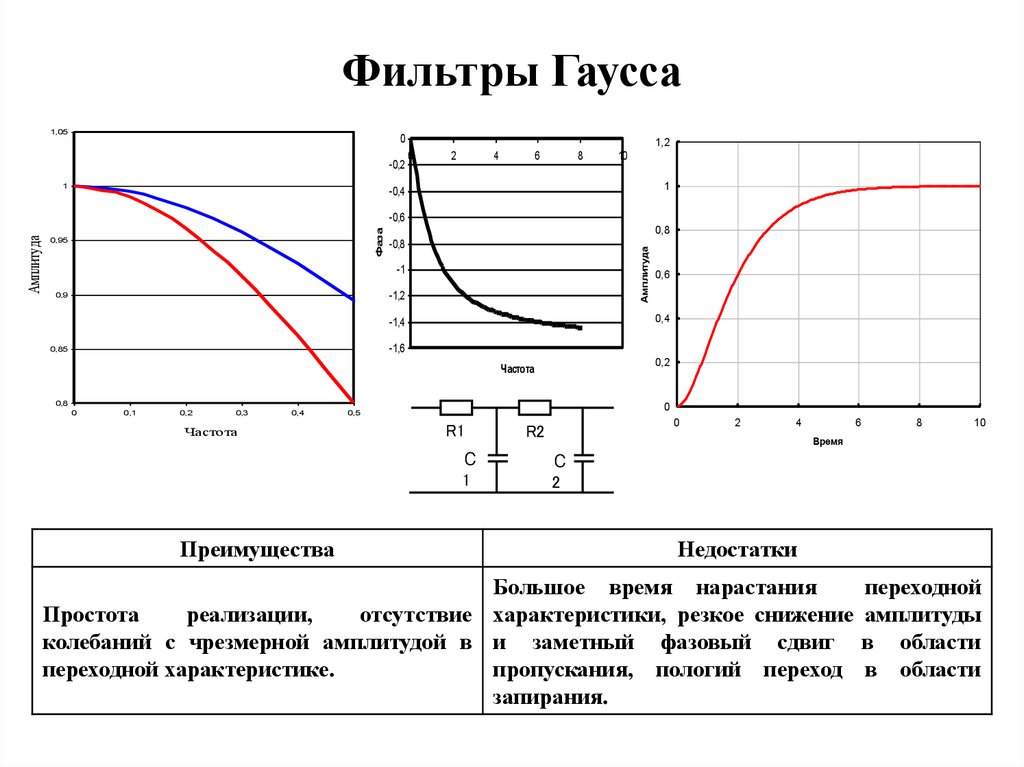

31. Фильтры Гаусса

1,050

-0,2

1

1,2

0

2

4

6

8

10

1

-0,4

0,8

-0,8

Амплитуда

Фаза

Амплитуда

-0,6

0,95

-1

-1,2

0,9

0,6

0,4

-1,4

-1,6

0,85

0,2

Частота

0,8

0

0,1

0,2

0,3

0,4

Частота

0

0,5

R1

С

1

Преимущества

0

R2

2

4

6

8

10

Время

С

2

Недостатки

Большое время нарастания

переходной

Простота

реализации,

отсутствие характеристики, резкое снижение амплитуды

колебаний с чрезмерной амплитудой в и заметный фазовый сдвиг в области

переходной характеристике.

пропускания, пологий переход в области

запирания.

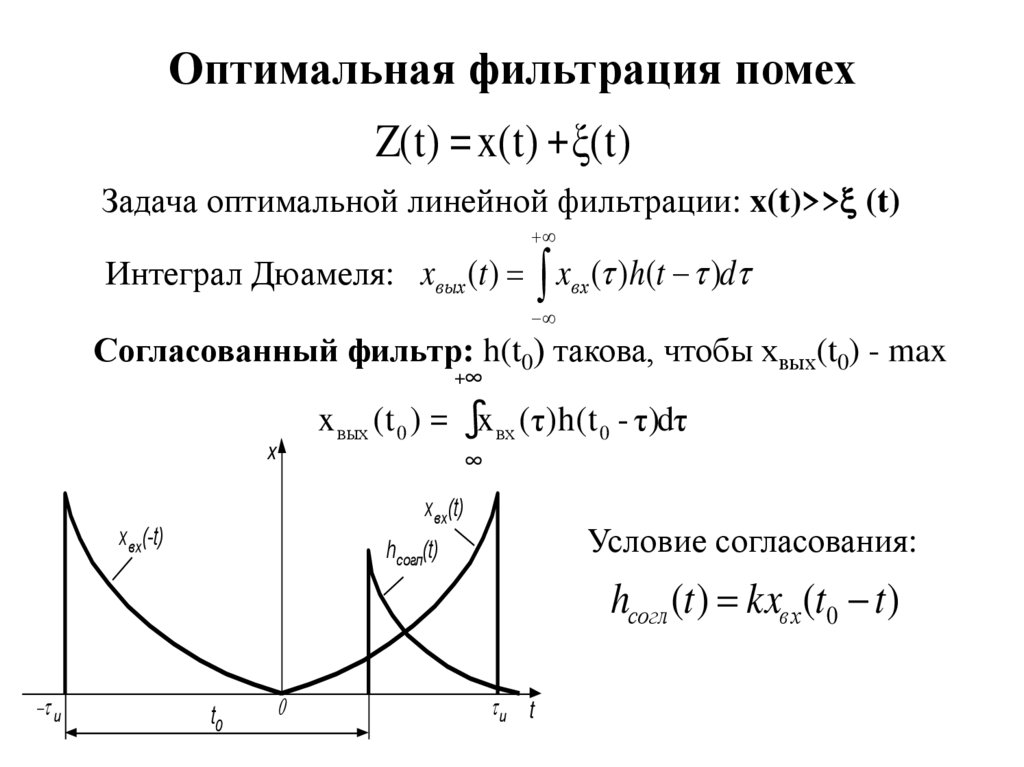

32. Оптимальная фильтрация помех

Z(t) = x(t) +ξ(t)Задача оптимальной линейной фильтрации: x(t)>> (t)

Интеграл Дюамеля: xвых (t ) xвх ( )h(t )d

Согласованный фильтр: h(t0) такова, чтобы хвых(t0) - max

+∞

x вых ( t 0 ) = ∫

x вх ( τ)h( t 0 - τ)dτ

x

∞

xвх(t)

xвх(-t)

Условие согласования:

hсогл(t)

hсогл (t ) kxвх (t0 t )

и

t0

и t

33.

Фильтры ЧебышеваПреимущества

Недостатки

Крутой

переход

из

области

пропускания к области затухания;

АЧХ

наиболее

близко

приближается к характеристике

идеального фильтра.

Сильная волнистость АЧХ в области пропускания;

сильно изменяющаяся фазовая характеристика в

области пропускания; колебания с чрезмерной

амплитудой и более продолжительное время

установления

колебаний

по

переходной

характеристике.

34. Фильтры Бесселя

Передаточная функция фильтра Бесселятретьего порядка

Модуль частотной функции

фазо-частотная характеристика

Групповая задержка фильтра:

Преимущества

Недостатки

Линейная

фазовая характеристика в

Ранее падение амплитуды в области

области

пропускания,

практически

пропускания, плавный переход к области

отсутствие

колебаний в переходной

запирания.

характеристике.

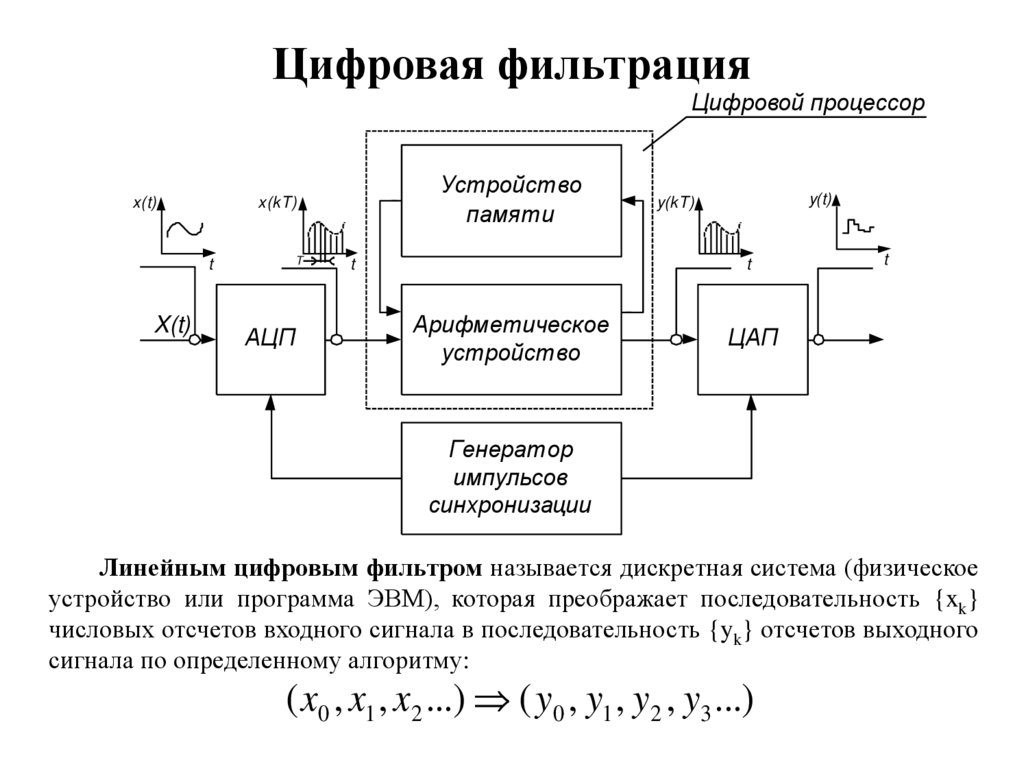

35. Цифровая фильтрация

Цифровой процессорx(t)

T

t

X(t)

Устройство

памяти

x(kT)

АЦП

t

y(t)

y(kT)

t

Арифметическое

устройство

t

ЦАП

Генератор

импульсов

синхронизации

Линейным цифровым фильтром называется дискретная система (физическое

устройство или программа ЭВМ), которая преображает последовательность {xk}

числовых отсчетов входного сигнала в последовательность {yk} отсчетов выходного

сигнала по определенному алгоритму:

( x0 , x1 , x2 ...) ( y0 , y1 , y 2 , y3 ...)

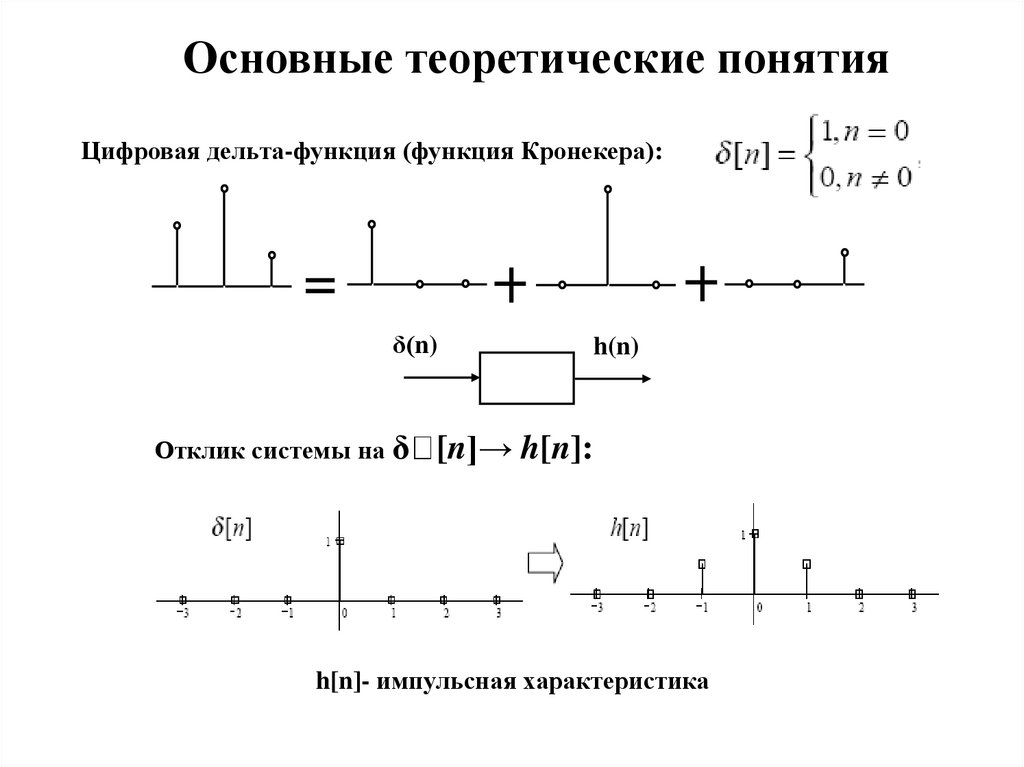

36.

Основные теоретические понятияЦифровая дельта-функция (функция Кронекера):

δ(n)

Отклик системы на δ

h(n)

[n]→ h[n]:

h[n]- импульсная характеристика

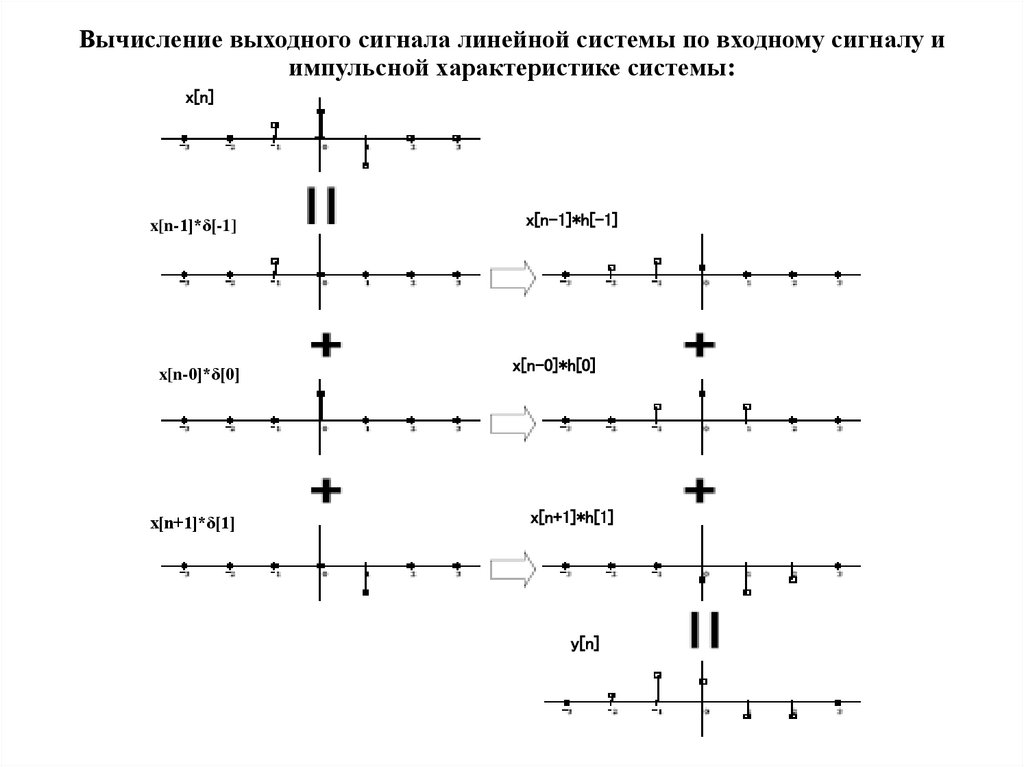

37.

Вычисление выходного сигнала линейной системы по входному сигналу иимпульсной характеристике системы:

x[n]

x[n-1]*δ[-1]

x[n-0]*δ[0]

x[n+1]*δ[1]

x[n-1]*h[-1]

x[n-0]*h[0]

x[n+1]*h[1]

y[n]

38.

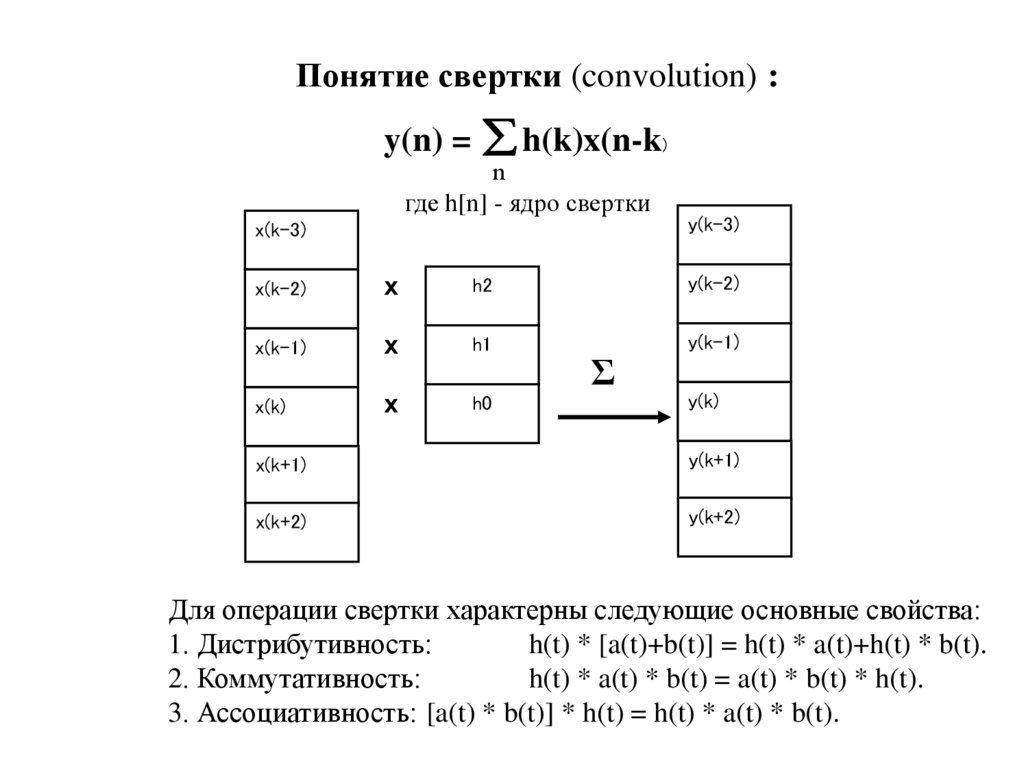

Понятие свертки (convolution) :y(n) = h(k)x(n-k)

n

где h[n] - ядро свертки

x(k-3)

y(k-3)

x(k-2)

x

h2

y(k-2)

x(k-1)

x

h1

y(k-1)

x(k)

x

h0

Σ

y(k)

x(k+1)

y(k+1)

x(k+2)

y(k+2)

Для операции свертки характерны следующие основные свойства:

1. Дистрибутивность:

h(t) * [a(t)+b(t)] = h(t) * a(t)+h(t) * b(t).

2. Коммутативность:

h(t) * a(t) * b(t) = a(t) * b(t) * h(t).

3. Ассоциативность: [a(t) * b(t)] * h(t) = h(t) * a(t) * b(t).

39.

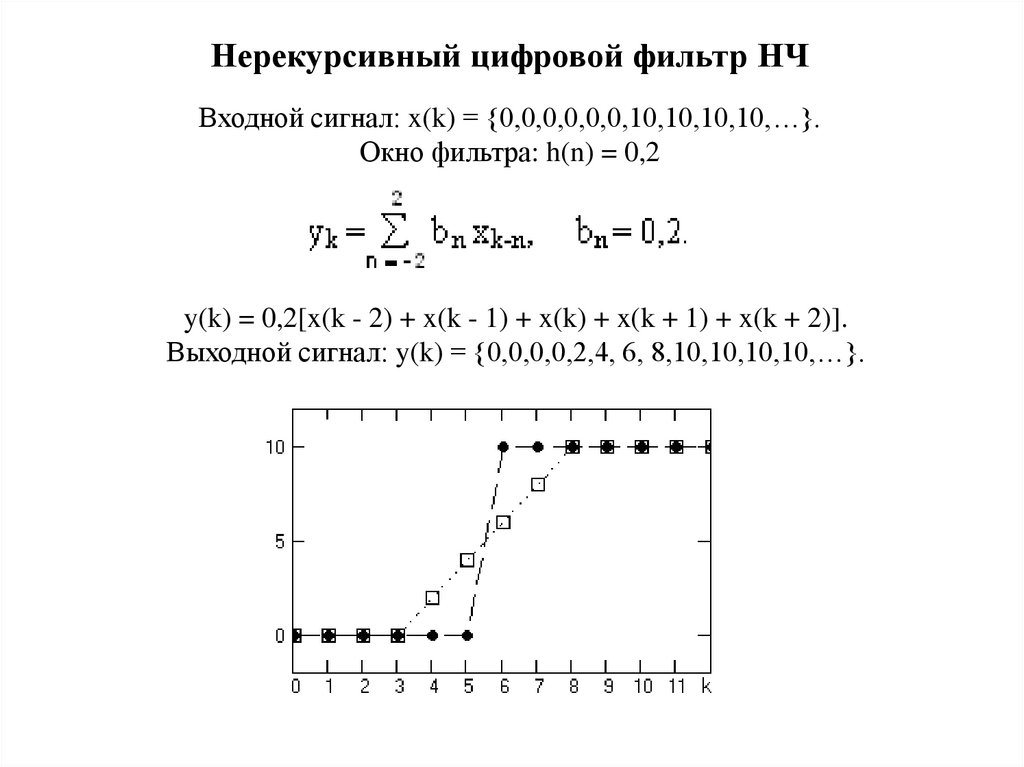

Нерекурсивный цифровой фильтр НЧВходной сигнал: x(k) = {0,0,0,0,0,0,10,10,10,10,…}.

Окно фильтра: h(n) = 0,2

y(k) = 0,2[x(k - 2) + x(k - 1) + x(k) + x(k + 1) + x(k + 2)].

Выходной сигнал: y(k) = {0,0,0,0,2,4, 6, 8,10,10,10,10,…}.

40.

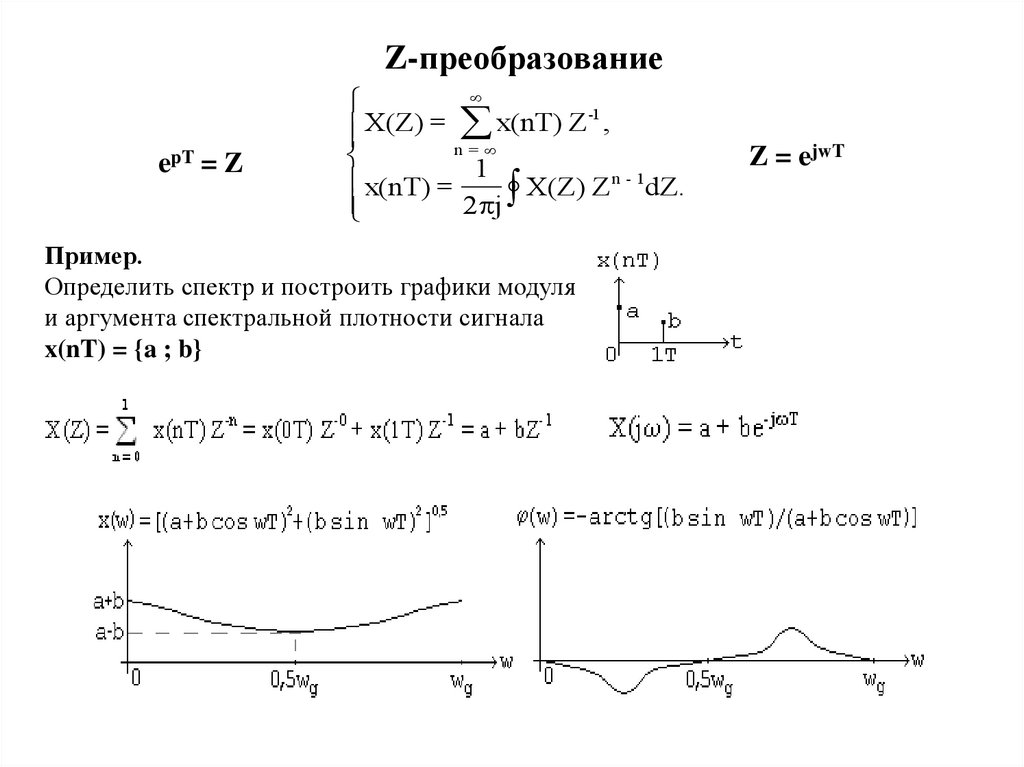

Z-преобразованиеepT = Z

X(Z) = x(nT) Z -1 ,

n=

1

x(nT) =

X(Z) Z n - 1dZ.

2 j

Пример.

Определить спектр и построить графики модуля

и аргумента спектральной плотности сигнала

x(nT) = {a ; b}

Z = ejwT

41.

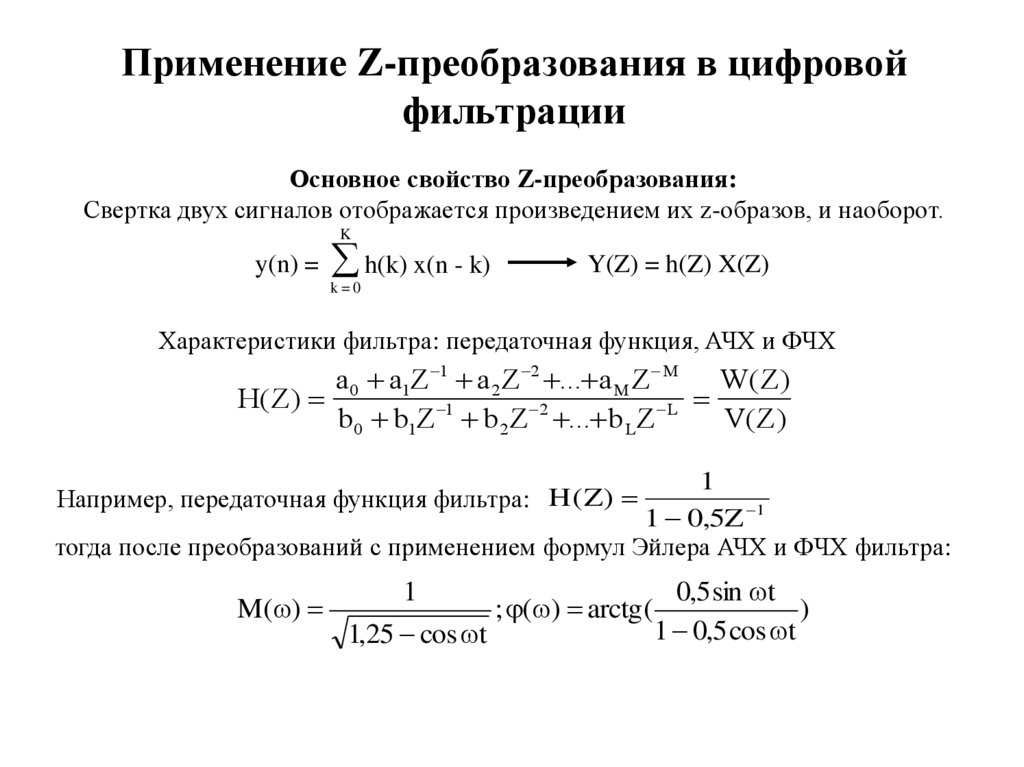

Применение Z-преобразования в цифровойфильтрации

Основное свойство Z-преобразования:

Свертка двух сигналов отображается произведением их z-образов, и наоборот.

K

y(n) = h(k) x(n - k)

Y(Z) = h(Z) X(Z)

k=0

Характеристики фильтра: передаточная функция, АЧХ и ФЧХ

a 0 a1Z 1 a 2 Z 2 ... a M Z M W( Z)

H( Z)

1

2

L

b 0 b1Z b 2 Z ... b L Z

V( Z)

1

1 0,5Z 1

тогда после преобразований с применением формул Эйлера АЧХ и ФЧХ фильтра:

Например, передаточная функция фильтра: H ( Z)

M( )

1

1,25 cos t

; ( ) arctg (

0,5 sin t

)

1 0,5 cos t

42.

43.

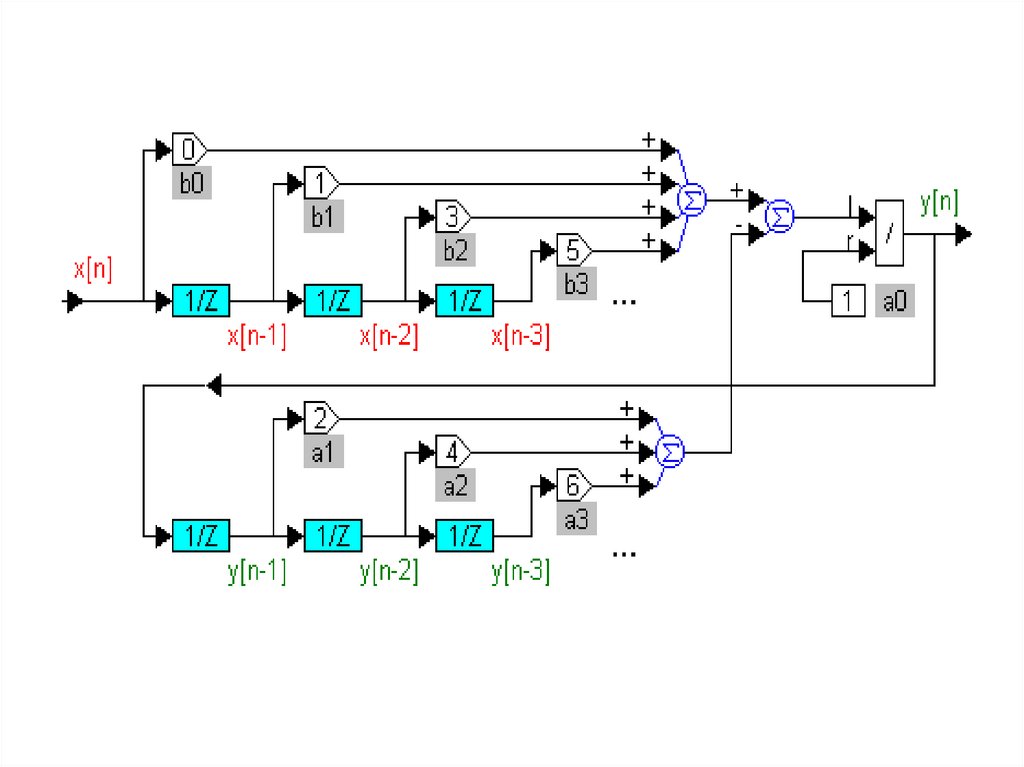

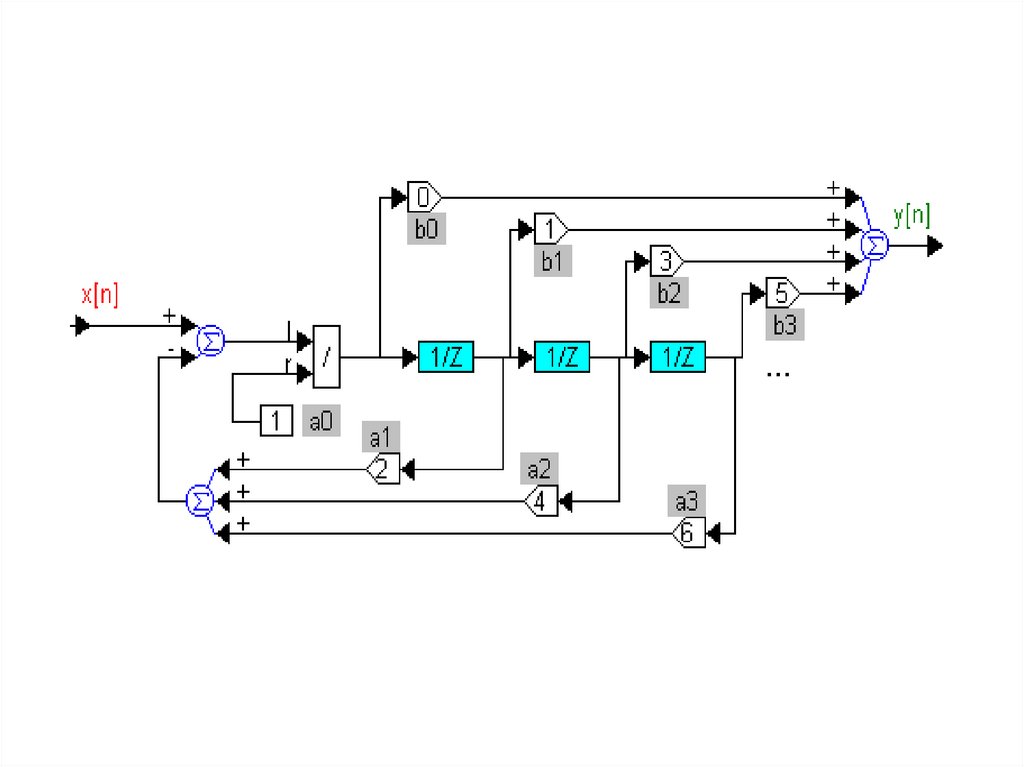

Структурные схемы цифровых фильтровy(t)

x(t)

W(p)

Т

а)

Физический смысл умножения на Z в цифровой фильтрации означает

сдвиг на один интервал дискретизации:

xn

Z-1

xn-1

N

Для цифровой фильтрации: y(n) =

bk x(n-k),

k 0

Интервал (0-K) оператора получил название "окна" фильтра

44.

Алгоритмы получения дискретной передаточной функцииАлгоритм 1.

— стандартная форма для дискретных

передаточных функций.

Алгоритм 2. — разложение передаточных функций на множители

Алгоритм 3. — разложение

передаточных функций на элементарные дроби вида

45.

46.

47.

48.

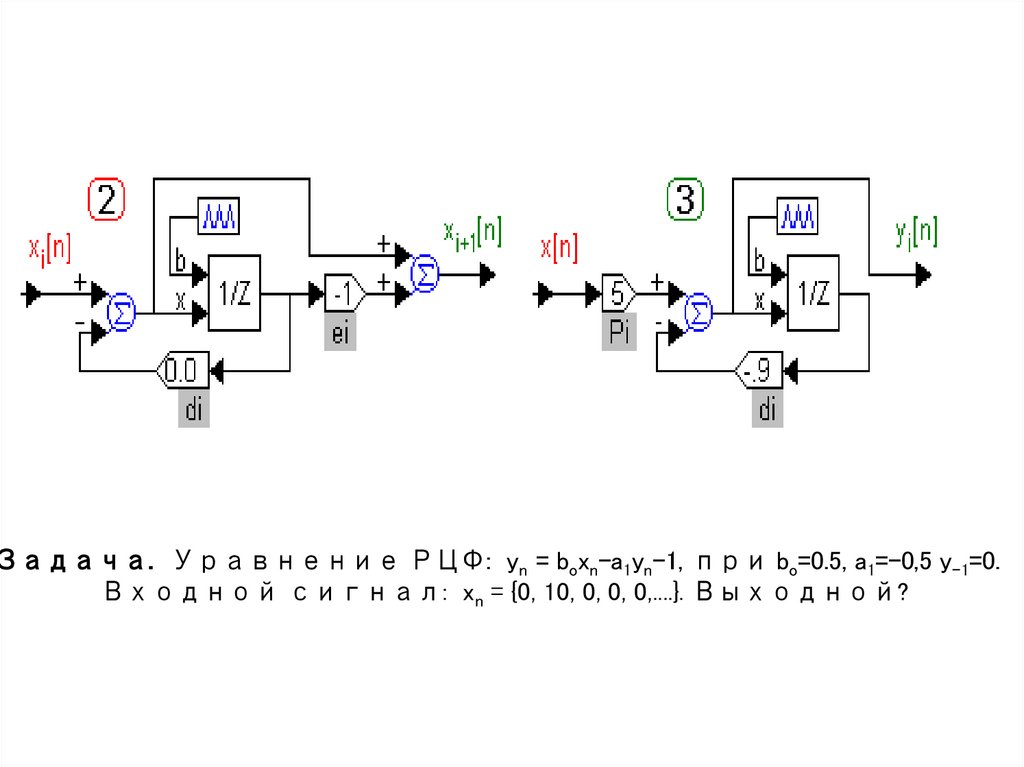

Задача. Уравнение РЦФ: yn = boxn-a1yn-1, при bo=0.5, a1=-0,5 y-1=0.Входной сигнал: xn = {0, 10, 0, 0, 0,....}. Выходной?

49.

Нерекурсивный цифровой фильтр НЧВходной сигнал: x(k) = {0,0,0,0,0,0,10,10,10,10,…}.

y(k) = 0,2[x(k - 2) + x(k - 1) + x(k) + x(k + 1) + x(k + 2)].

Выходной сигнал: y(k) = {0,0,0,0,2,4, 6, 8,10,10,10,10,…}.

Передаточная функция фильтра в первой форме?

50.

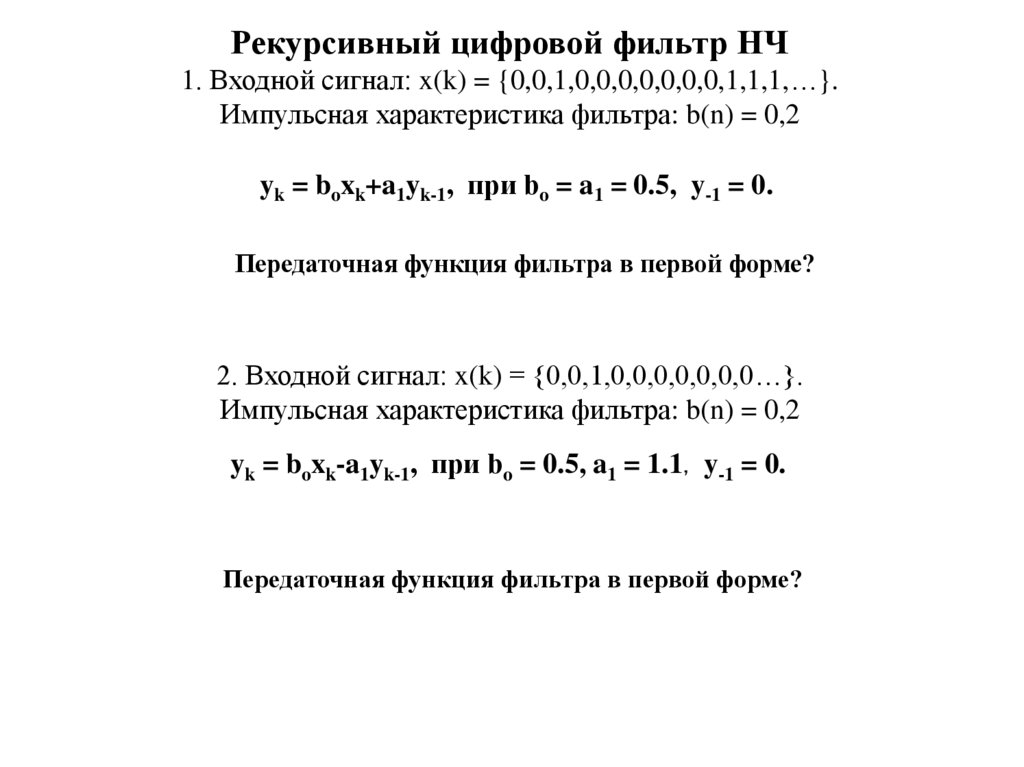

Рекурсивный цифровой фильтр НЧ1. Входной сигнал: x(k) = {0,0,1,0,0,0,0,0,0,0,1,1,1,…}.

Импульсная характеристика фильтра: b(n) = 0,2

yk = boxk+a1yk-1, при bo = a1 = 0.5, y-1 = 0.

Передаточная функция фильтра в первой форме?

2. Входной сигнал: x(k) = {0,0,1,0,0,0,0,0,0,0…}.

Импульсная характеристика фильтра: b(n) = 0,2

yk = boxk-a1yk-1, при bo = 0.5, a1 = 1.1, y-1 = 0.

Передаточная функция фильтра в первой форме?

51.

ОБРАБОТКА ИЗОБРАЖЕНИЙИзображение - функция двух вещественных переменных I(x,y),

где I –интенсивность (яркость) в точке с координатами (x,y).

Цели обработки: Image Processing –улучшение качества изображения

Image Analysis – проведение измерений на изображении

Image Understanding – распознавание образов

Задачи обработки: Дискретизация, квантование и кодирование изображений

Геометрические преобразования изображений

Фильтрация изображений

Препарирование изображений

52.

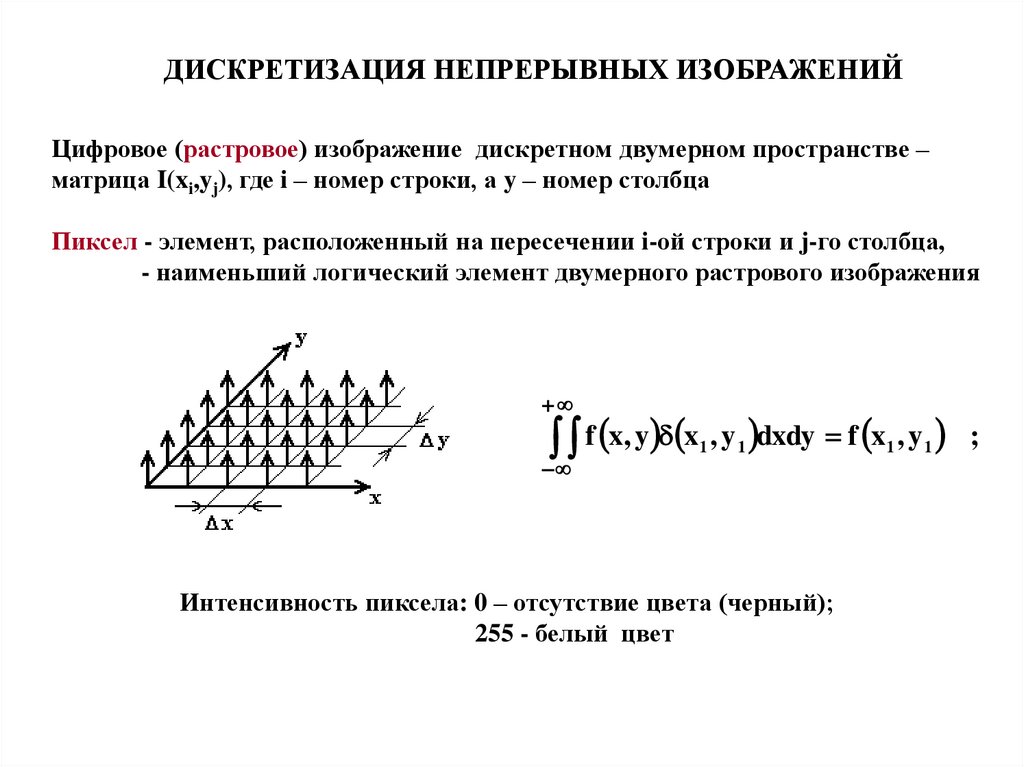

ДИСКРЕТИЗАЦИЯ НЕПРЕРЫВНЫХ ИЗОБРАЖЕНИЙЦифровое (растровое) изображение дискретном двумерном пространстве –

матрица I(xi,yj), где i – номер строки, а y – номер столбца

Пиксел - элемент, расположенный на пересечении i-ой строки и j-го столбца,

- наименьший логический элемент двумерного растрового изображения

f x, y x , y dxdy f x , y ;

1

1

Интенсивность пиксела: 0 – отсутствие цвета (черный);

255 - белый цвет

1

1

53.

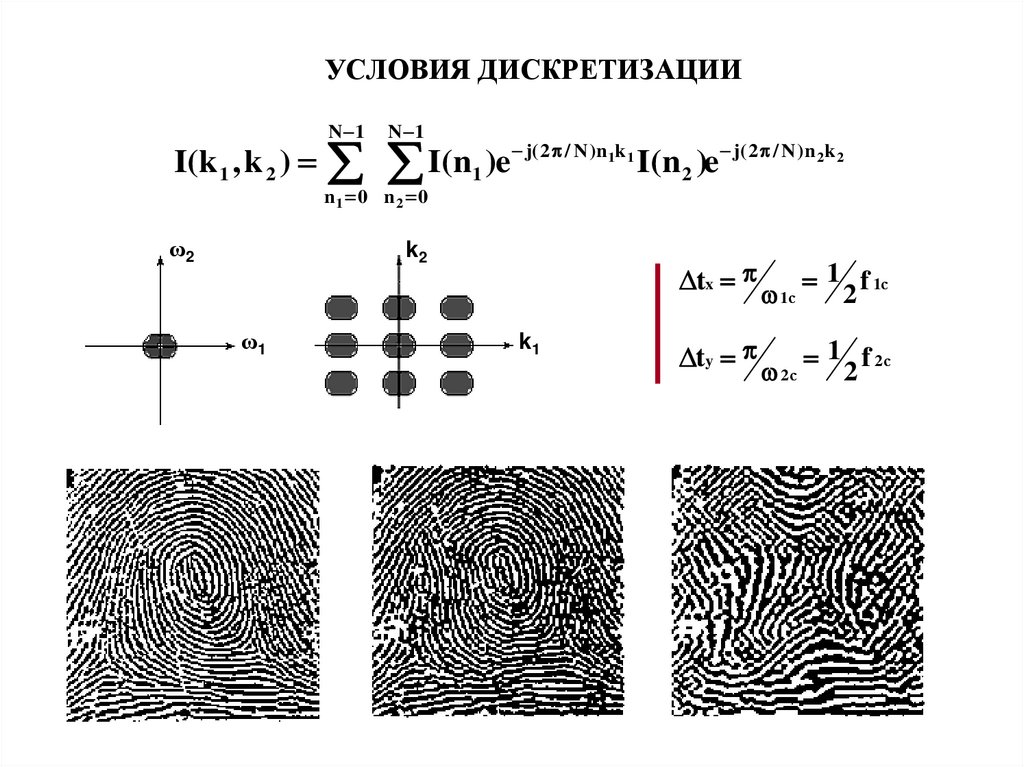

УСЛОВИЯ ДИСКРЕТИЗАЦИИN 1

I (k 1 , k 2 )

N 1

j( 2 / N ) n1k 1

j( 2 / N ) n 2k 2

I

(

n

)

e

I

(

n

)

e

1

2

n1 0 n 2 0

ω2

k2

ω1

tx

k1

ty

1 f 1с

1с

2

2 с

1 f 2с

2

54.

КВАНТОВАНИЕ ИЗОБРАЕНИЙУровни квантования:

увеличение– сложность обработки,

уменьшение - ложные контуры

x

y

Нелинейное

преобразование

y

Равномерное

квантование

y

y

x

Обратное

преобразование

x

x

y

y

55.

1. Поэлементное преобразование изображенийСущность метода: значение яркости x каждого элемента изображения

пересчитывается в новое значение y в соответствии с заданной

функциональной зависимостью y = T(x).

1.1. Линейное контрастирование изображения

Пусть

xmin - минимальная, а

xmax - максимальная яркости

исходного изображения в

диапазоне 0...255 бит,

тогда изображение

при xmin = 180 и xmax = 240:

56.

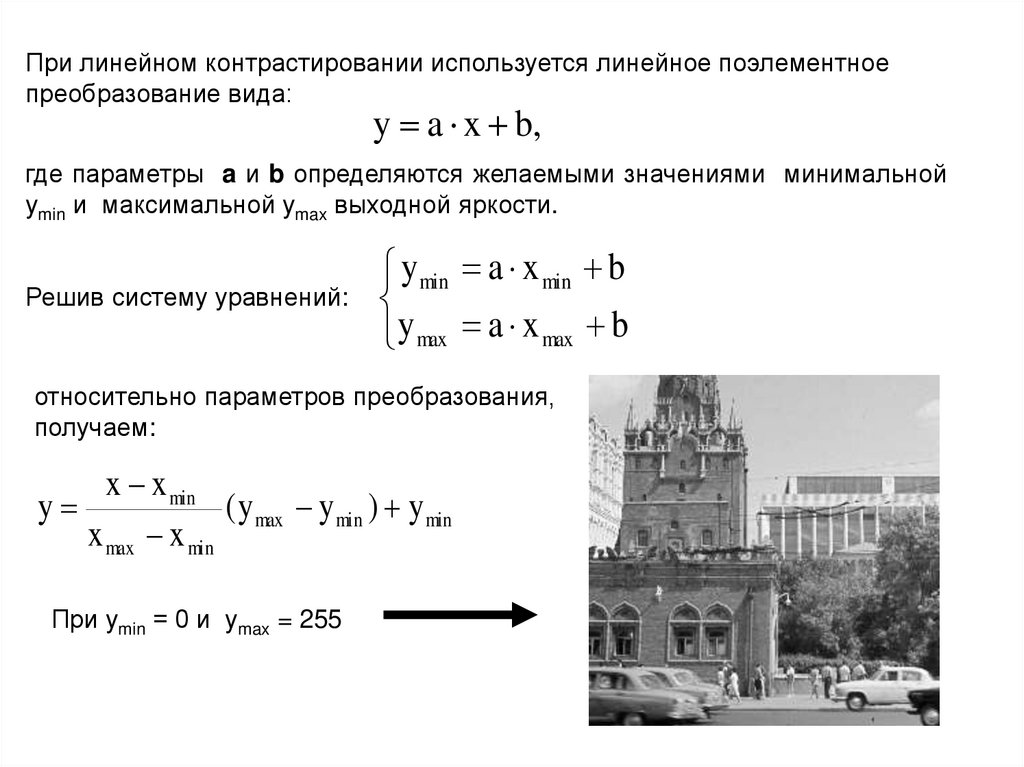

При линейном контрастировании используется линейное поэлементноепреобразование вида:

y a x b,

где параметры a и b определяются желаемыми значениями минимальной

ymin и максимальной ymax выходной яркости.

Решив систему уравнений:

y min a x min b

y max a x max b

относительно параметров преобразования,

получаем:

y

x x min

( y max y min ) y min

x max x min

При ymin = 0 и ymax = 255

57.

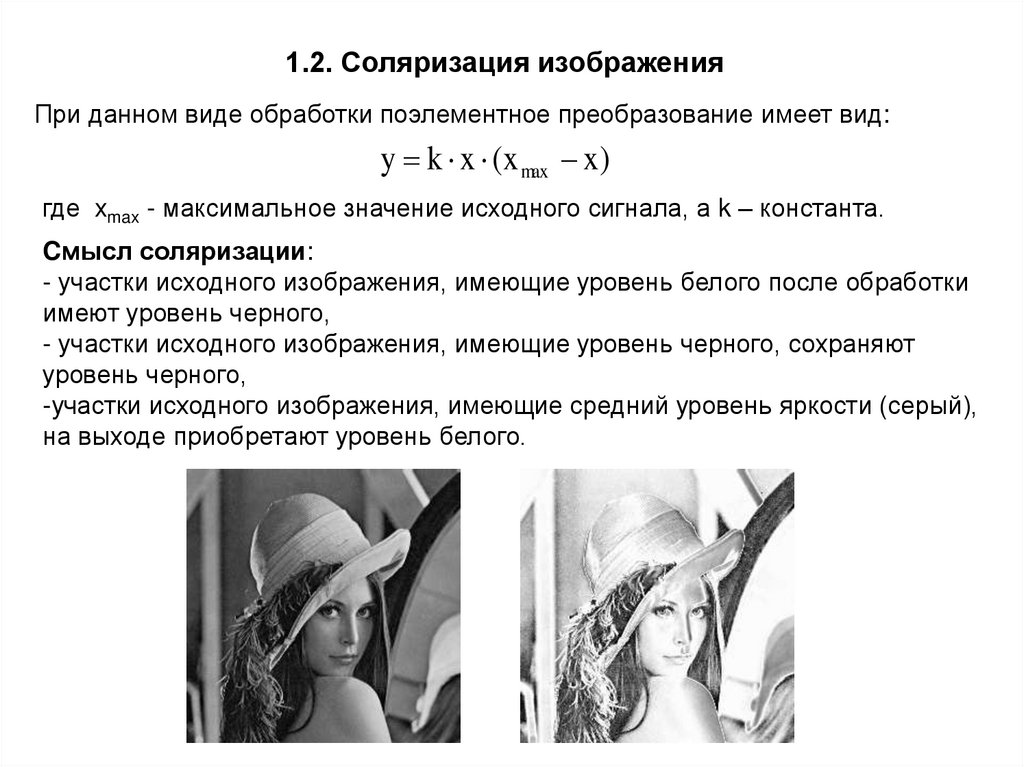

1.2. Соляризация изображенияПри данном виде обработки поэлементное преобразование имеет вид:

y k x (x max x)

где xmax - максимальное значение исходного сигнала, а k – константа.

Cмысл соляризации:

- участки исходного изображения, имеющие уровень белого после обработки

имеют уровень черного,

- участки исходного изображения, имеющие уровень черного, сохраняют

уровень черного,

-участки исходного изображения, имеющие средний уровень яркости (серый),

на выходе приобретают уровень белого.

58.

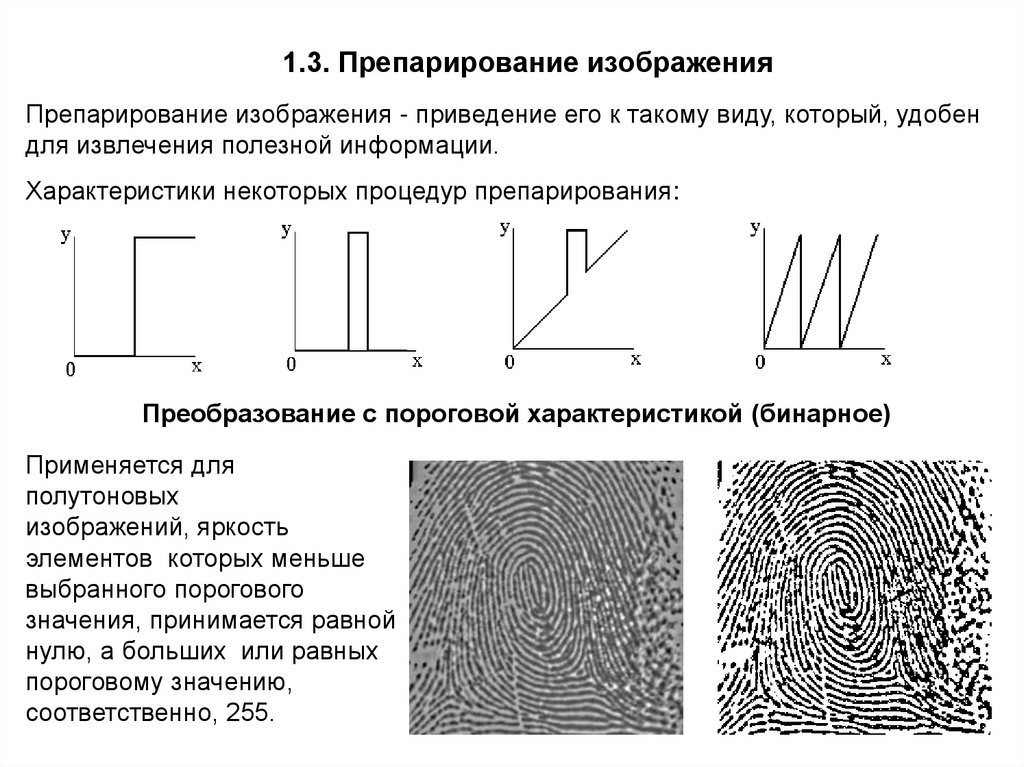

1.3. Препарирование изображенияПрепарирование изображения - приведение его к такому виду, который, удобен

для извлечения полезной информации.

Характеристики некоторых процедур препарирования:

Преобразование с пороговой характеристикой (бинарное)

Применяется для

полутоновых

изображений, яркость

элементов которых меньше

выбранного порогового

значения, принимается равной

нулю, а больших или равных

пороговому значению,

соответственно, 255.

59.

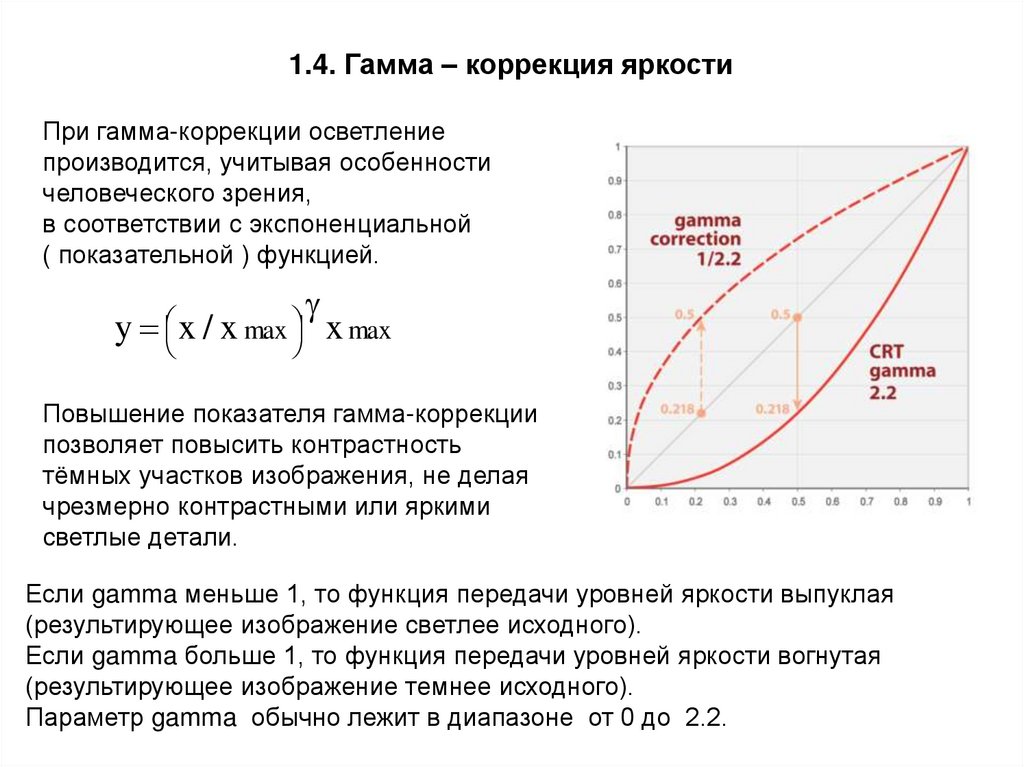

1.4. Гамма – коррекция яркостиПри гамма-коррекции осветление

производится, учитывая особенности

человеческого зрения,

в соответствии с экспоненциальной

( показательной ) функцией.

y x / x max

x max

Повышение показателя гамма-коррекции

позволяет повысить контрастность

тёмных участков изображения, не делая

чрезмерно контрастными или яркими

светлые детали.

Если gamma меньше 1, то функция передачи уровней яркости выпуклая

(результирующее изображение светлее исходного).

Если gamma больше 1, то функция передачи уровней яркости вогнутая

(результирующее изображение темнее исходного).

Параметр gamma обычно лежит в диапазоне от 0 до 2.2.

60.

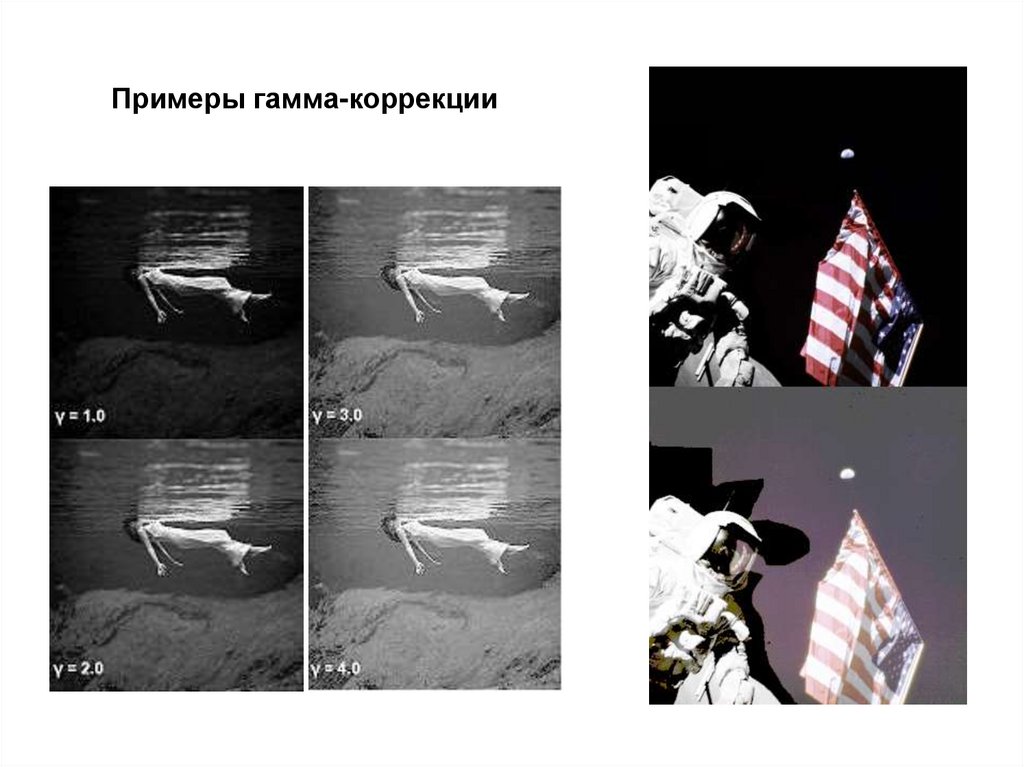

Примеры гамма-коррекции61.

2. Гистограммные методы обработкиизображений

Построение исходной гистограммы:

- весь диапазон яркостей изображения разделяется на поддиапазоны,

- подсчитываются частоты повторения значений яркости в каждом

поддиапазоне,

- строится столбчатая диаграмма в координатах “диапазон яркостей частота”.

2.1. Линейная растяжка гистограммы

Пусть изображение является малоконтрастным, превалирует темный оттенок.

При линейной растяжке уровням исходного изображения, лежащим в

интервале [fмин, fмакс], присваиваются новые значения с тем, чтобы

охватить весь возможный

интервал изменения яркости. Преобразование уровней яркости

осуществляется по формуле:

gi = a + bfi,

где fi - старое значение яркости i-го пиксела, gi - новое значение,

a, b - коэффициенты.

62.

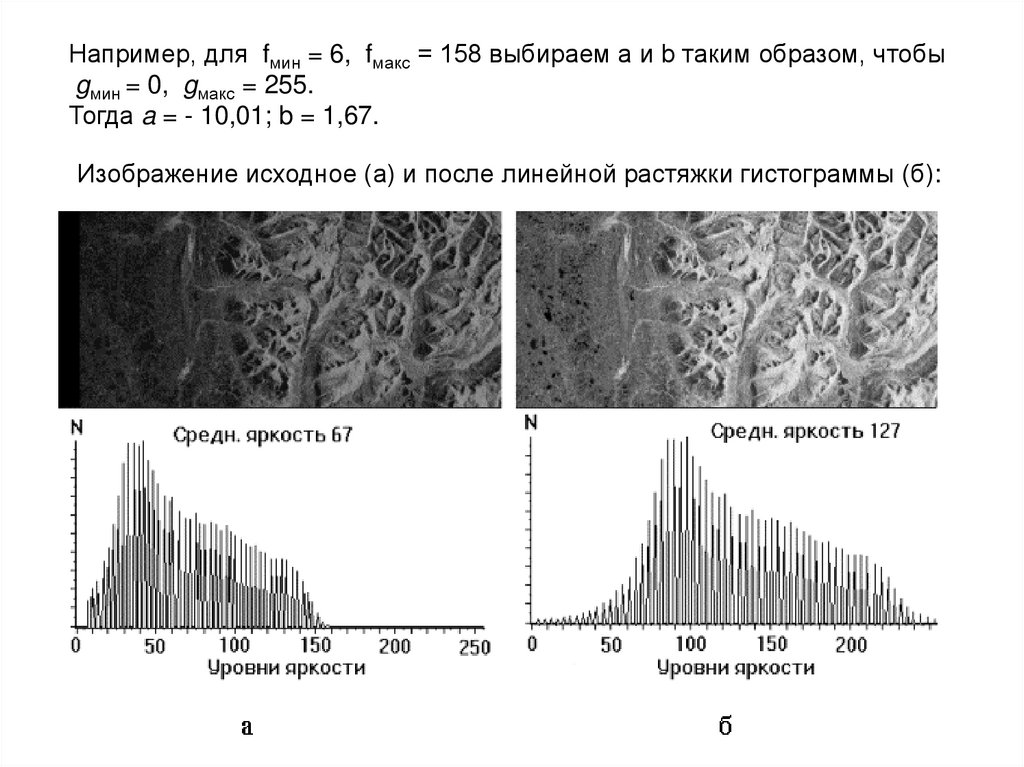

Например, для fмин = 6, fмакс = 158 выбираем a и b таким образом, чтобыgмин = 0, gмакс = 255.

Тогда a = - 10,01; b = 1,67.

Изображение исходное (а) и после линейной растяжки гистограммы (б):

63.

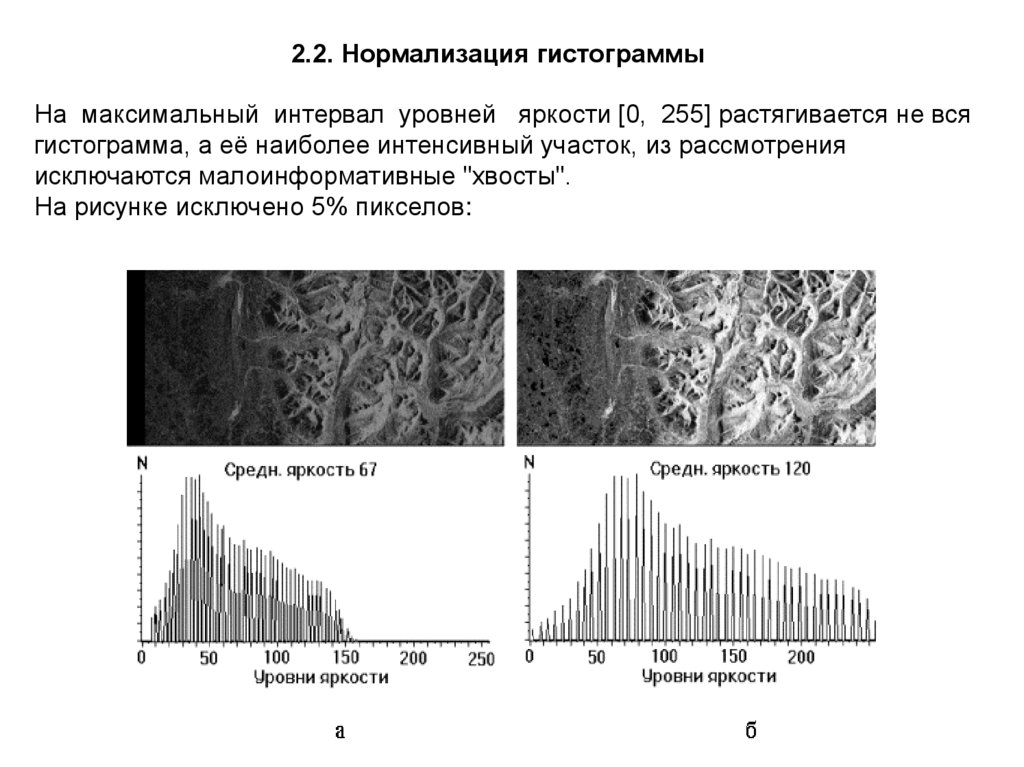

2.2. Нормализация гистограммыНа максимальный интервал уровней яркости [0, 255] растягивается не вся

гистограмма, а её наиболее интенсивный участок, из рассмотрения

исключаются малоинформативные "хвосты".

На рисунке исключено 5% пикселов:

64.

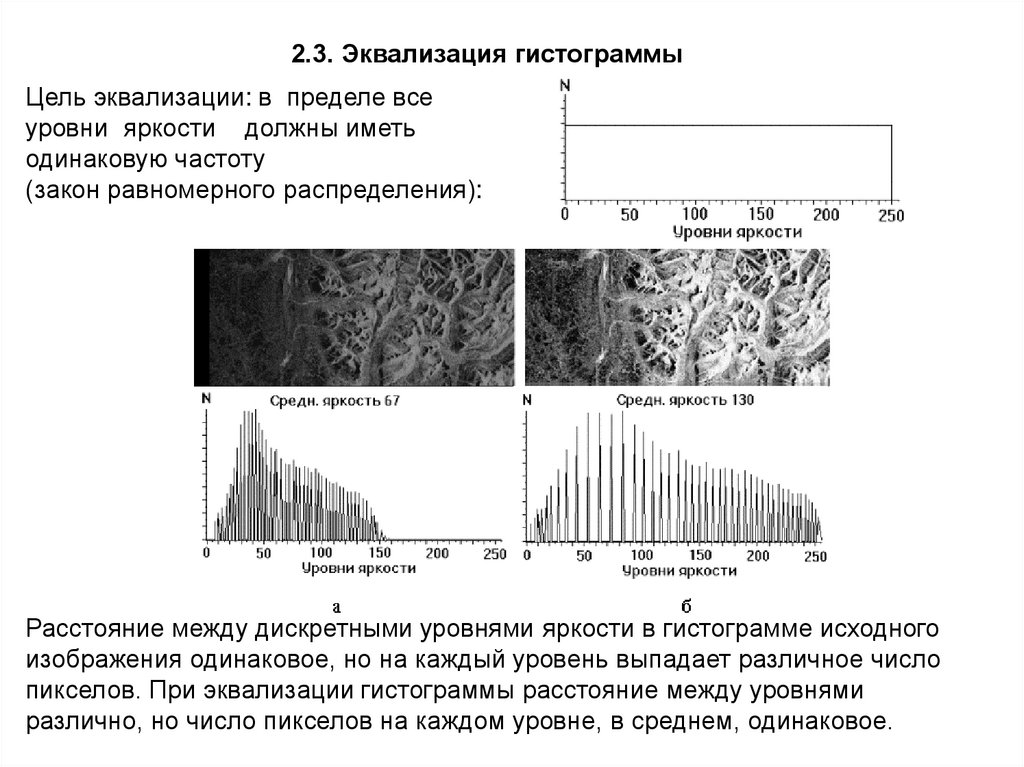

2.3. Эквализация гистограммыЦель эквализации: в пределе все

уровни яркости должны иметь

одинаковую частоту

(закон равномерного распределения):

Расстояние между дискретными уровнями яркости в гистограмме исходного

изображения одинаковое, но на каждый уровень выпадает различное число

пикселов. При эквализации гистограммы расстояние между уровнями

различно, но число пикселов на каждом уровне, в среднем, одинаковое.

65.

Гомоморфная обработка изображенийПринцип суперпозиции

для линейных систем:

H [s1 (t ) s2 (t )] H [ s1 (t )] H [ s2 (t )],

H [c s1 (t )] c H [ s1 (t )].

где H – преобразование, осуществляемое системой;

S1(t), S2(t) – преобразуемые сигналы;

С – постоянный множитель

Преобразование однозначно и обратимо.

Обработка изоморфная.

.

Обобщенный принцип

суперпозиции:

Преобразование однозначно и необратимо.

Обработка гомоморфная.

Например, операция квадрирования

H [s(t )] [ s(t )]2

66.

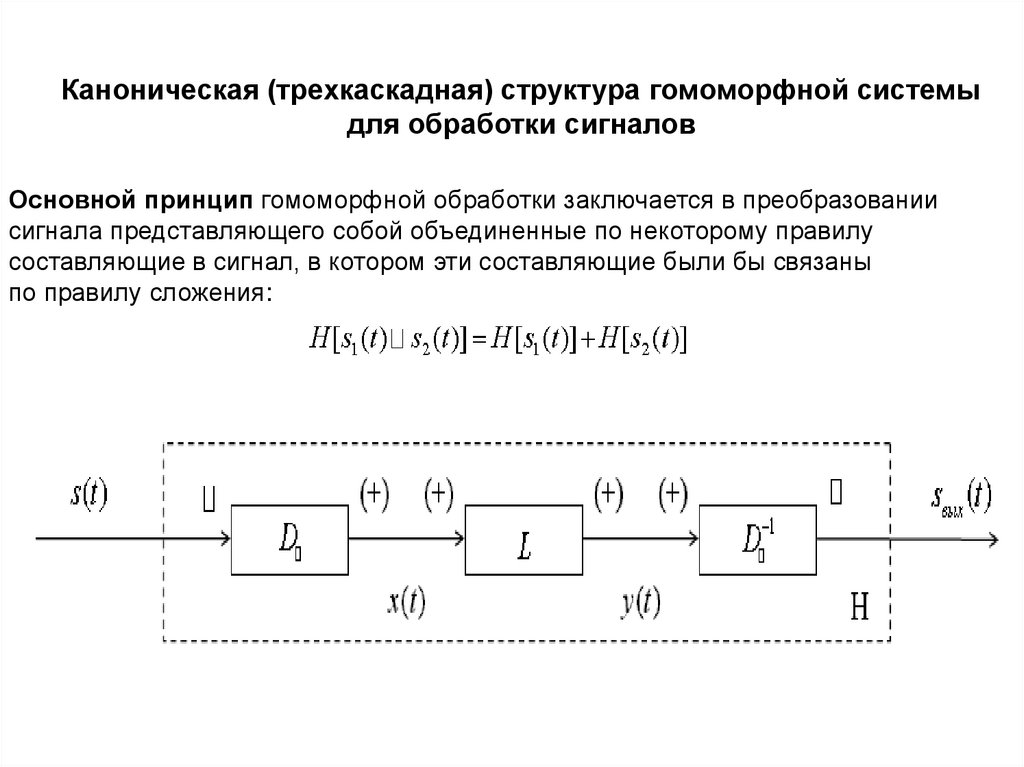

Каноническая (трехкаскадная) структура гомоморфной системыдля обработки сигналов

Основной принцип гомоморфной обработки заключается в преобразовании

сигнала представляющего собой объединенные по некоторому правилу

составляющие в сигнал, в котором эти составляющие были бы связаны

по правилу сложения:

67.

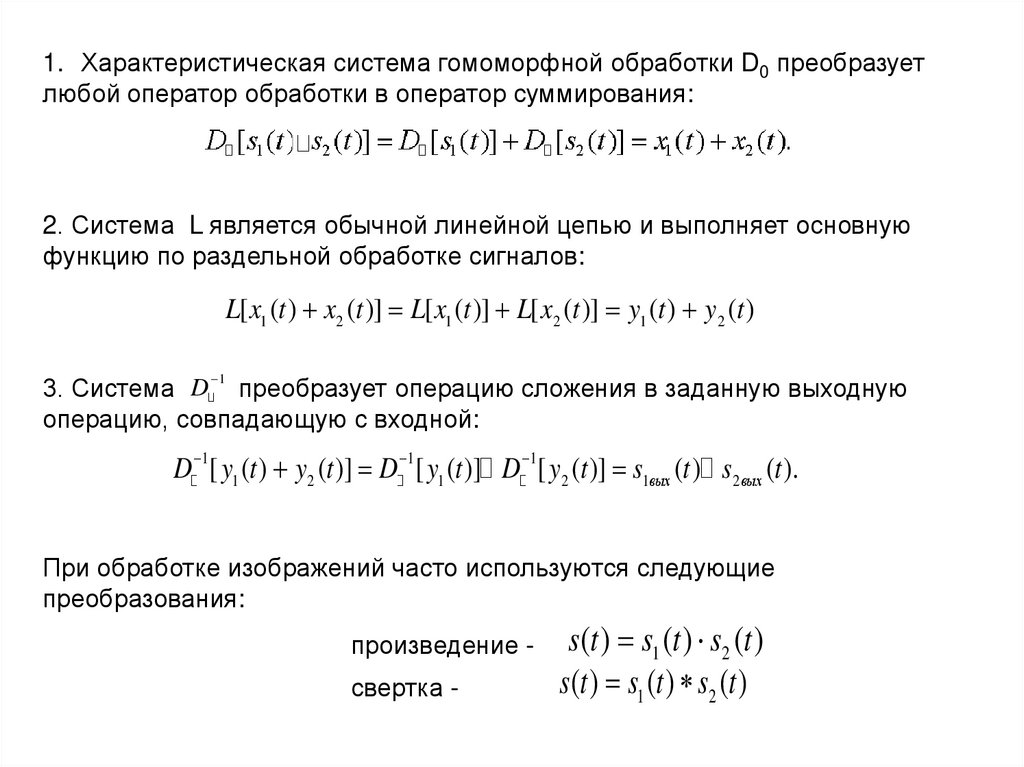

1. Характеристическая система гомоморфной обработки D0 преобразуетлюбой оператор обработки в оператор суммирования:

2. Система L является обычной линейной цепью и выполняет основную

функцию по раздельной обработке сигналов:

L[ x1 (t ) x2 (t )] L[ x1 (t )] L[ x2 (t )] y1 (t ) y2 (t )

1

3. Система D преобразует операцию сложения в заданную выходную

операцию, совпадающую с входной:

D 1 [ y1 (t ) y2 (t )] D 1[ y1 (t )] D 1[ y2 (t )] s1вых (t ) s2 вых (t ).

При обработке изображений часто используются следующие

преобразования:

произведение свертка -

s (t ) s1 (t ) s2 (t )

s(t ) s1 (t ) s2 (t )

68.

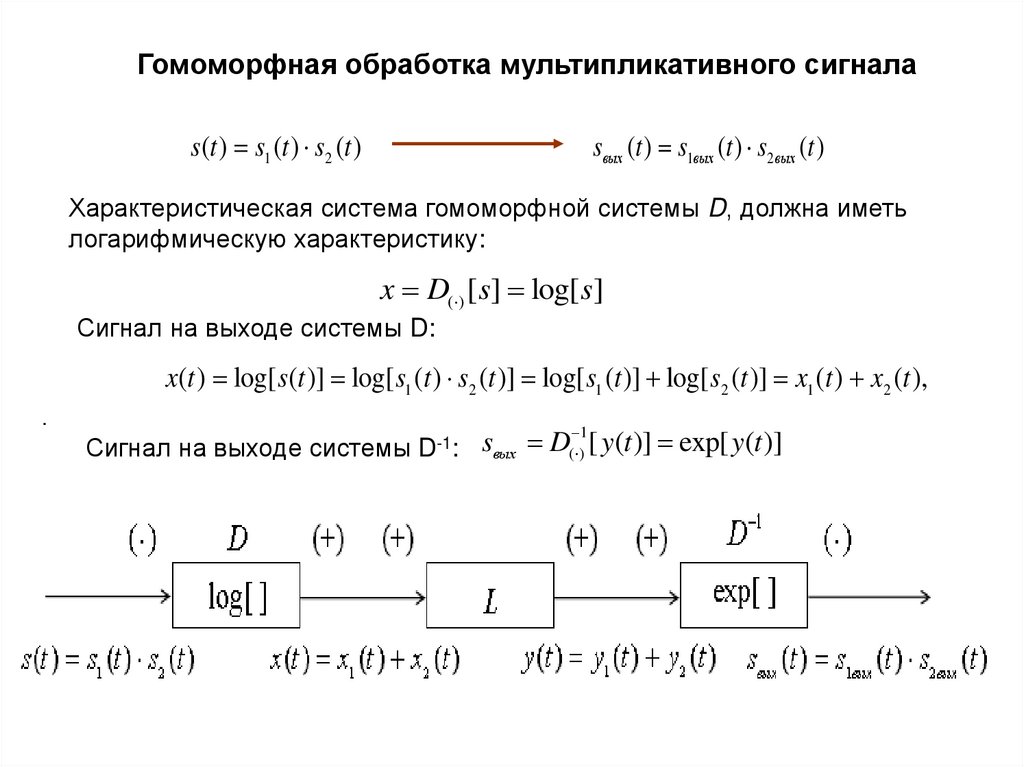

Гомоморфная обработка мультипликативного сигналаs (t ) s1 (t ) s2 (t )

sвых (t ) s1вых (t ) s2 вых (t )

Характеристическая система гомоморфной системы D, должна иметь

логарифмическую характеристику:

x D( ) [s] log[s]

Сигнал на выходе системы D:

x(t ) log[ s(t )] log[ s1 (t ) s2 (t )] log[ s1 (t )] log[ s2 (t )] x1 (t ) x2 (t ),

.

Сигнал на выходе системы D-1:

sвых D( )1[ y(t )] exp[ y(t )]

69.

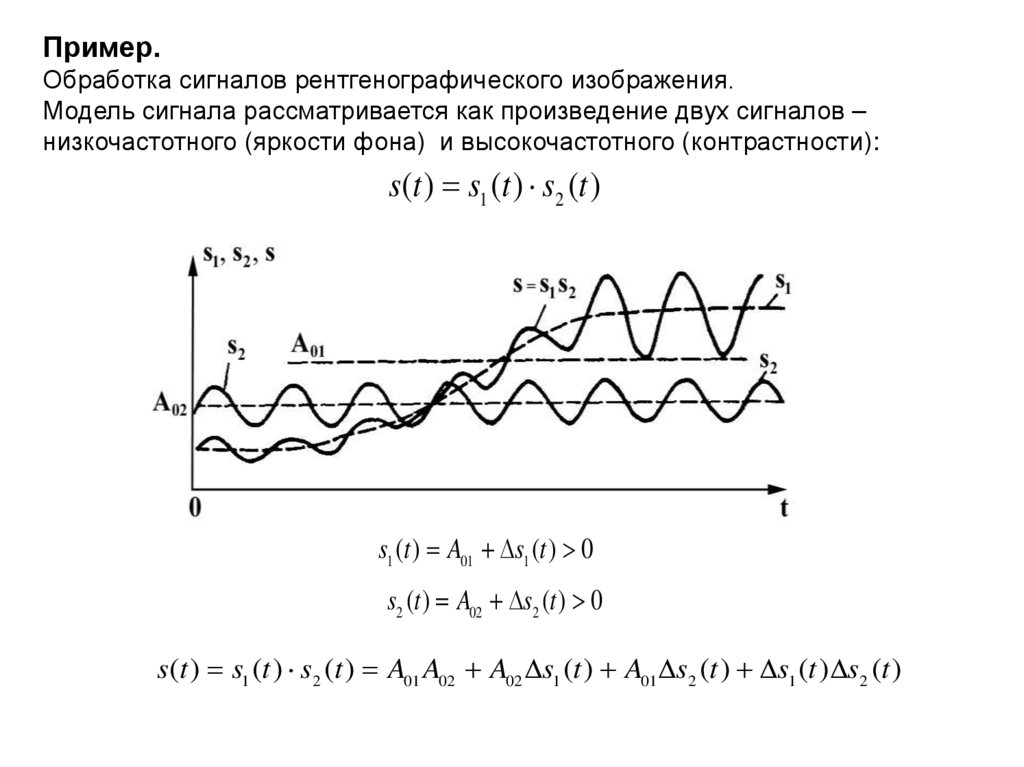

Пример.Обработка сигналов рентгенографического изображения.

Модель сигнала рассматривается как произведение двух сигналов –

низкочастотного (яркости фона) и высокочастотного (контрастности):

s (t ) s1 (t ) s2 (t )

s1 (t ) A01 s1 (t ) 0

s2 (t ) A02 s2 (t ) 0

s (t ) s1 (t ) s2 (t ) A01 A02 A02 s1 (t ) A01 s2 (t ) s1 (t ) s2 (t )

70.

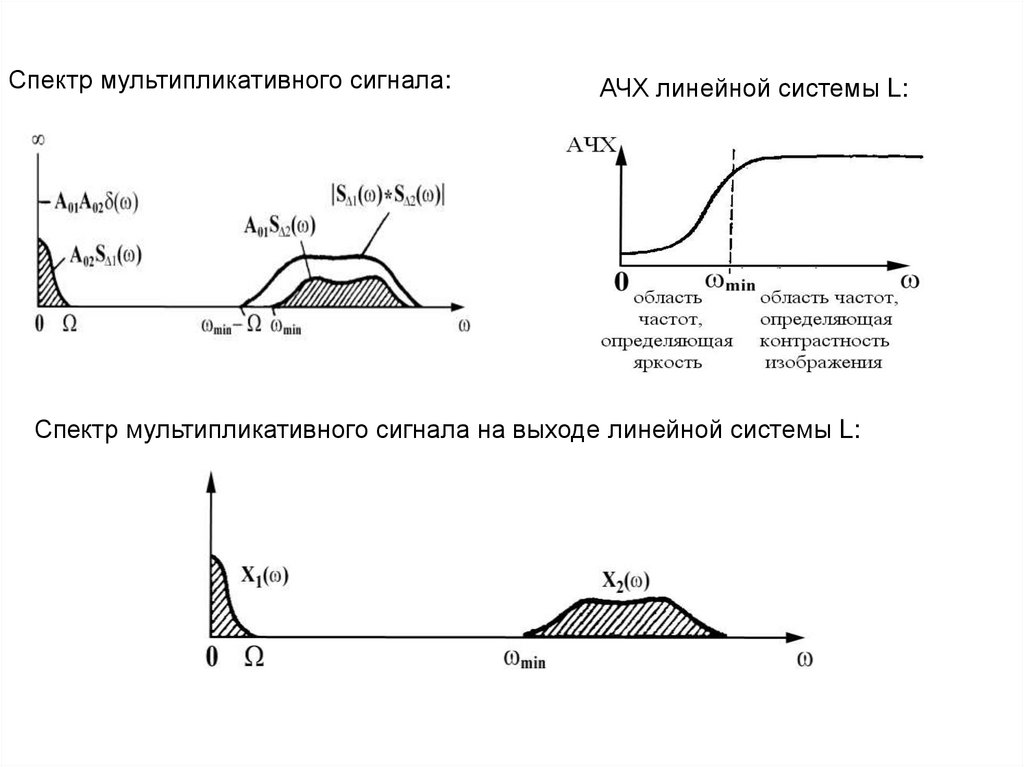

Спектр мультипликативного сигнала:АЧХ линейной системы L:

Спектр мультипликативного сигнала на выходе линейной системы L:

71.

Рентгеновское изображение до и после гомоморфной фильтрации:72.

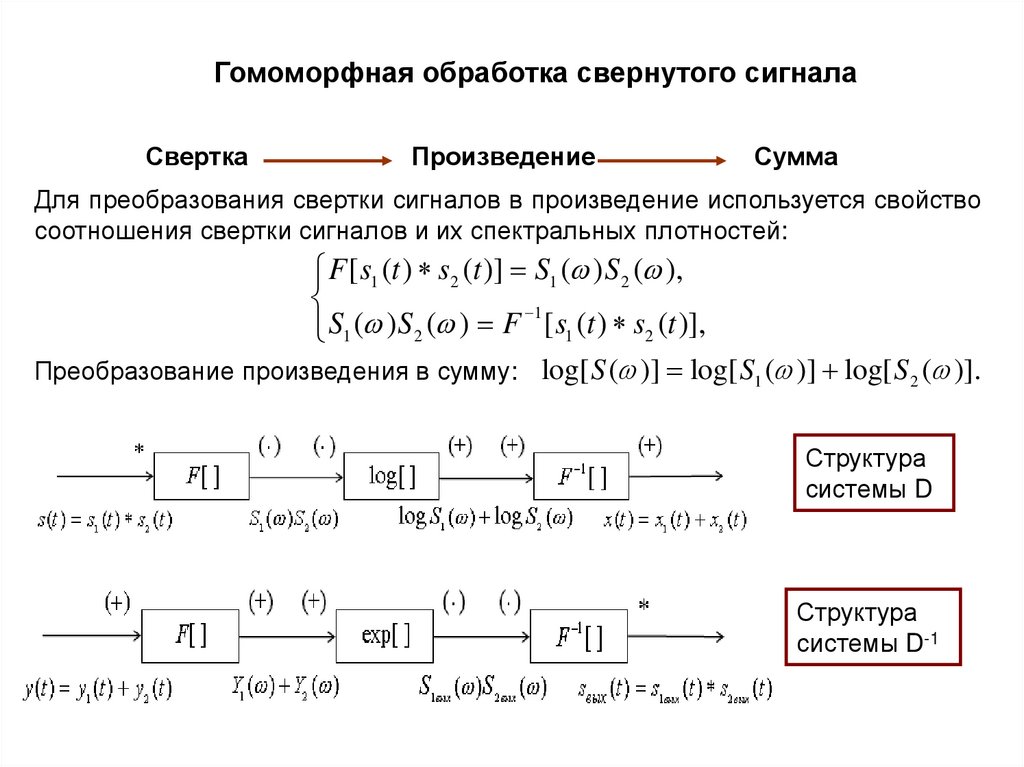

Гомоморфная обработка свернутого сигналаСвертка

Произведение

Сумма

Для преобразования свертки сигналов в произведение используется свойство

соотношения свертки сигналов и их спектральных плотностей:

F [ s1 (t ) s2 (t )] S1 ( ) S 2 ( ),

1

S1 ( ) S 2 ( ) F [ s1 (t ) s2 (t )],

Преобразование произведения в сумму: log[ S ( )] log[ S1 ( )] log[ S 2 ( )].

Структура

системы D

Структура

системы D-1

73.

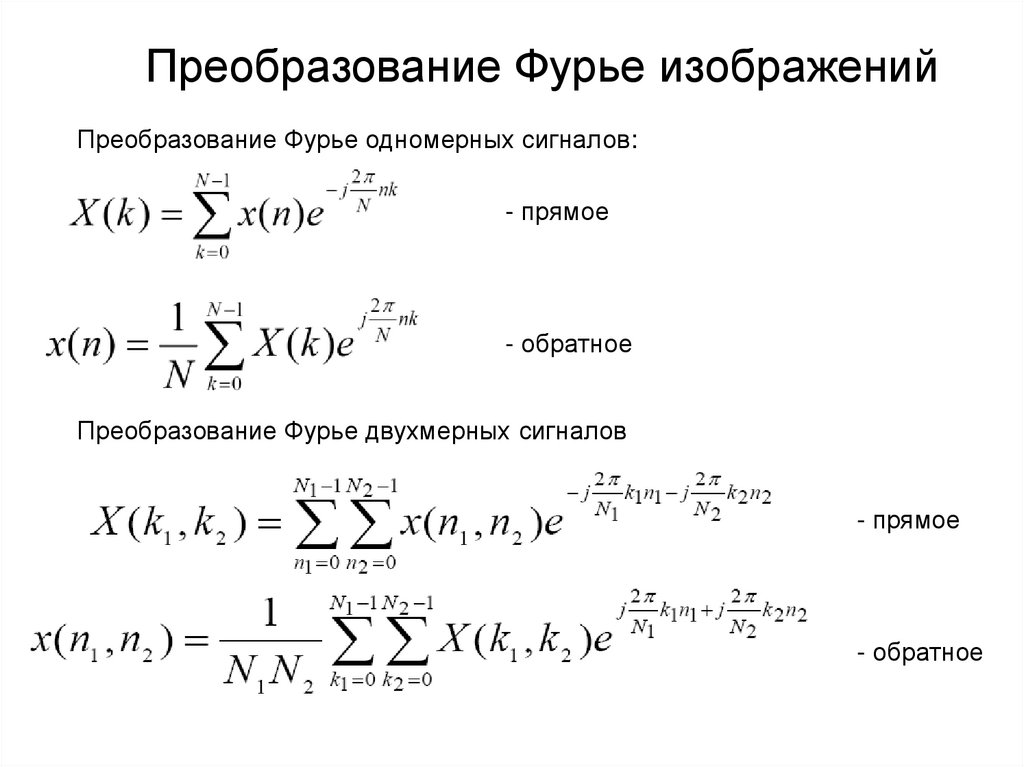

Преобразование Фурье изображенийПреобразование Фурье одномерных сигналов:

- прямое

- обратное

Преобразование Фурье двухмерных сигналов

- прямое

- обратное

74.

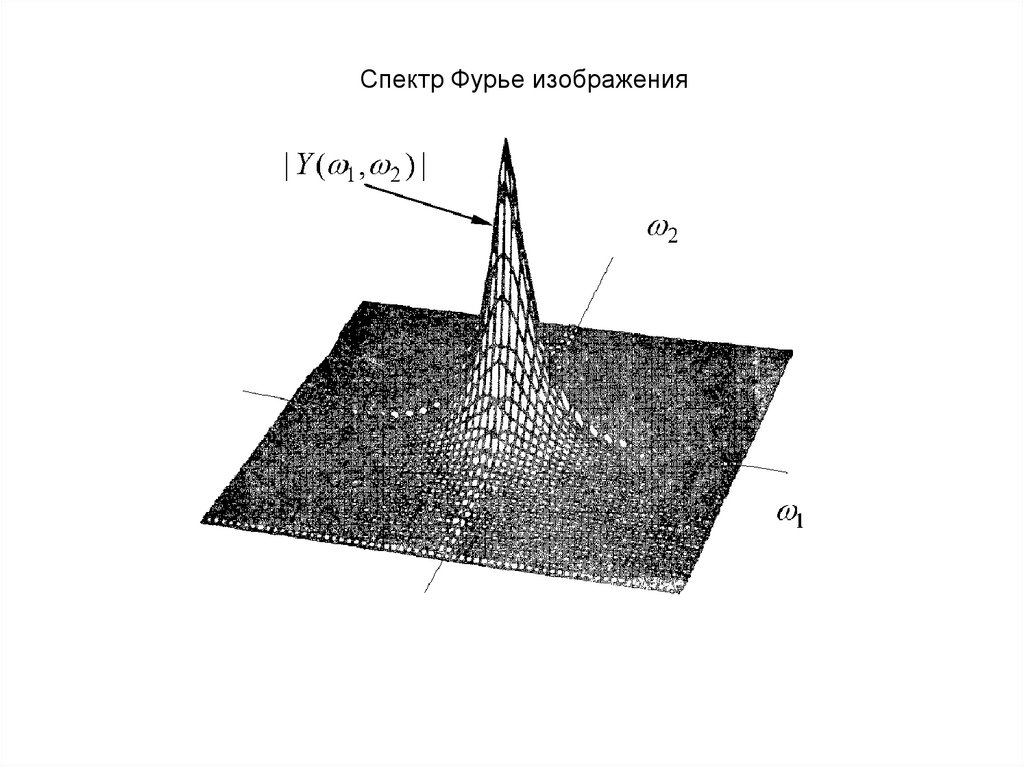

Спектр Фурье изображения75.

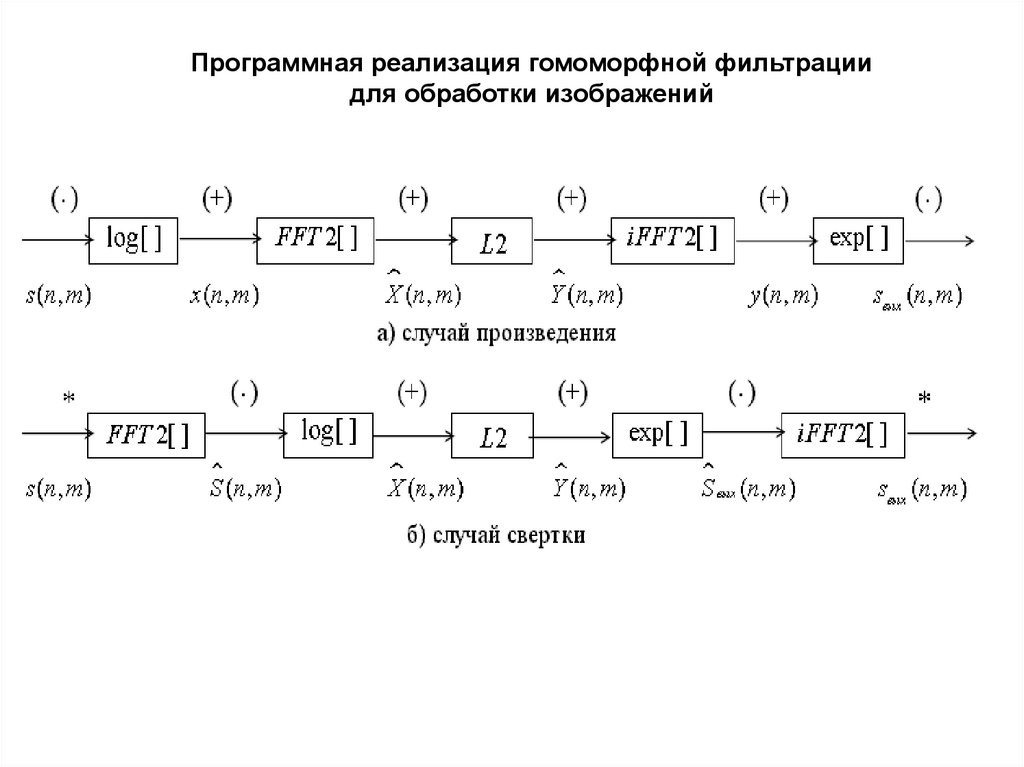

Программная реализация гомоморфной фильтрациидля обработки изображений

76.

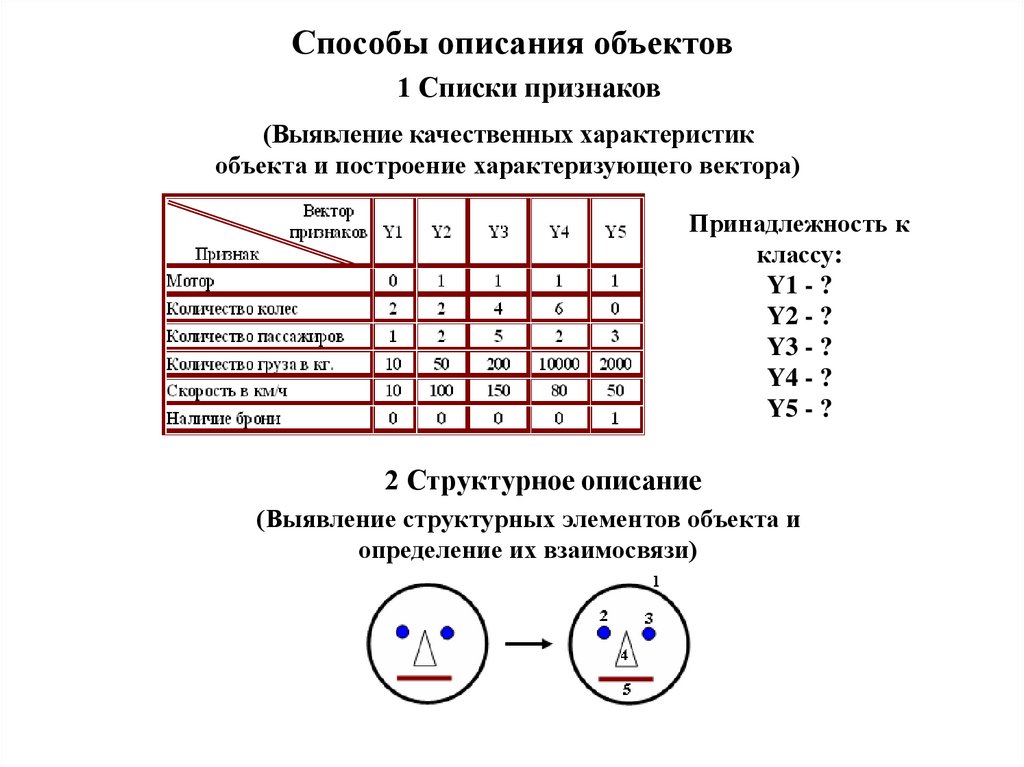

Способы описания объектов1 Списки признаков

(Выявление качественных характеристик

объекта и построение характеризующего вектора)

Принадлежность к

классу:

Y1 - ?

Y2 - ?

Y3 - ?

Y4 - ?

Y5 - ?

2 Структурное описание

(Выявление структурных элементов объекта и

определение их взаимосвязи)

77.

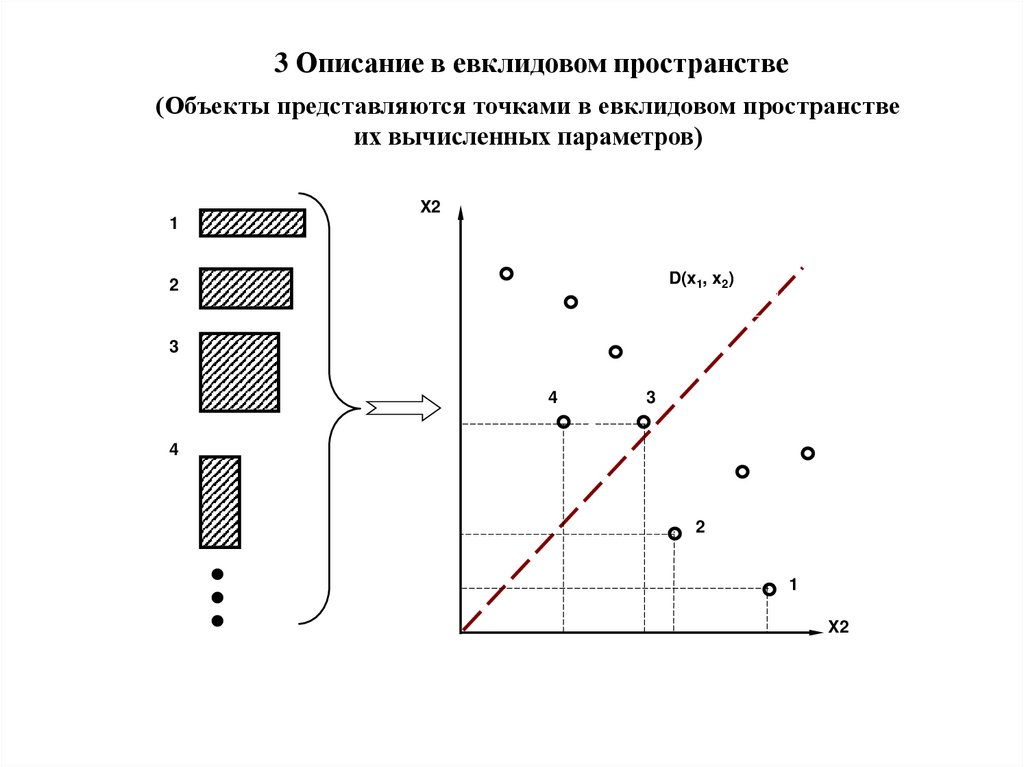

3 Описание в евклидовом пространстве(Объекты представляются точками в евклидовом пространстве

их вычисленных параметров)

X2

1

D(x1, x2)

2

3

4

3

4

2

1

X2

78.

Методы построения классификаторовСтатистические

Детерминистские

Детерминистские методы

1. Построение решающих правил

Обучающая выборка – это множество объектов, заданных значениями признаков и

принадлежность которых к тому или иному классу достоверно известна "учителю" и

сообщается учителем "обучаемой" системе.

Качество решающих правил оценивается по контрольной (экзаменационной) выборке.

Требования к обучающей и контрольной выборке:

-объекты контрольной выборки не должны входить в обучающую выборку,

- обучающая и контрольная выборки должны достаточно полно представлять генеральную

совокупность.

79.

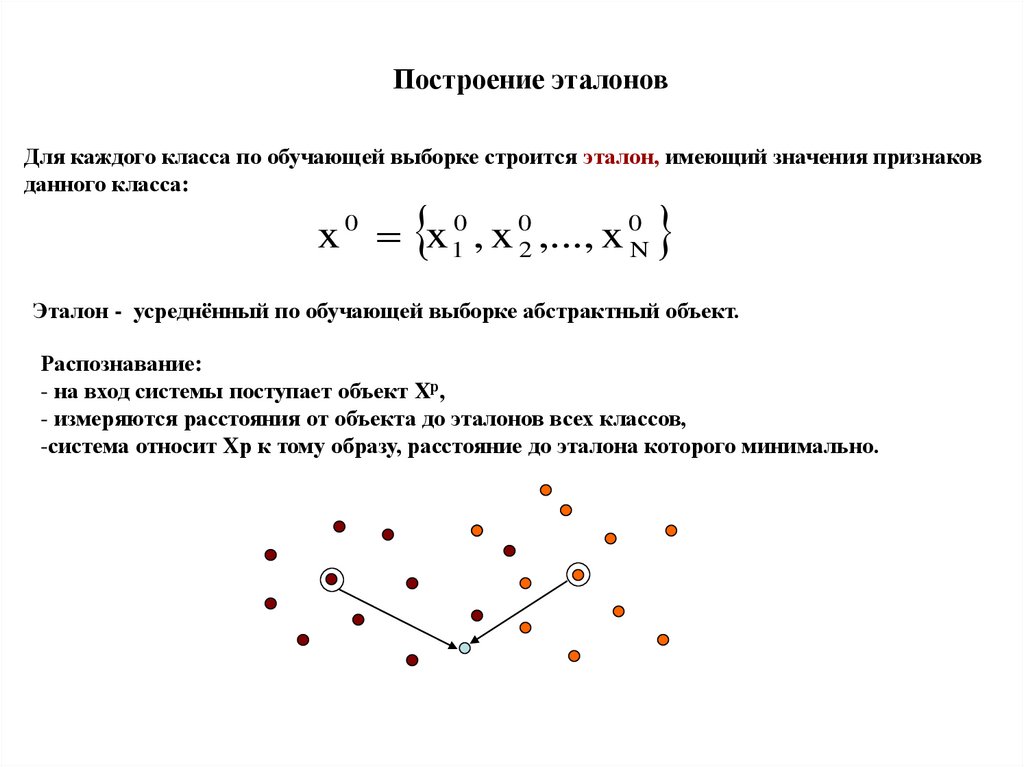

Построение эталоновДля каждого класса по обучающей выборке строится эталон, имеющий значения признаков

данного класса:

x 0 x 10 , x 02 ,..., x 0N

Эталон - усреднённый по обучающей выборке абстрактный объект.

Распознавание:

- на вход системы поступает объект Xр,

- измеряются расстояния от объекта до эталонов всех классов,

-система относит Xр к тому образу, расстояние до эталона которого минимально.

80.

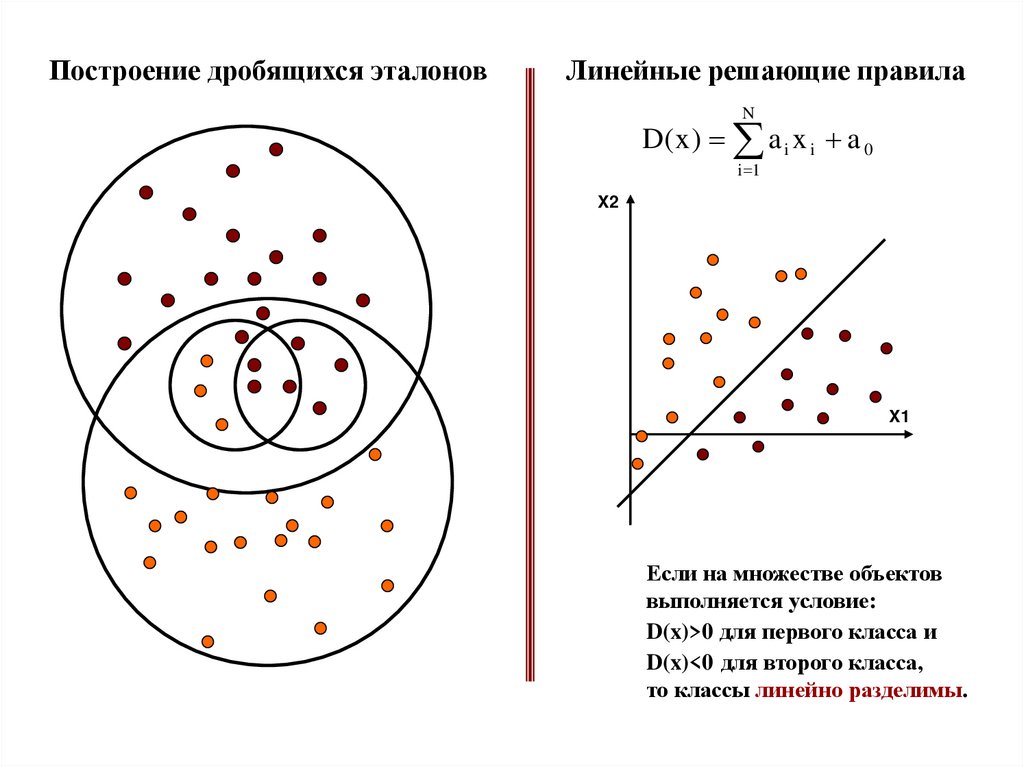

Построение дробящихся эталоновЛинейные решающие правила

N

D( x ) a i x i a 0

i 1

X2

X1

Если на множестве объектов

выполняется условие:

D(x)>0 для первого класса и

D(x)<0 для второго класса,

то классы линейно разделимы.

81.

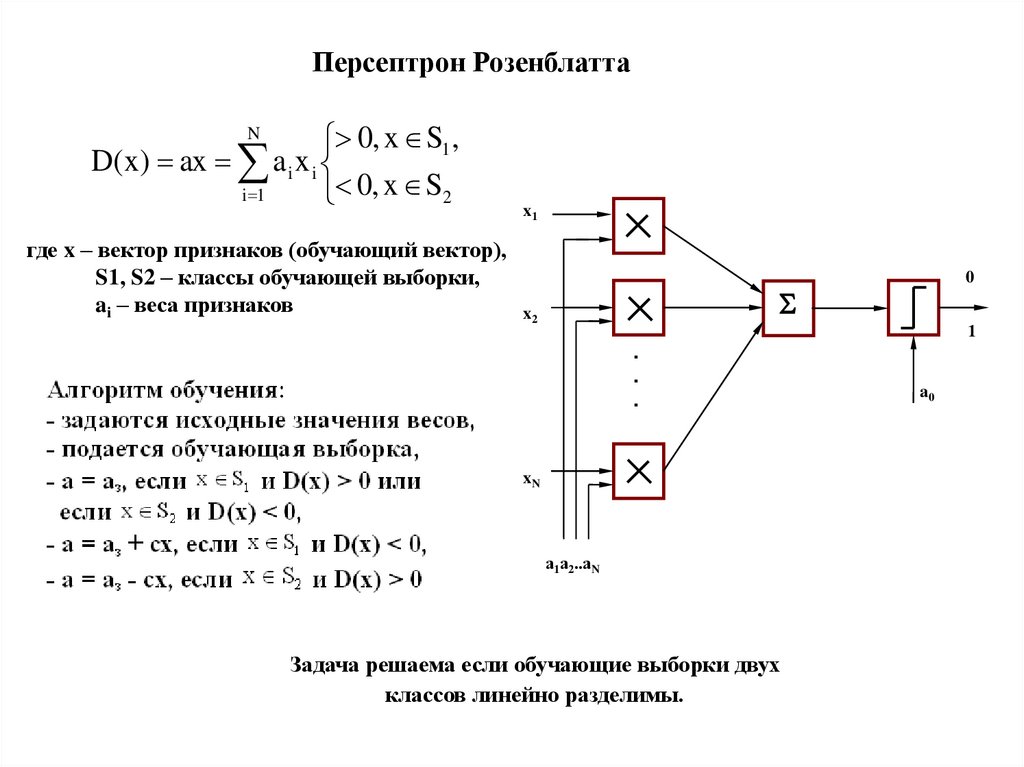

Персептрон Розенблатта0, x S1 ,

D( x ) ax a i x i

i 1

0, x S2

N

где x – вектор признаков (обучающий вектор),

S1, S2 – классы обучающей выборки,

ai – веса признаков

x1

0

x2

1

.

.

.

xN

а1а2..аN

Задача решаема если обучающие выборки двух

классов линейно разделимы.

a0

82.

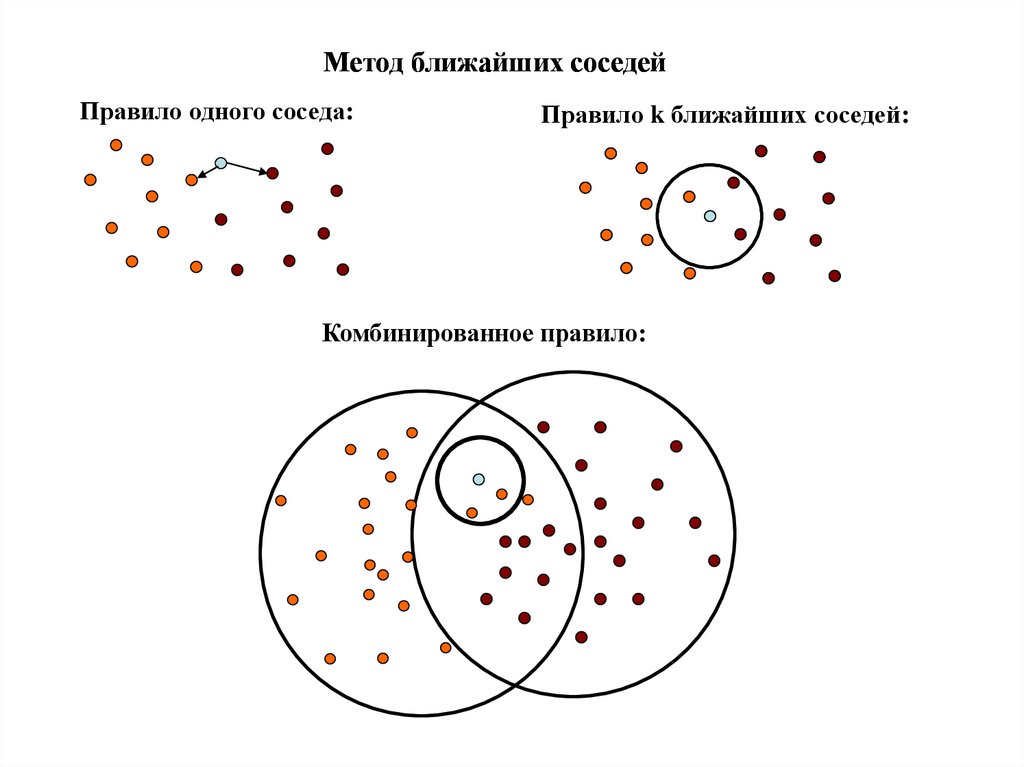

Метод ближайших соседейПравило одного соседа:

Правило k ближайших соседей:

Комбинированное правило:

83.

Кластерный анализ(самообучение, обучение без учителя, таксономия)

Кластерный анализ – совокупность математических методов, предназначенных

для формирования относительно "отдаленных" друг от друга групп "близких"

между собой объектов по информации о расстояниях или связях (мерах близости)

между ними. Причем внутри групп объекты должны быть тесно связаны между

собой, объекты разных групп должны быть далеки друг от друга

Форма представления исходных

данных

Расстояние между признаками

(мера близости)

Обычное Евклидово расстояние:

Е (x i , x j )

(x x )

i

2

j

“Взвешенное” Евклидово расстояние:

Е (x i , x j )

(x x )

k

i

2

j

Хеммингово расстояние:

Х (x i , x j ) x i x j

84.

Расстояние между кластерамигде - расстояние между классами sl, sm и sq;

- α, β, δ и γ - числовые коэффициенты

85.

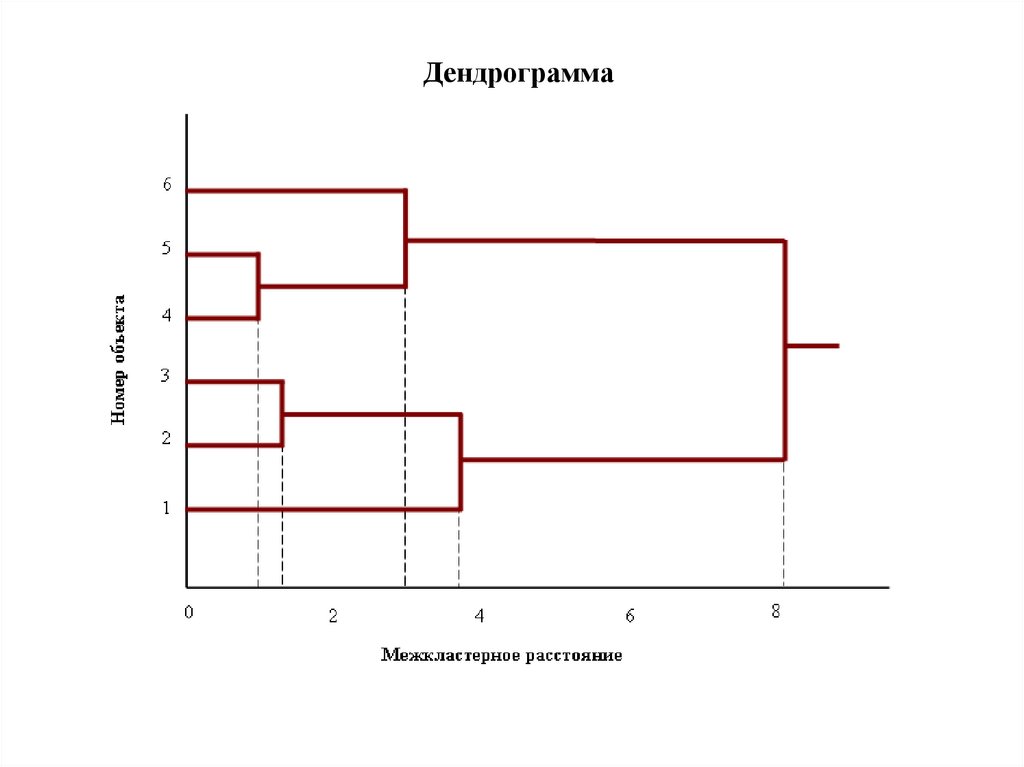

Пример(иерархический алгоритм классификации)

Провести классификацию n = 6 объектов, каждый из которых характеризуется

двумя признаками.

14

12

10

8

6

4

2

0

0

Расстояние между объектами 1 и 2:

Расстояние между объектами 1 и 3:

и т.д.

5

10

15

86.

Матрица расстояний:После объединения 4 и 5:

Расстояние между кластерами:

87.

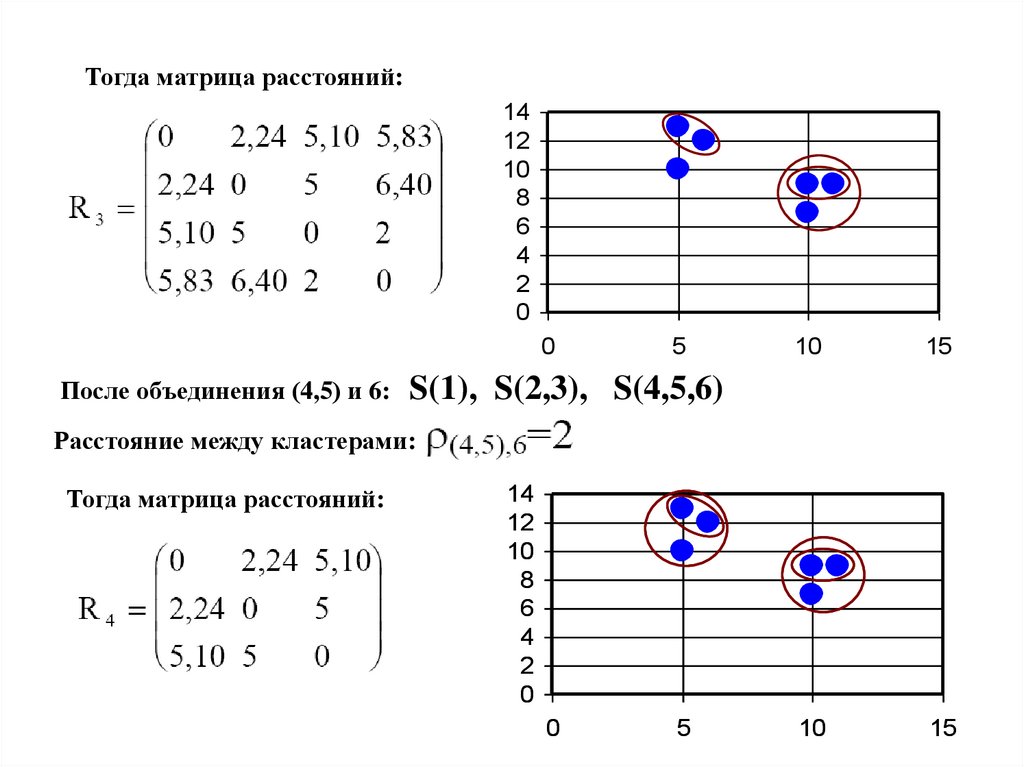

Тогда матрица расстояний:14

12

10

8

6

4

2

0

0

После объединения 2 и 3:

Расстояние между кластерами:

5

10

15

88.

Тогда матрица расстояний:14

12

10

8

6

4

2

0

0

После объединения (4,5) и 6:

5

10

15

10

15

S(1), S(2,3), S(4,5,6)

Расстояние между кластерами:

Тогда матрица расстояний:

14

12

10

8

6

4

2

0

0

5

Математика

Математика Электроника

Электроника