Похожие презентации:

Множественная линейная регрессия

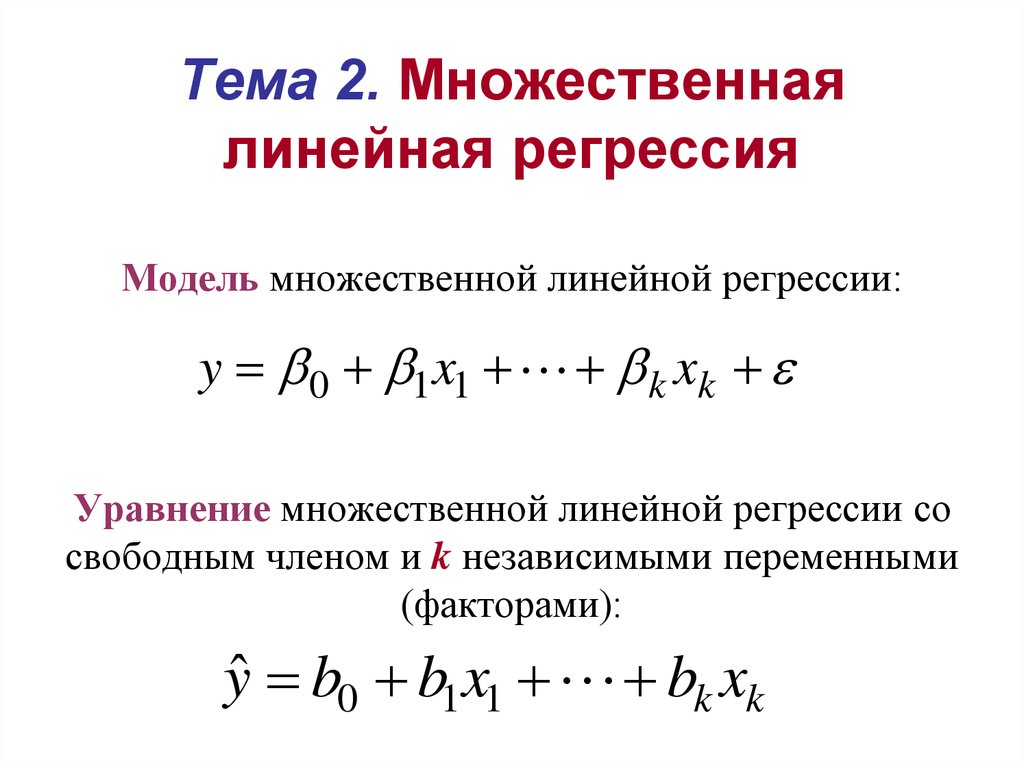

1. Тема 2. Множественная линейная регрессия

Модель множественной линейной регрессии:y 0 1x1 k xk

Уравнение множественной линейной регрессии со

свободным членом и k независимыми переменными

(факторами):

yˆ b0 b1x1 bk xk

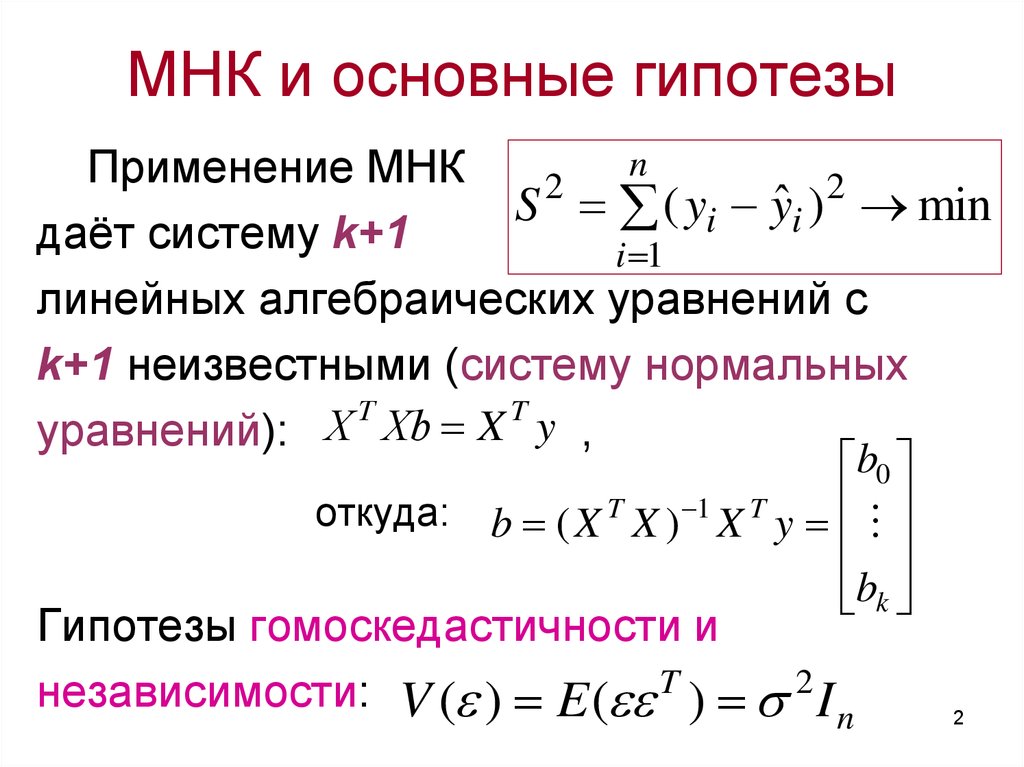

2. МНК и основные гипотезы

nПрименение МНК

2

2

S ( yi yˆi ) min

даёт систему k+1

i 1

линейных алгебраических уравнений с

k+1 неизвестными (систему нормальных

Т

T

уравнений): Х Хb X y ,

b0

откуда: b ( X T X ) 1 X T y

bk

Гипотезы гомоскедастичности и

независимости: V ( ) E ( T ) 2 I n

2

3.

Оценка дисперсии ошибокНесмещённая оценка

2

2

равна:

1

1

2

2

ˆ s

i

( yi yˆi )

n k 1

n k 1

2

2

Числа степеней свободы (df)

Пусть n – число наблюдений, k – число

факторов. Разность n k 1 0 называется

числом степеней свободы

(разность между числом наблюдений и числом

оцененных параметров).

Для надёжной оценки формулы связи

требуется: n 3(k 1) (как минимум)

3

4.

Если n k 1 , то коэффициентырегрессии оцениваются единственным

образом.

Если n k 1 , то нельзя найти

точную формулу связи, а необходимо

выбрать наилучшее приближение для

имеющихся наблюдений – устойчивую

формулу связи.

4

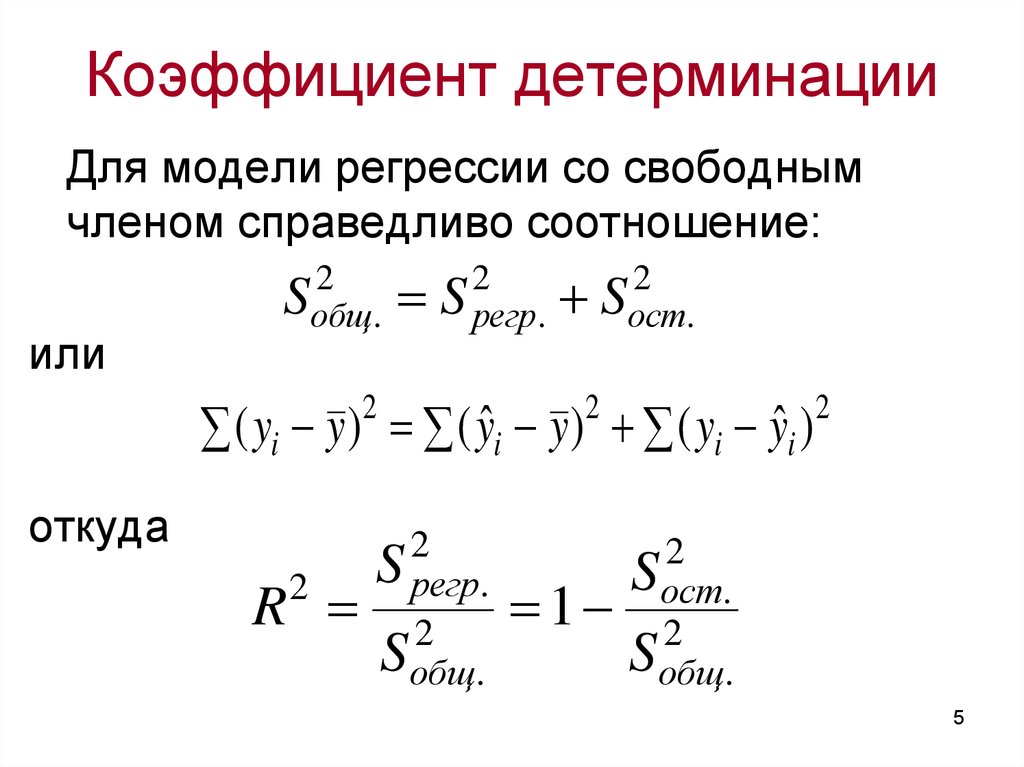

5. Коэффициент детерминации

Для модели регрессии со свободнымчленом справедливо соотношение:

или

2

Sобщ.

2

S регр.

2

Sост.

( yi y ) ( yˆi y ) ( yi yˆi )

2

откуда

R

2

2

S регр.

2

Sобщ.

2

1

2

2

Sост.

2

Sобщ.

5

6.

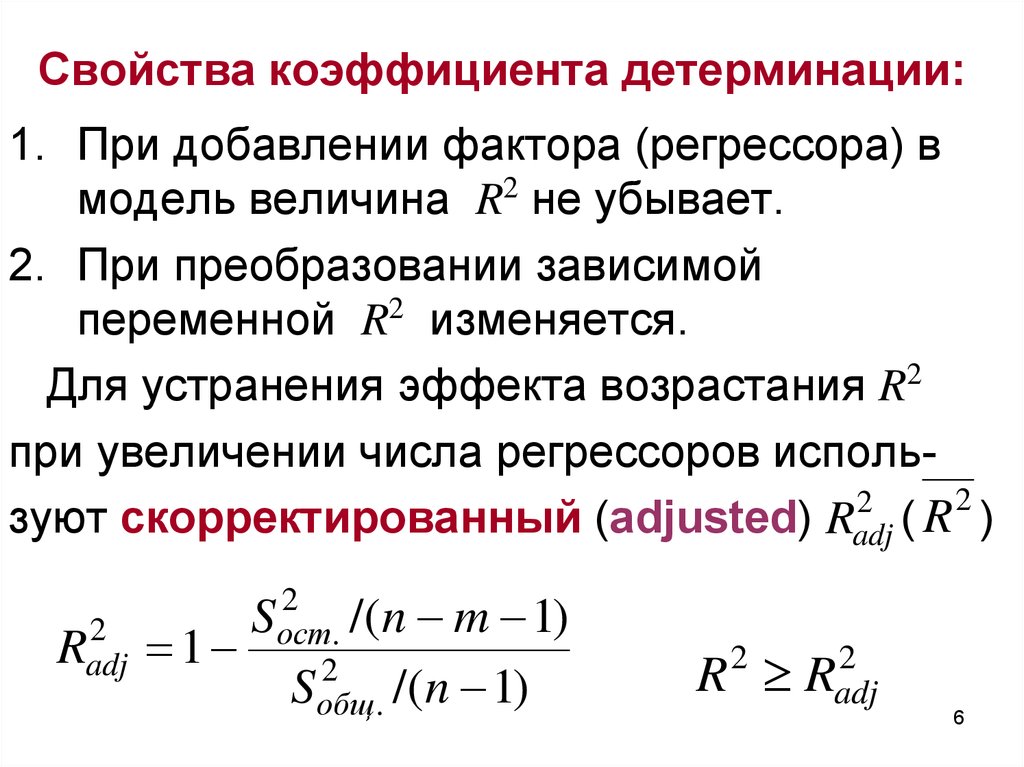

Свойства коэффициента детерминации:1. При добавлении фактора (регрессора) в

модель величина R2 не убывает.

2. При преобразовании зависимой

переменной R2 изменяется.

Для устранения эффекта возрастания R2

при увеличении числа регрессоров исполь2

2

зуют скорректированный (adjusted) Radj ( R )

2

Radj

1

2

Sост. /(n m 1)

2

Sобщ. /(n 1)

R

2

2

Radj

6

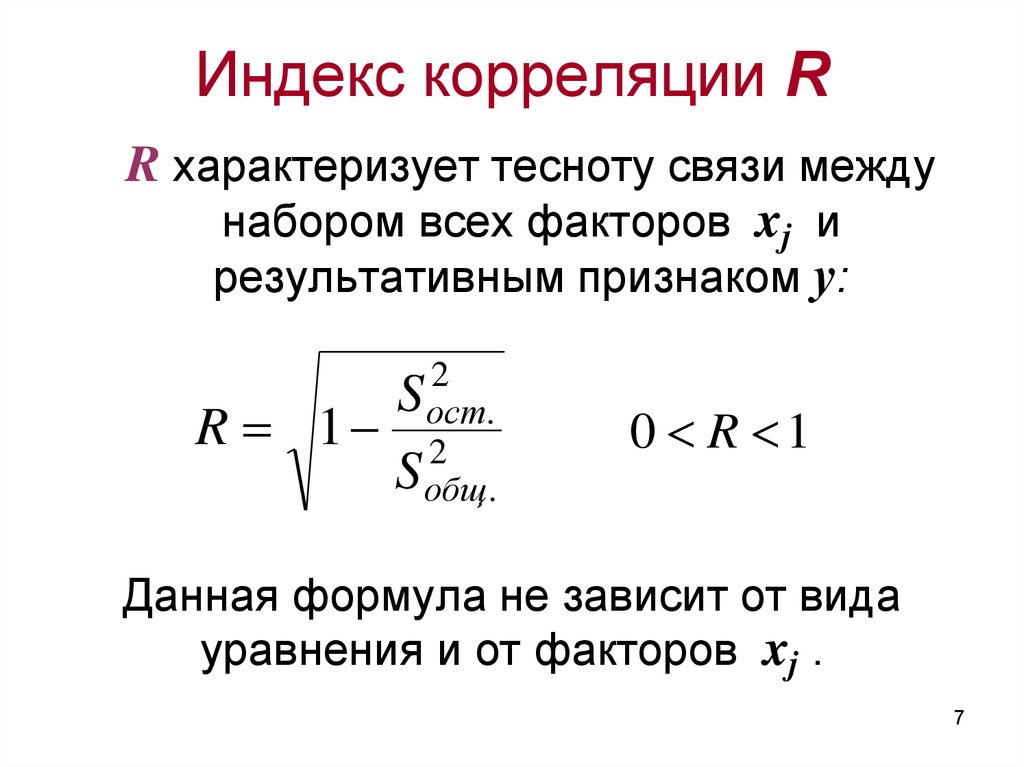

7. Индекс корреляции R

R характеризует тесноту связи междунабором всех факторов xj и

результативным признаком у:

R 1

2

Sост.

2

Sобщ.

0 R 1

Данная формула не зависит от вида

уравнения и от факторов xj .

7

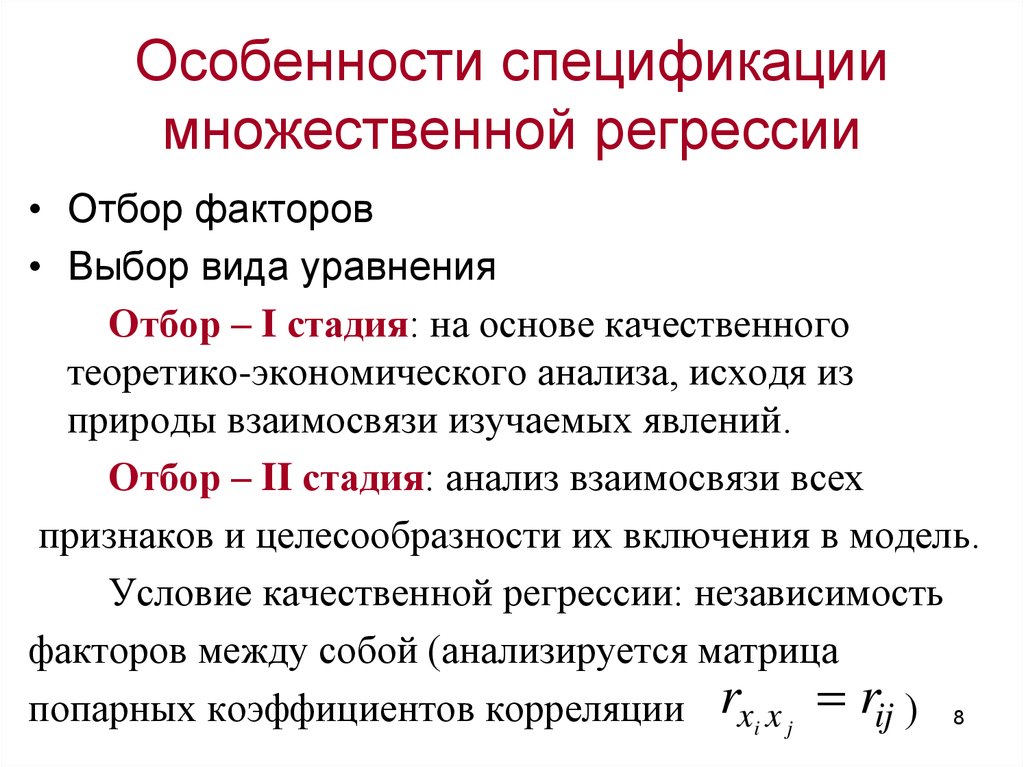

8. Особенности спецификации множественной регрессии

• Отбор факторов• Выбор вида уравнения

Отбор – I стадия: на основе качественного

теоретико-экономического анализа, исходя из

природы взаимосвязи изучаемых явлений.

Отбор – II стадия: анализ взаимосвязи всех

признаков и целесообразности их включения в модель.

Условие качественной регрессии: независимость

факторов между собой (анализируется матрица

попарных коэффициентов корреляции rxi x j rij ) 8

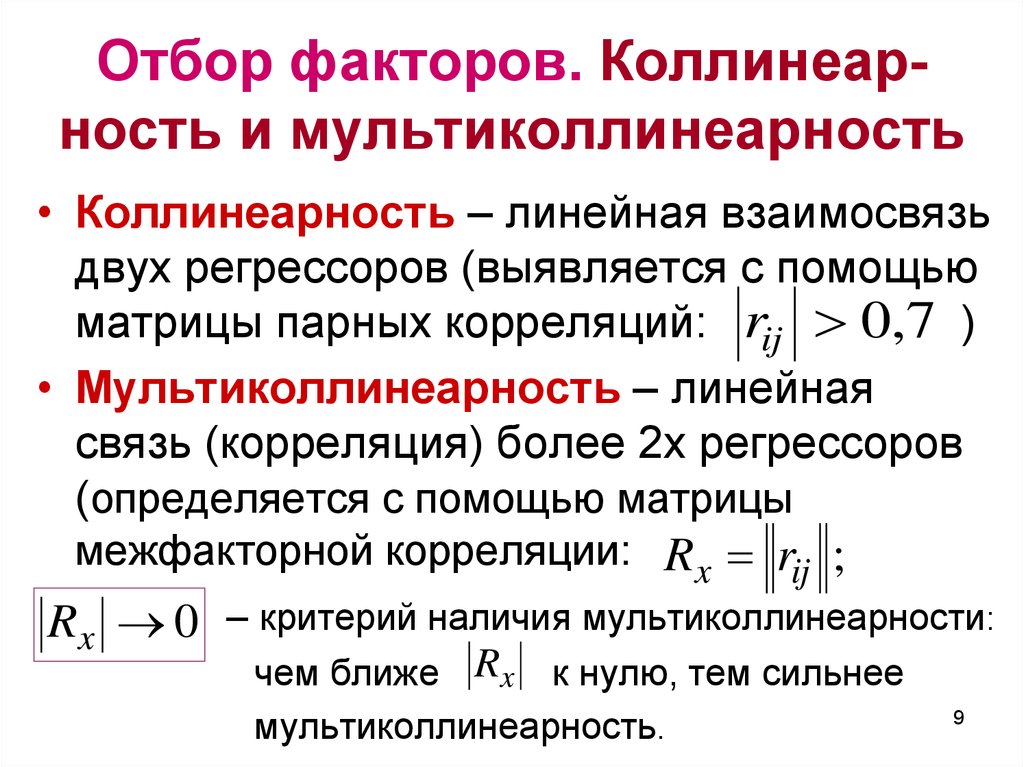

9. Отбор факторов. Коллинеар-ность и мультиколлинеарность

Отбор факторов. Коллинеарность и мультиколлинеарность• Коллинеарность – линейная взаимосвязь

двух регрессоров (выявляется с помощью

матрицы парных корреляций: rij 0,7 )

• Мультиколлинеарность – линейная

связь (корреляция) более 2х регрессоров

(определяется с помощью матрицы

межфакторной корреляции: Rx rij ;

Rx 0 – критерий наличия мультиколлинеарности:

чем ближе Rx к нулю, тем сильнее

мультиколлинеарность.

9

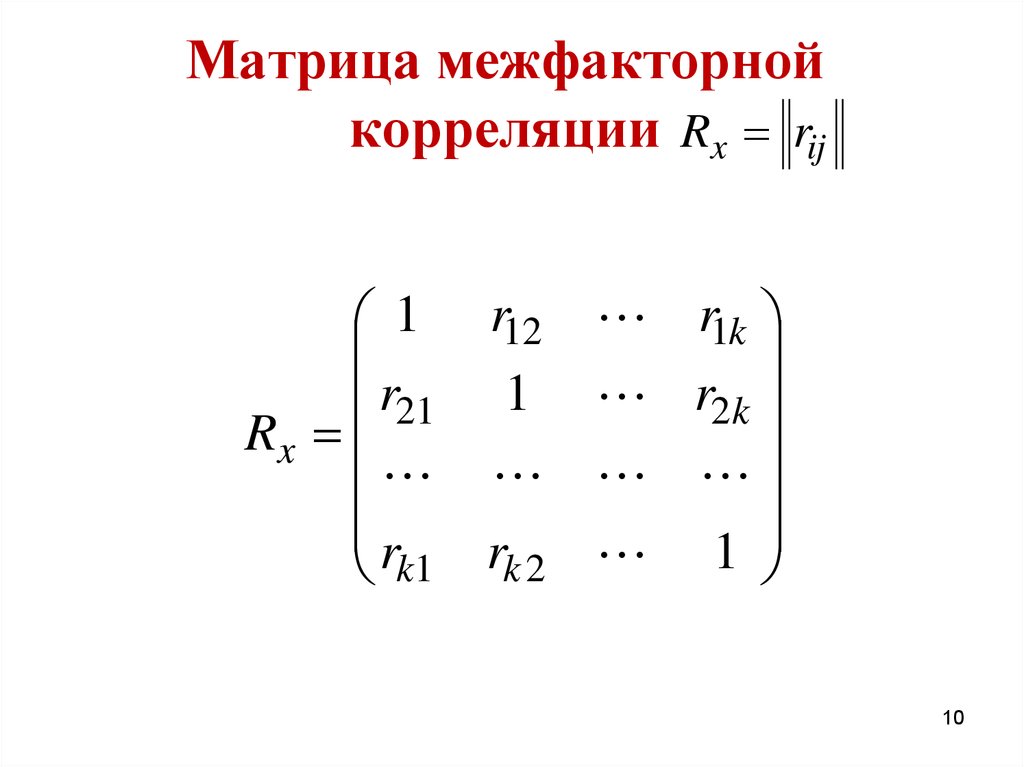

10. Матрица межфакторной корреляции

Rx rij1 r12

r21 1

Rx

rk1 rk 2

r1k

r2 k

1

10

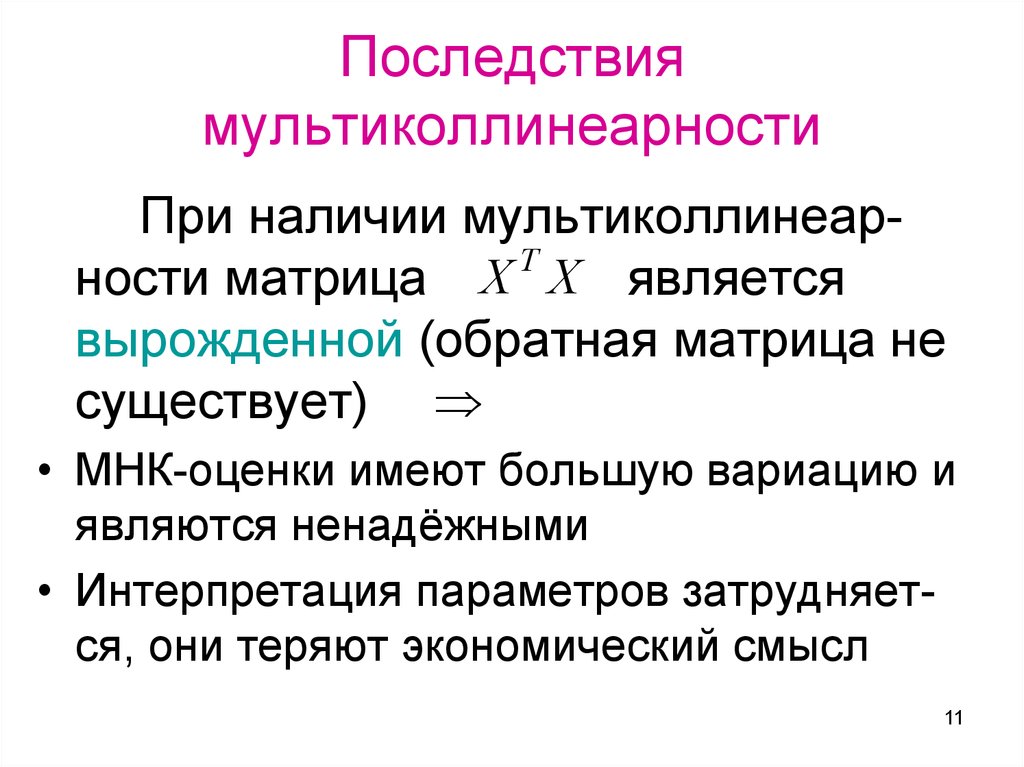

11. Последствия мультиколлинеарности

При наличии мультиколлинеарТности матрица Х Х является

вырожденной (обратная матрица не

существует)

• МНК-оценки имеют большую вариацию и

являются ненадёжными

• Интерпретация параметров затрудняется, они теряют экономический смысл

11

12. Внешние признаки наличия мультиколлинеарности

• Некоторые из МНК-оценок имеют неправильные (с точки зрения экономическойтеории) значения или знаки

• Небольшое изменение исходных данных

приводит к существенному изменению

оценок

• Большинство оценок параметров

являются статистически незначимыми, а

модель в целом – значимой

12

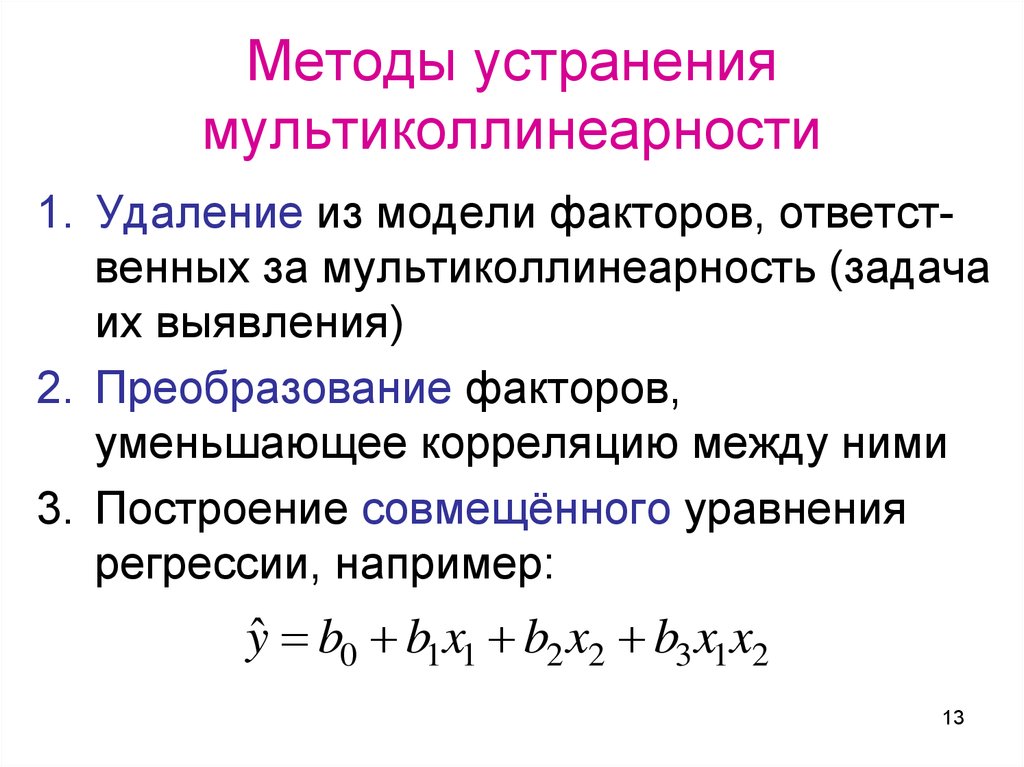

13. Методы устранения мультиколлинеарности

1. Удаление из модели факторов, ответственных за мультиколлинеарность (задачаих выявления)

2. Преобразование факторов,

уменьшающее корреляцию между ними

3. Построение совмещённого уравнения

регрессии, например:

yˆ b0 b1x1 b2 x2 b3 x1x2

13

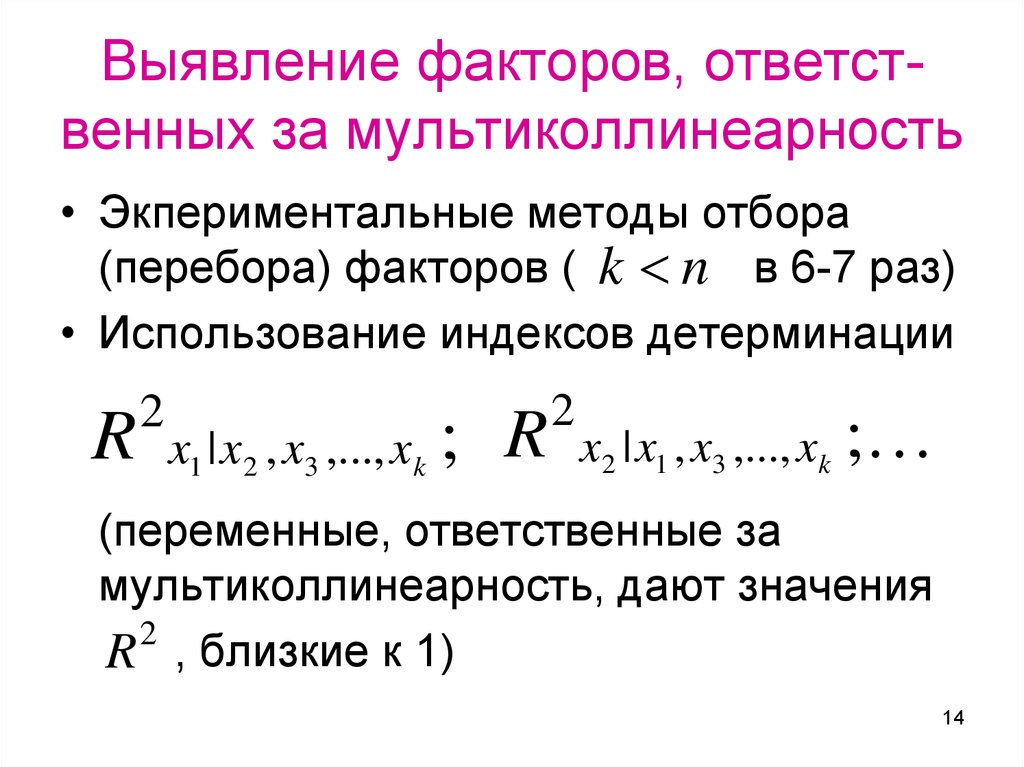

14. Выявление факторов, ответст-венных за мультиколлинеарность

Выявление факторов, ответственных за мультиколлинеарность• Экпериментальные методы отбора

(перебора) факторов ( k n в 6-7 раз)

• Использование индексов детерминации

R

2

x1 | x2 , x3 ,..., xk ;

R

2

x2 | x1 , x3 ,..., xk ;

(переменные, ответственные за

мультиколлинеарность, дают значения

2

R , близкие к 1)

14

15. Отбор факторов с помощью частных корреляций

Парные коэффициенты корреляции могутдавать завышенные оценки связи из-за

взаимосвязи факторов.

Частные корреляции элиминируют

влияние других факторов, т.е.

оценивают парные связи в «чистом»

виде:

ryx | x x

1

2

k

- коэффициент (k-1)-го порядка

15

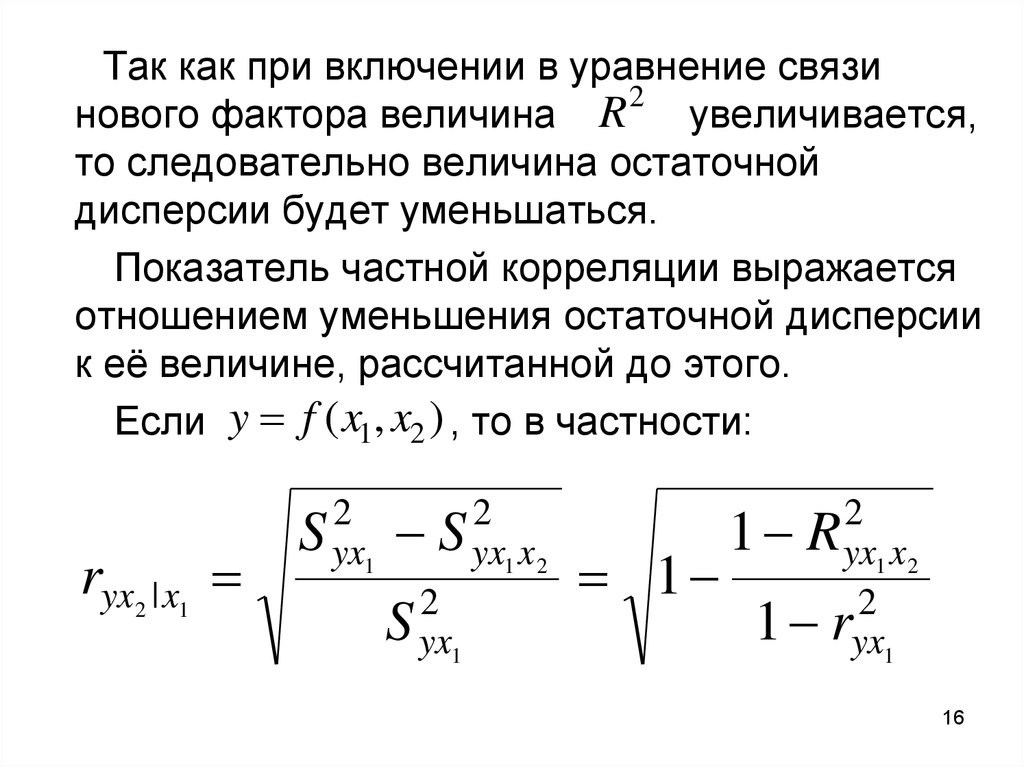

16.

Так как при включении в уравнение связи2

нового фактора величина R

увеличивается,

то следовательно величина остаточной

дисперсии будет уменьшаться.

Показатель частной корреляции выражается

отношением уменьшения остаточной дисперсии

к её величине, рассчитанной до этого.

Если y f ( x1, x2 ) , то в частности:

ryx

2 | x1

2

S yx1

2

S yx1 x2

2

S yx1

2

1 R yx1 x2

1

2

1 ryx1

16

17.

Коэффициенты частной корреляцииразличных порядков связаны

рекуррентным соотношением:

ryx | x x

1

2

k

ryx | x x ryx | x x rx x | x x

1

2

k 1

k

2

1 ryxk | x2 xk 1

2

k 1

1 k

2

k 1

2

1 rx1 xk | x2 xk 1

17

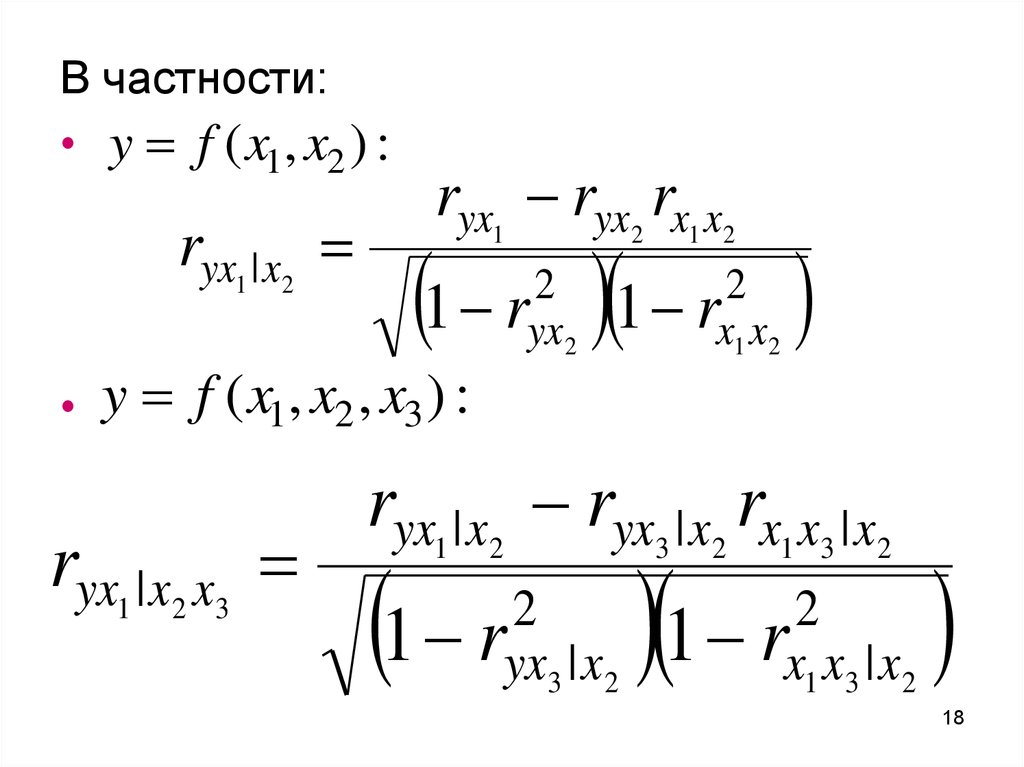

18.

В частности:• y f ( x1, x2 ) :

ryx | x

1

ryx ryx rx x

1

2

1 ryx2

2

y f ( x1, x2 , x3 ) :

ryx | x x

1

2 3

2

1 2

2

1 rx1 x2

ryx | x ryx | x rx x | x

1

2

2

1 ryx3 | x2

3

2

1 3

2

2

1 rx1 x3 | x2

18

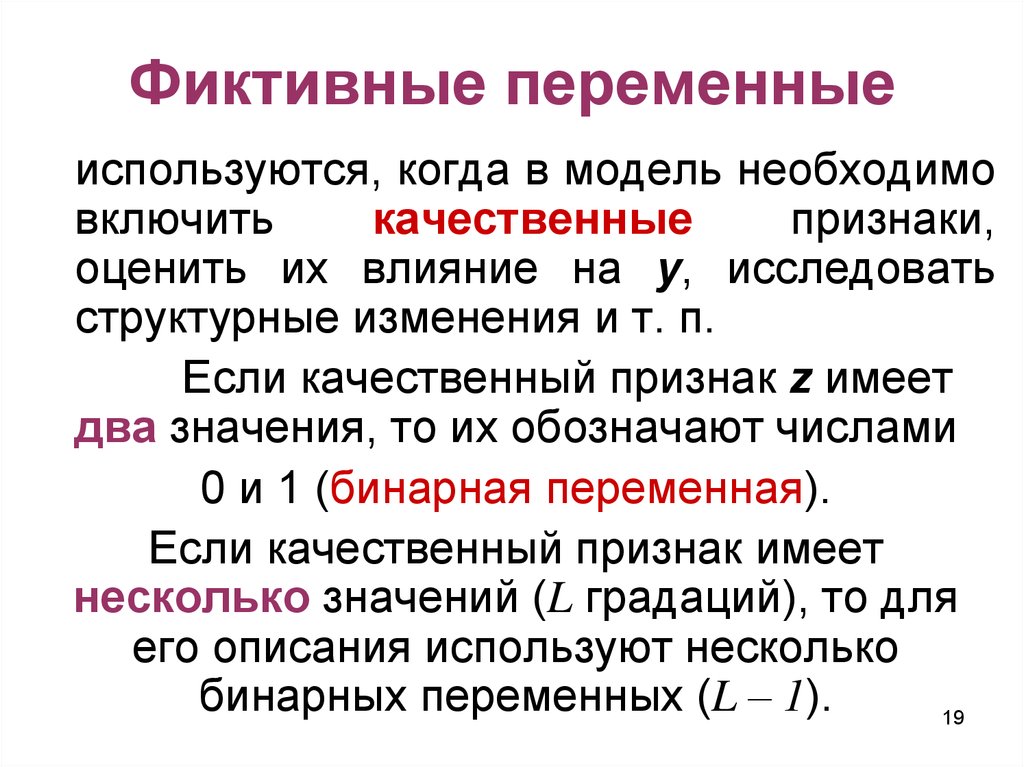

19. Фиктивные переменные

используются, когда в модель необходимовключить

качественные

признаки,

оценить их влияние на у, исследовать

структурные изменения и т. п.

Если качественный признак z имеет

два значения, то их обозначают числами

0 и 1 (бинарная переменная).

Если качественный признак имеет

несколько значений (L градаций), то для

его описания используют несколько

бинарных переменных (L – 1).

19

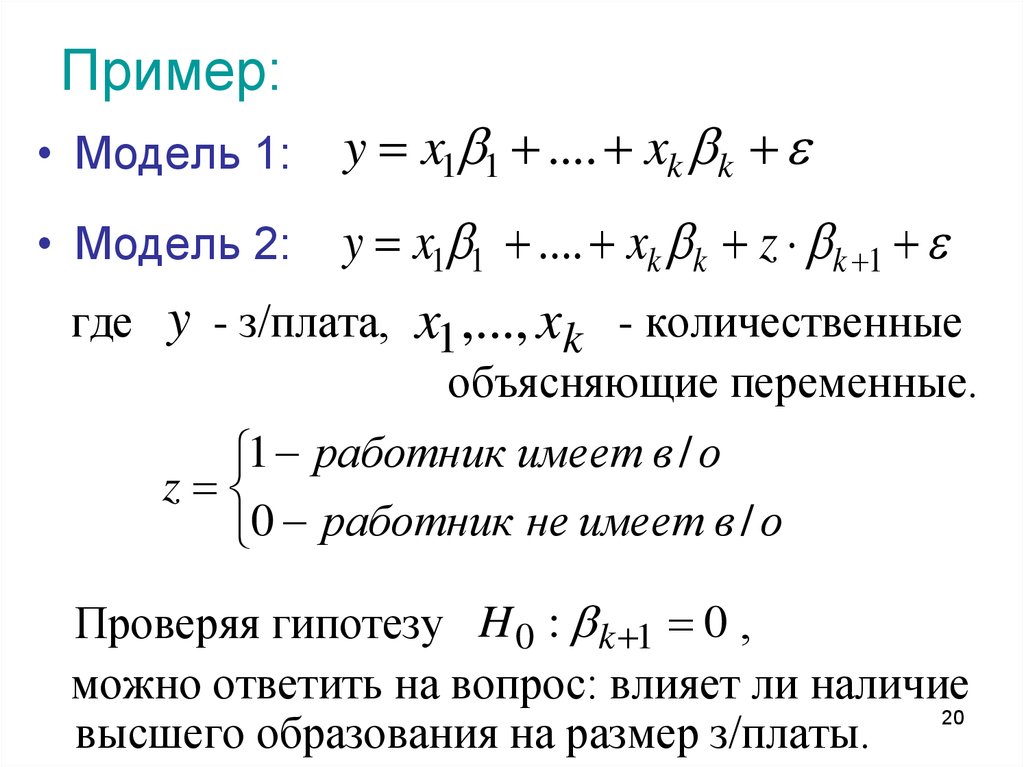

20. Пример:

• Модель 1:y x1 1 .... xk k

• Модель 2:

y x1 1 .... xk k z k 1

где y - з/плата,

x1 ,..., xk - количественные

объясняющие переменные.

1 работник имеет в / о

z

0 работник не имеет в / о

Проверяя гипотезу H 0 : k 1 0 ,

можно ответить на вопрос: влияет ли наличие

20

высшего образования на размер з/платы.

21. Интерпретация результатов регрессии с фиктивными переменными

Коэффициент регрессии (в линейной модели)отражает величину эффекта (прироста) соответствующей градации качественного фактора.

Фиктивная переменная может выступать в

роли результативного признака у. При этом

(в вероятностной модели) значение признака

интерпретируется как доля (вероятность)

осуществления соответствующей альтернативы.

21

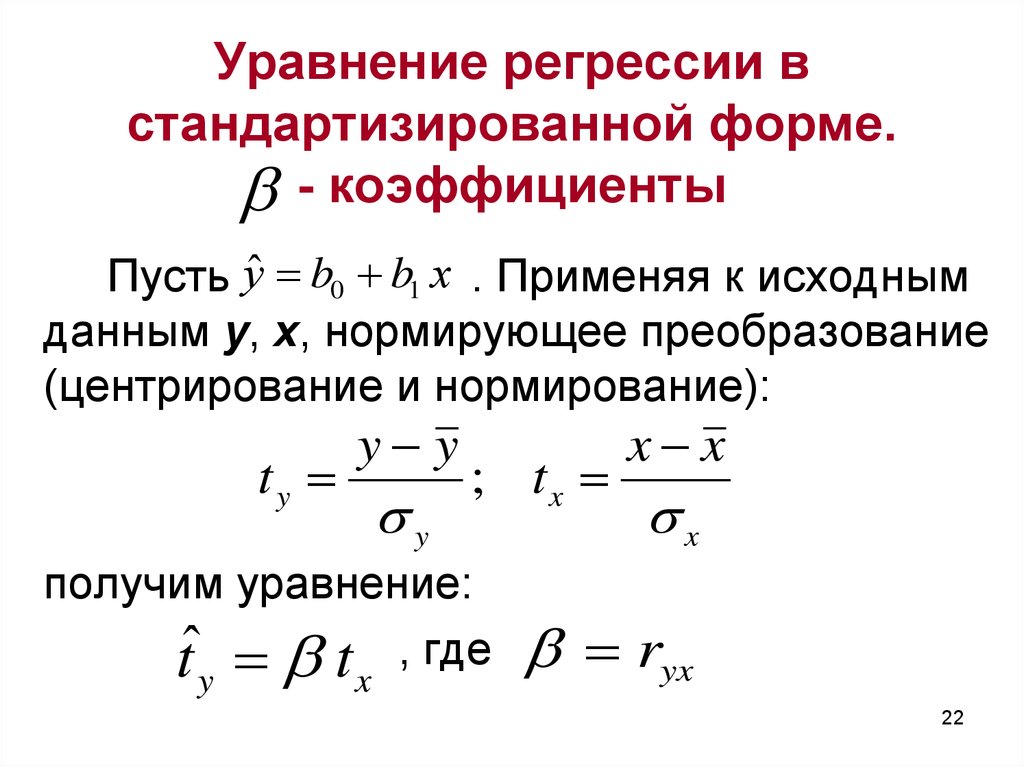

22. Уравнение регрессии в стандартизированной форме. - коэффициенты

Пусть уˆ b0 b1 х . Применяя к исходнымданным у, х, нормирующее преобразование

(центрирование и нормирование):

ty

y y

y

; tx

получим уравнение:

tˆ t , где

y

x

x x

x

ryx

22

23. Аналогично строится множественное уравнение с бета-коэффициентами:

tˆy 1 tx1 2 tx 2 k t xkСвязь между бета-коэффициентами и

коэффициентами «чистой» регрессии:

j

y

j bj

bj j

y

j

позволяет перейти от одной формы к

другой. При этом b0 y b1 x1 b2 x2 bk xk .

j – сравнимы между собой,

23

b j - не сравнимы.

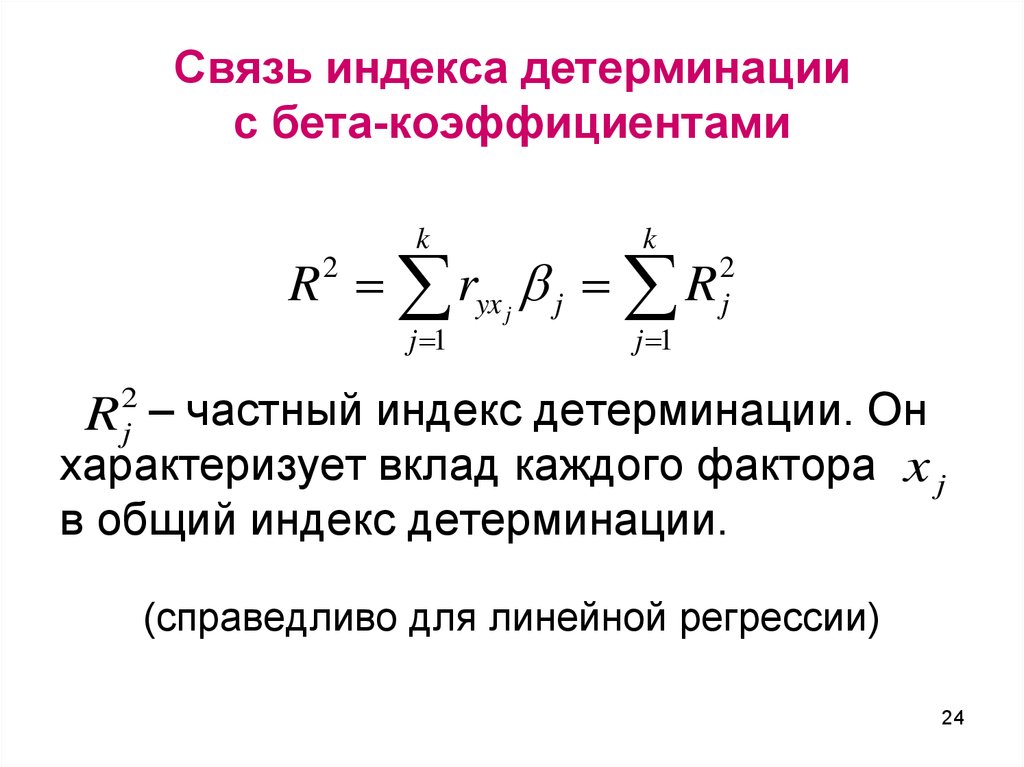

24. Связь индекса детерминации с бета-коэффициентами

kk

R ryx j j R

2

j 1

j 1

2

j

R – частный индекс детерминации. Он

характеризует вклад каждого фактора x j

2

j

в общий индекс детерминации.

(справедливо для линейной регрессии)

24

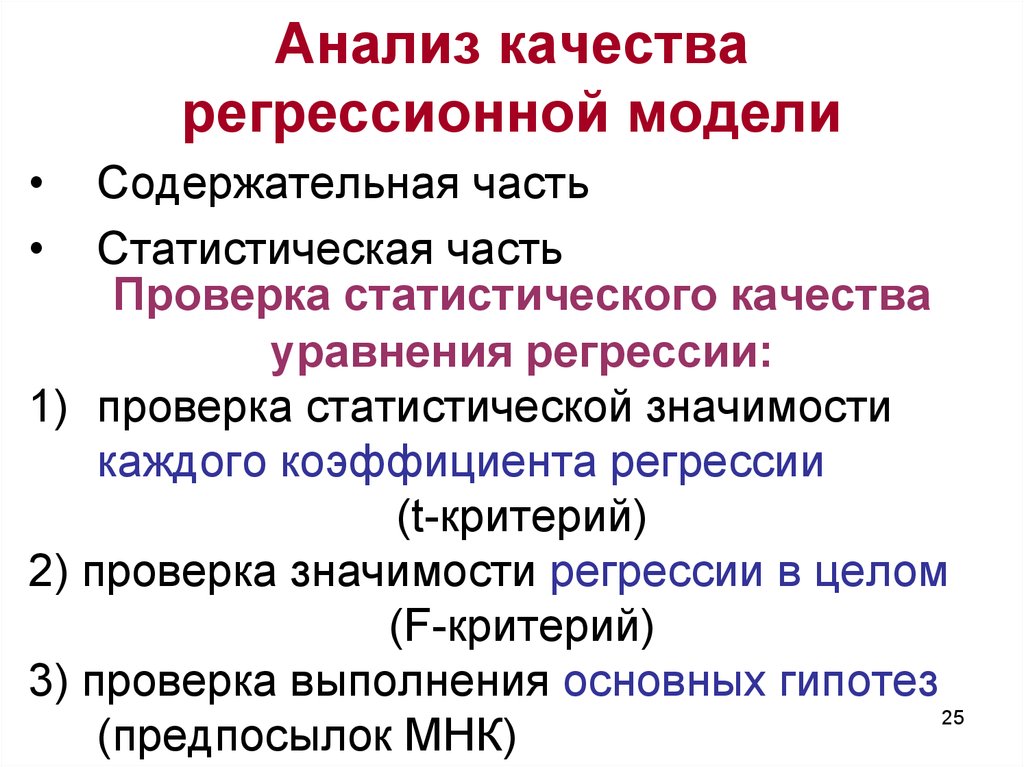

25. Анализ качества регрессионной модели

Содержательная часть

Статистическая часть

Проверка статистического качества

уравнения регрессии:

1) проверка статистической значимости

каждого коэффициента регрессии

(t-критерий)

2) проверка значимости регрессии в целом

(F-критерий)

3) проверка выполнения основных гипотез

25

(предпосылок МНК)

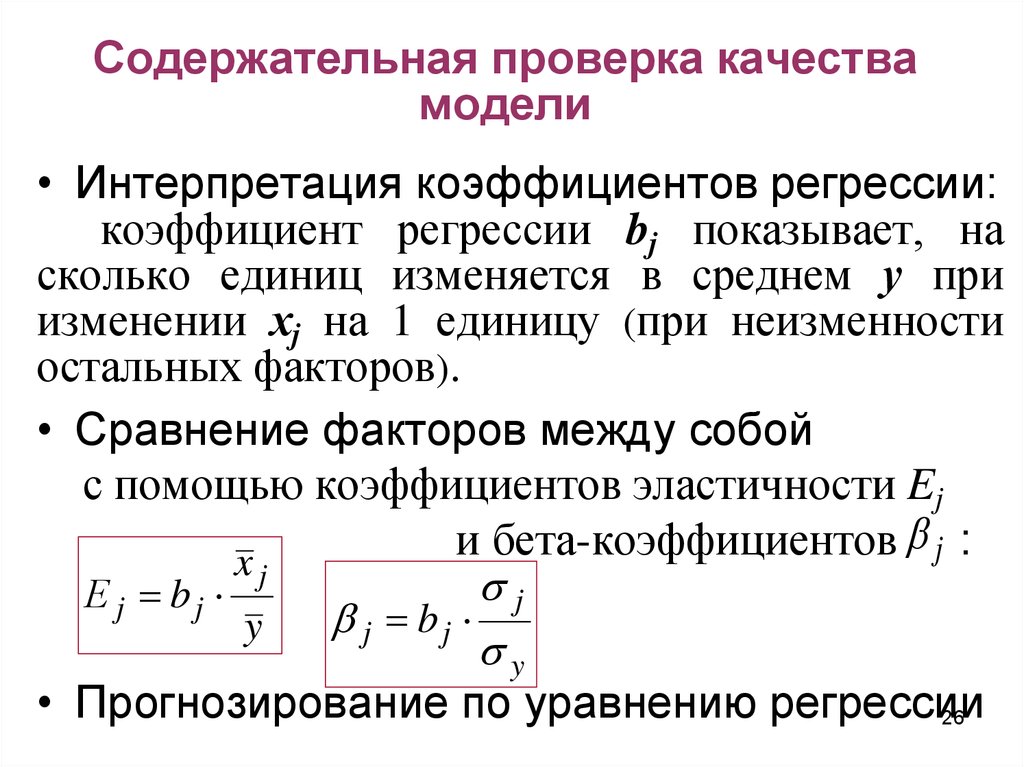

26. Содержательная проверка качества модели

• Интерпретация коэффициентов регрессии:коэффициент регрессии bj показывает, на

сколько единиц изменяется в среднем у при

изменении хj на 1 единицу (при неизменности

остальных факторов).

• Сравнение факторов между собой

с помощью коэффициентов эластичности Ej

j :

и

бета-коэффициентов

xj

j

Е j bj

j bj

y

y

• Прогнозирование по уравнению регрессии

26

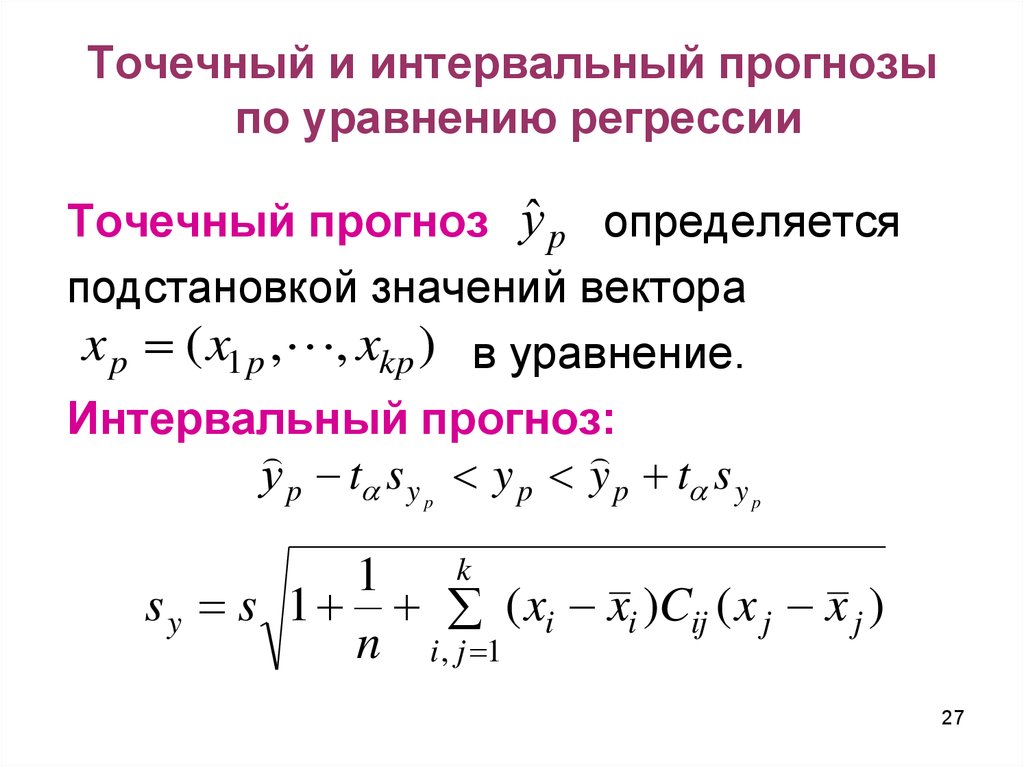

27. Точечный и интервальный прогнозы по уравнению регрессии

Точечный прогноз уˆ р определяетсяподстановкой значений вектора

x p ( x1 p , , xkp ) в уравнение.

Интервальный прогноз:

у p t s y y p y p t s y

p

p

k

1

s y s 1 ( xi xi )Cij ( x j x j )

n i , j 1

27

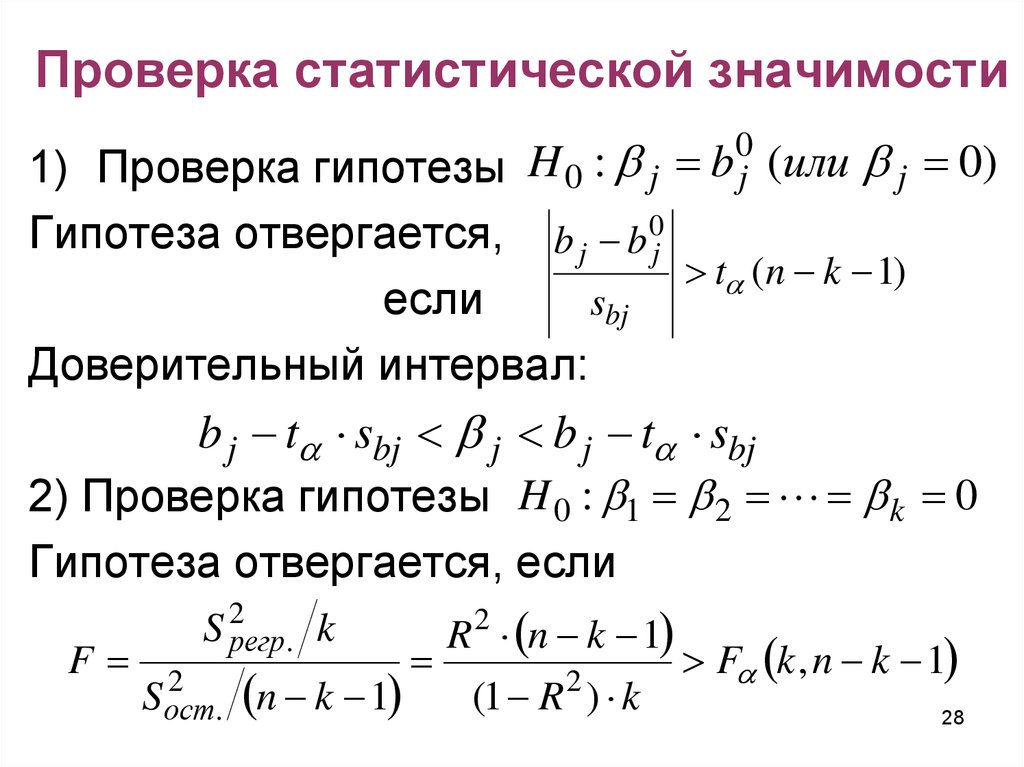

28. Проверка статистической значимости

0H0 : j b j

(или j 0)

1) Проверка гипотезы

Гипотеза отвергается, b j b 0j

t (n k 1)

если

sbj

Доверительный интервал:

b j t sbj j b j t sbj

2) Проверка гипотезы H 0 : 1 2 k 0

Гипотеза отвергается, если

F

S 2регр. k

2

Sост

.

n k 1

R 2 n k 1

(1 R ) k

2

F k , n k 1

28

29. Проверка выполнения предпосылок МНК

Основные гипотезы (1-5) касаютсяповедения остатков i yi yˆi . При их

выполнении МНК-оценки коэффициентов

регрессии являются:

несмещёнными

состоятельными

эффективными

Если характер остатков не

соответствует некоторым гипотезам,

модель следует корректировать 29

30.

• Гипотеза случайности остатков иравенства нулю их средней величины

гарантирует несмещённость МНК-оценок

• Гетероскедастичность сказывается на

уменьшении эффективности МНК-оценок

• Выполнение гипотезы независимости

обеспечивает состоятельность и

эффективность МНК-оценок

Несмещённость оценок обеспечивается

также независимостью случайных остатков

i и переменных х

30

31. Графический способ проверки гипотез

• Определяются оценки случайныхостатков: i yi yˆi

• Строится график зависимости остатков от

теоретических значений результативного

признака уˆ либо от значений факторов х

• Если расположение точек на графике не

имеет определённой направленности (т.е.

точки можно поместить в горизонтальную

полосу), то проверяемая гипотеза

выполняется

31

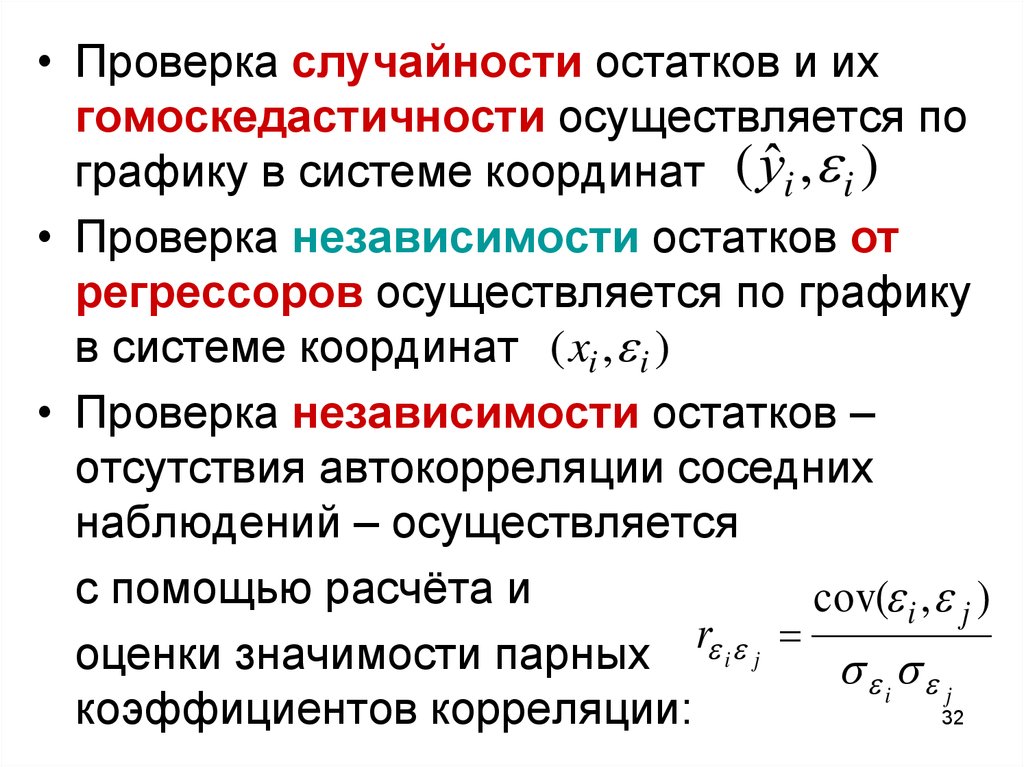

32.

• Проверка случайности остатков и ихгомоскедастичности осуществляется по

графику в системе координат ( уˆi , i )

• Проверка независимости остатков от

регрессоров осуществляется по графику

в системе координат ( xi , i )

• Проверка независимости остатков –

отсутствия автокорреляции соседних

наблюдений – осуществляется

с помощью расчёта и

cov( i , j )

r

i j

оценки значимости парных

i j

коэффициентов корреляции:

32

33. Нарушение гипотезы гомоскедастичности

• Этап 1: визуальная проверка наличиягетероскедастичности (график остатков)

• Этап 2: статистическая проверка наличия

гетероскедастичности

– (тест Гольфельда-Квандта: упорядоченные по х

наблюдения разбивают на две группы; по

критерию Фишера проверяют гипотезу о

равенстве дисперсий остатков в этих группах)

– оценка зависимости остатков от значений х с

помощью ранговой корреляции Спирмена

• Этап 3: построение регрессии с учётом

гетероскедастичности (обобщённый метод

наименьших квадратов)

33

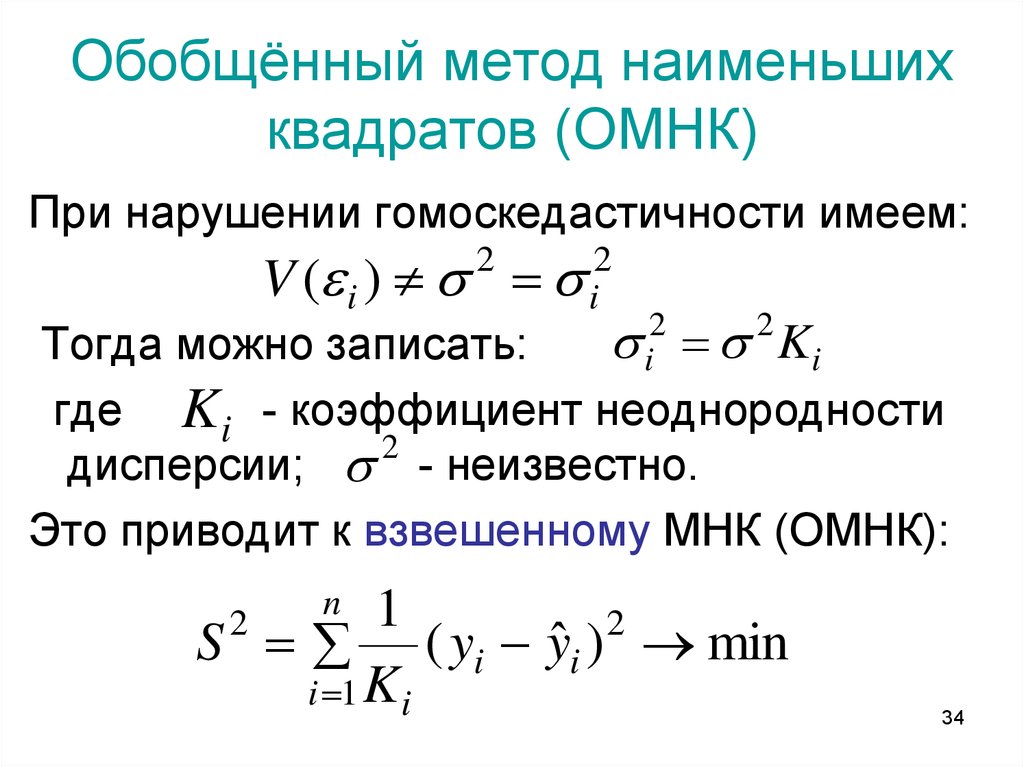

34. Обобщённый метод наименьших квадратов (ОМНК)

При нарушении гомоскедастичности имеем:V ( i )

2

2

i

2

i

Ki

Тогда можно записать:

где Ki - коэффициент неоднородности

2

дисперсии; - неизвестно.

Это приводит к взвешенному МНК (ОМНК):

2

1

2

S ( yi yˆi ) min

i 1 K i

2

n

34

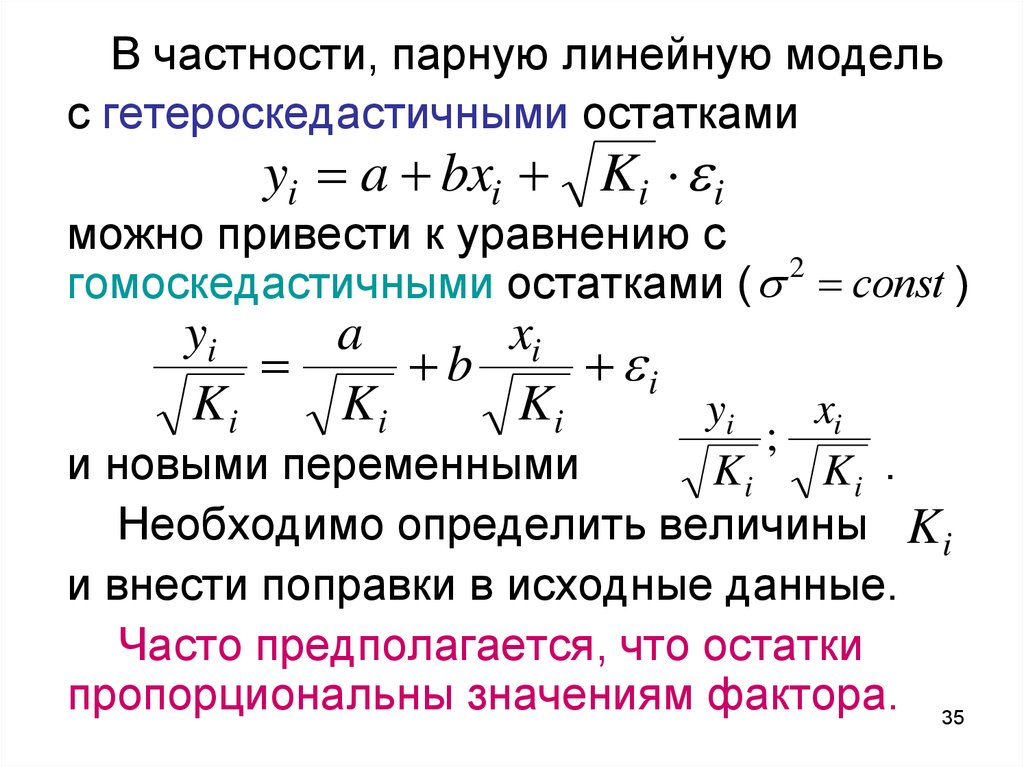

35. В частности, парную линейную модель

с гетероскедастичными остаткамиyi a bxi Ki i

можно привести к уравнению с

2

гомоскедастичными остатками ( сonst )

yi

a

xi

b

i

Ki

Ki

Ki

yi

xi

;

и новыми переменными

Ki

Ki .

Необходимо определить величины Ki

и внести поправки в исходные данные.

Часто предполагается, что остатки

пропорциональны значениям фактора. 35

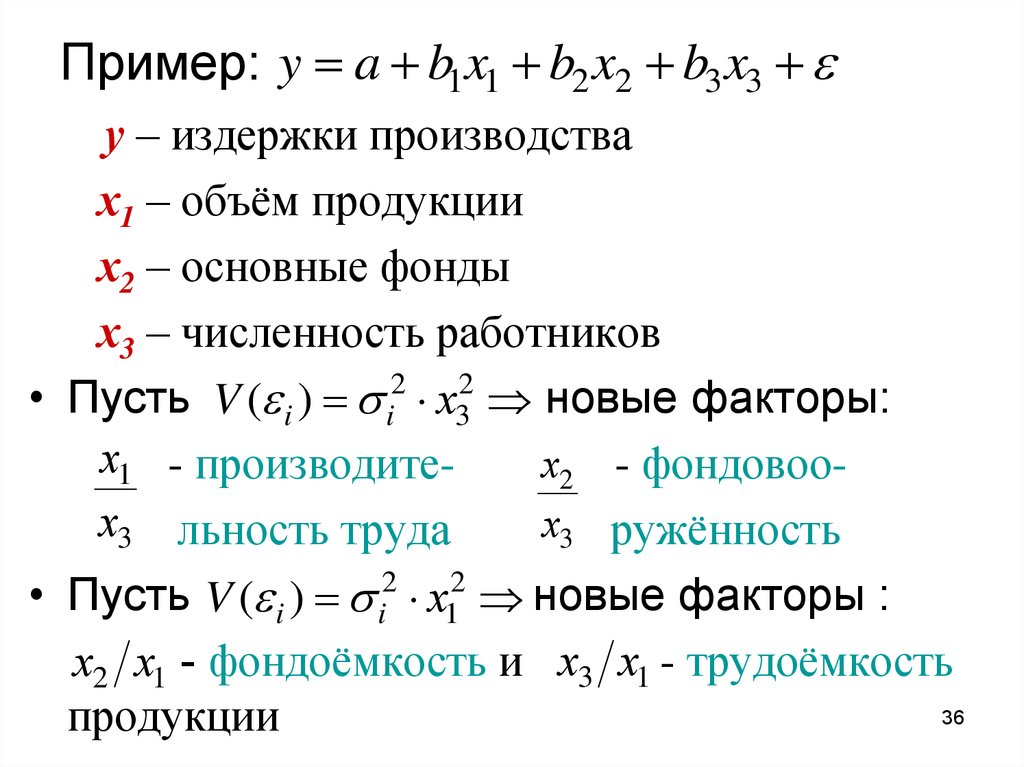

36. Пример:

y a b1x1 b2 x2 b3 x3у – издержки производства

х1 – объём продукции

х2 – основные фонды

х3 – численность работников

• Пусть V ( i ) i2 х32 новые факторы:

х1 - производитех2 - фондовоох3 льность труда

х3 ружённость

2

2

• Пусть V ( i ) i х1 новые факторы :

х2 х1 - фондоёмкость и х3 х1 - трудоёмкость

36

продукции

37. Количественная оценка гетероскедастичности

Для количественной оценки зависимостидисперсии остатков от соответствующих

значений факторов используют тесты

Уайта, Парка, Глейзера и др. Тест Уайта

(White) включен в программу эконометрического анализа «Econometric Views».

Согласно тесту Уайта зависимость

дисперсии остатков от х определяется с

помощью квадратичной функции ( напри2

2

мер: a bx cx ) и проверяется по

37

критериям Фишера и Стьюдента

Математика

Математика